Lesemodell für Document Intelligence

Wichtig

- Public Preview-Releases von Dokument Intelligenz bieten frühzeitigen Zugriff auf Features, die sich in der aktiven Entwicklung befinden.

- Features, Ansätze und Prozesse können sich aufgrund von Benutzerfeedback vor der allgemeinen Verfügbarkeit (General Availability, GA) ändern.

- Die öffentliche Vorschauversion der Clientbibliotheken für Dokument-Intelligence ist standardmäßig die REST-API-Version 2024-02-29-preview.

- Öffentliche Vorschauversion 2024-02-29-preview ist derzeit nur in den folgenden Azure-Regionen verfügbar:

- USA, Osten

- USA, Westen 2

- Europa, Westen

Dieser Inhalt gilt für:![]() Version 4.0 (Vorschau) | Vorherige Versionen:

Version 4.0 (Vorschau) | Vorherige Versionen:![]() 3.1 (allgemein verfügbar)

3.1 (allgemein verfügbar)![]() 3.0 (allgemein verfügbar)

3.0 (allgemein verfügbar)

Dieser Inhalt gilt für:![]() v3.1 (allgemein verfügbar) | Neueste Version:

v3.1 (allgemein verfügbar) | Neueste Version:![]() v4.0 (Vorschau) | Vorherige Versionen:

v4.0 (Vorschau) | Vorherige Versionen:![]() v3.0

v3.0

Dieser Inhalt gilt für:![]() v3.0 (GA) | Aktuelle Versionen:

v3.0 (GA) | Aktuelle Versionen:![]() v4.0 (Vorschau)

v4.0 (Vorschau)![]() v3.1

v3.1

Hinweis

Verwenden Sie zum Extrahieren von Text aus externen Bildern wie Beschriftungen, Straßenschildern und Postern das Lesefeature von Image Analysis v4.0, das für allgemeine Bilder optimiert ist, die keine Dokumente sind, und das über eine leistungsstärkere synchrone API verfügt, die das Einbetten von OCR in Ihre Benutzerszenarios erleichtert.

Das Dokument Intelligenz-Lesemodell für die optische Zeichenerkennung (Optical Character Recognition, OCR) wird mit einer höheren Auflösung ausgeführt als bei Azure KI Vision-Lesevorgängen, und es extrahiert gedruckten und handschriftlichen Text aus PDF-Dokumenten und gescannten Bildern. Es unterstützt das Extrahieren von Text aus Microsoft Word-, Excel-, PowerPoint- und HTML-Dokumenten. Es erkennt Absätze, Textzeilen, Wörter, Orte und Sprachen. Das Lesemodell ist die zugrunde liegende OCR-Engine für andere vordefinierten Dokument Intelligenz-Modelle wie Layouts, allgemeine Dokumente, Rechnungen, Belege, Identitätsdokumente (ID), Krankenversicherungskarten und W2-Formulare (zusätzlich zu benutzerdefinierten Modellen).

Was ist OCR für Dokumente?

Die optische Zeichenerkennung (Optical Character Recognition, OCR) für Dokumente ist für große, textintensive Dokumente in mehreren Dateiformaten und globalen Sprachen optimiert. Es umfasst Funktionen wie das Scannen von Dokumentbildern mit höherer Auflösung für eine bessere Behandlung von kleinerem und dichtem Text, die Erkennung von Absätzen und die Verwaltung von ausfüllbaren Formularen. OCR-Funktionen umfassen auch erweiterte Szenarien wie Einzelzeichenfelder und die genaue Extraktion von Schlüsselfeldern, die häufig in Rechnungen, Belegen und anderen vordefinierten Szenarien vorkommen.

Entwicklungsoptionen

Document Intelligence v4.0 (2024-02-29-preview, 2023-10-31-preview) unterstützt die folgenden Tools, Anwendungen und Bibliotheken:

| Funktion | Ressourcen | Modell-ID |

|---|---|---|

| Lese-OCR-Modell | • Document Intelligence Studio • REST-API • C# SDK • Python SDK • Java SDK • JavaScript SDK |

prebuilt-read |

Document Intelligence v3.1 unterstützt die folgenden Tools, Anwendungen und Bibliotheken:

| Feature | Ressourcen | Modell-ID |

|---|---|---|

| Lese-OCR-Modell | • Document Intelligence Studio • REST-API • C# SDK • Python SDK • Java SDK • JavaScript SDK |

prebuilt-read |

Document Intelligence v3.0 unterstützt die folgenden Tools, Anwendungen und Bibliotheken:

| Feature | Ressourcen | Modell-ID |

|---|---|---|

| Lese-OCR-Modell | • Document Intelligence Studio • REST-API • C# SDK • Python SDK • Java SDK • JavaScript SDK |

prebuilt-read |

Eingabeanforderungen

Die besten Ergebnisse erzielen Sie, wenn Sie pro Dokument ein deutliches Foto oder einen hochwertigen Scan bereitstellen.

Unterstützte Dateiformate:

Modell PDF Bild:

JPEG/JPG, PNG, BMP, TIFF, HEIFMicrosoft Office:

Word (DOCX), Excel (XLSX), PowerPoint (PPTX) und HTMLLesen ✔ ✔ ✔ Layout ✔ ✔ ✔ (2024-02-29-preview, 2023-10-31-preview) Allgemeines Dokument ✔ ✔ Vordefiniert ✔ ✔ Benutzerdefinierte Extraktion ✔ ✔ Benutzerdefinierte Klassifizierung ✔ ✔ ✔ (2024-02-29-preview) In den Formaten PDF und TIFF können bis zu 2.000 Seiten verarbeitet werden (bei einem kostenlosen Abonnement werden nur die ersten beiden Seiten verarbeitet).

Die Dateigröße für die Analyse von Dokumenten beträgt 500 MB für die kostenpflichtige (S0) und 4 MB für die kostenlose (F0) Stufe.

Die Bildgrößen müssen im Bereich zwischen 50 × 50 Pixel und 10.000 × 10.000 Pixel liegen.

Wenn Ihre PDFs kennwortgeschützt sind, müssen Sie die Sperre vor dem Senden entfernen.

Die Mindesthöhe des zu extrahierenden Texts beträgt 12 Pixel für ein Bild von 1024 × 768 Pixel. Diese Abmessung entspricht etwa einem

8-Punkt-Text bei 150 Punkten pro Zoll (Dots per Inch, DPI).Die maximale Anzahl Seiten für Trainingsdaten beträgt beim benutzerdefinierten Modelltraining 500 für das benutzerdefinierte Vorlagenmodell und 50.000 für das benutzerdefinierte neuronale Modell.

Für das Training des benutzerdefinierten Extraktionsmodells beträgt die Gesamtgröße der Trainingsdaten 50 MB für das Vorlagenmodell und 1G-MB für das neuronale Modell.

Für das Training des benutzerdefinierten Klassifizierungsmodells beträgt die Gesamtgröße der Trainingsdaten

1GBmit einem Maximum von 10 000 Seiten.

Erste Schritte mit dem Lesemodell

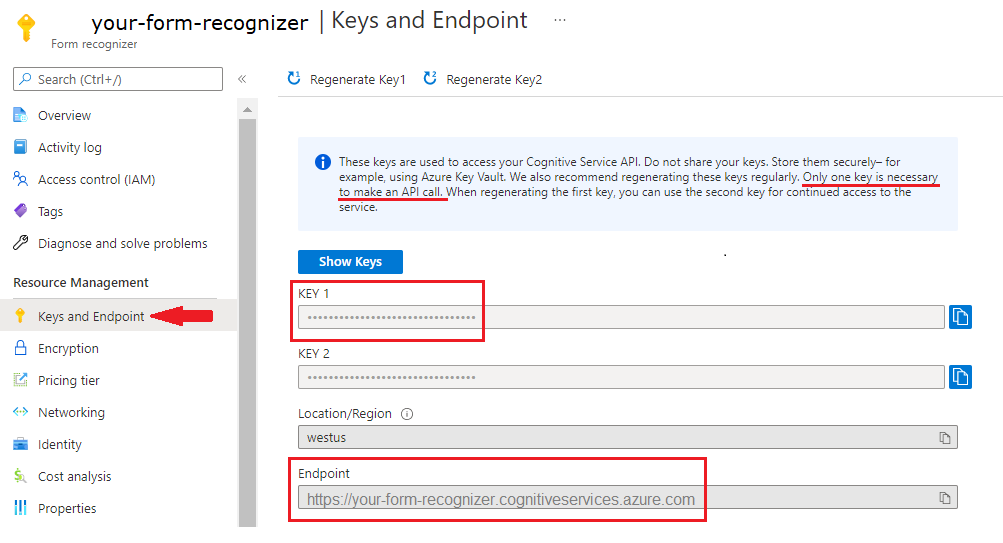

Versuchen Sie, Text mithilfe von Dokument Intelligenz Studio aus Formularen und Dokumenten zu extrahieren. Sie benötigen die folgenden Ressourcen:

Ein Azure-Abonnement (Sie können ein kostenloses Abonnement erstellen).

Eine Dokument Intelligenz-Instanz im Azure-Portal. Sie können den kostenlosen Tarif (

F0) verwenden, um den Dienst auszuprobieren. Wählen Sie nach der Bereitstellung Ihrer Ressource Zu Ressource wechseln aus, um Ihren Schlüssel und Endpunkt abzurufen.

Hinweis

Derzeit bietet Dokument Intelligenz Studio keine Unterstützung für die Microsoft Word-, Excel-, PowerPoint- und HTML-Dateiformate.

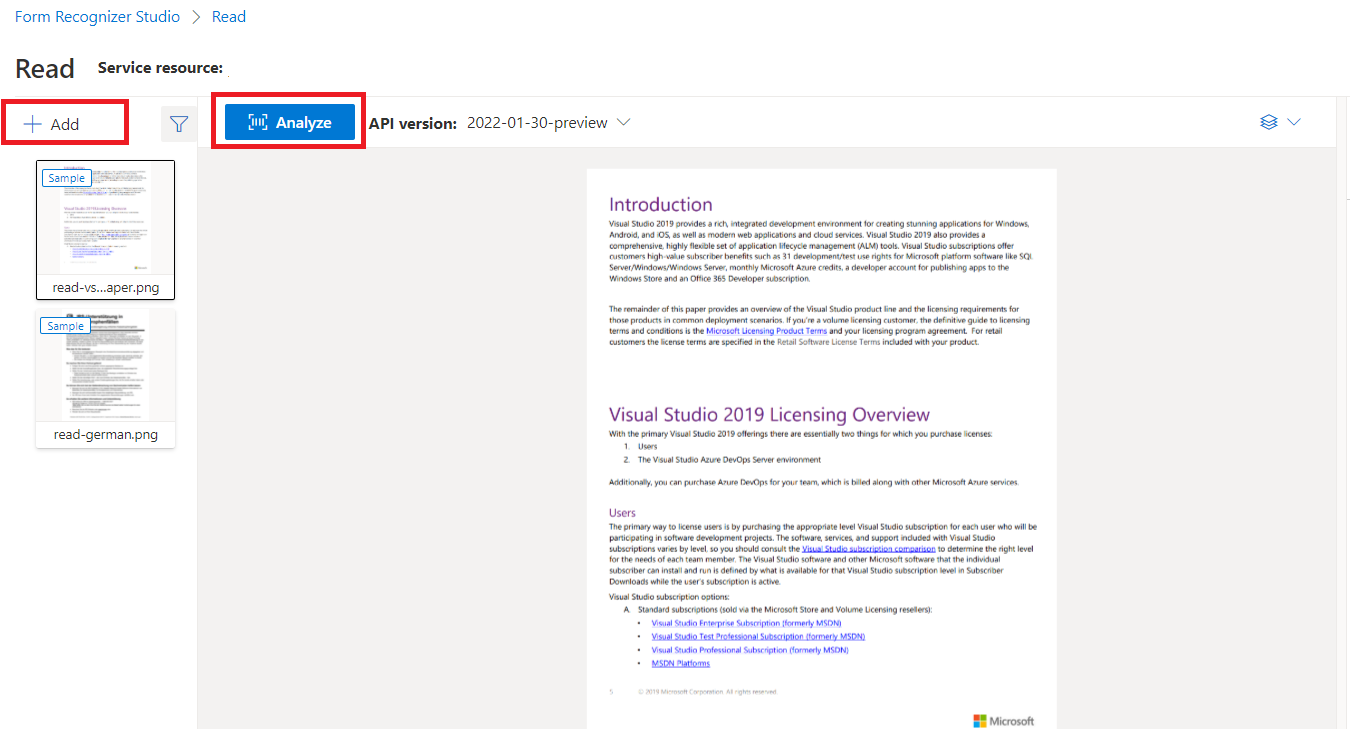

Beispieldokument, das mit Dokument Intelligenz Studio verarbeitet wurde

Wählen Sie auf der Startseite von Dokument Intelligenz Studio die Option Lesen aus.

Sie können das Musterdokument analysieren oder Ihre eigenen Dateien hochladen.

Wählen Sie die Schaltfläche Analyse ausführen aus, und konfigurieren Sie bei Bedarf die Analyseoptionen:

Unterstützte Sprachen und Gebietsschemas

Eine vollständige Liste der unterstützten Sprachen finden Sie unter Sprachunterstützung – Dokumentanalysemodelle.

Extrahieren von Daten

Hinweis

Microsoft Word- und HTML-Datei werden in Version 3.1 und höher unterstützt. Im Vergleich zu PDF und Bildern werden die folgenden Features nicht unterstützt:

- Für die einzelnen Seitenobjekte gibt es keine Angaben für Winkel, Breite/Höhe und Einheit.

- Für die einzelnen erkannten Objekte gibt es weder ein Begrenzungspolygon noch einen Begrenzungsbereich.

- Der Seitenbereich (

pages) wird nicht als Parameter unterstützt. - Es gibt kein

lines-Objekt.

Seiten

Die Seitensammlung ist eine Liste von Seiten innerhalb des Dokuments. Jede Seite wird innerhalb des Dokuments sequenziell dargestellt und enthält den Ausrichtungswinkel, der angibt, ob die Seite gedreht wurde, sowie die Breite und Höhe (Abmessungen in Pixel). Die Seiteneinheiten in der Modellausgabe werden wie gezeigt berechnet:

| Dateiformat | Berechnete Seiteneinheit | Seiten gesamt |

|---|---|---|

| Bilder (JPEG/JPG, PNG, BMP, HEIF) | Jedes Bild = 1 Seiteneinheit | Gesamtzahl der Bilder |

| Jede Seite in der PDF = 1 Seiteneinheit | Gesamtseitenzahl in der PDF | |

| TIFF | Jedes TIFF-Bild = 1 Seiteneinheit | Gesamtanzahl der Bilder im TIFF-Dokument |

| Word (DOCX) | Bis zu 3.000 Zeichen = 1 Seiteneinheit, eingebettete oder verknüpfte Bilder werden nicht unterstützt | Gesamtzahl der Seiten von bis zu 3.000 Zeichen jeweils |

| Excel (XLSX) | Jedes Arbeitsblatt = 1 Seiteneinheit, eingebettete oder verknüpfte Bilder nicht unterstützt | Arbeitsblätter insgesamt |

| PowerPoint (PPTX) | Jede Folie = 1 Seiteneinheit, eingebettete oder verknüpfte Bilder nicht unterstützt | Folien insgesamt |

| HTML | Bis zu 3.000 Zeichen = 1 Seiteneinheit, eingebettete oder verknüpfte Bilder werden nicht unterstützt | Gesamtzahl der Seiten von bis zu 3.000 Zeichen jeweils |

"pages": [

{

"pageNumber": 1,

"angle": 0,

"width": 915,

"height": 1190,

"unit": "pixel",

"words": [],

"lines": [],

"spans": []

}

]

Auswählen der Seiten für die Textextraktion

Verwenden Sie für umfangreiche PDF-Dokumente mit mehreren Seiten den Abfrageparameter pages, um bestimmte Seitenzahlen oder Seitenbereiche für die Textextraktion anzugeben.

Absätze

Das OCR-Lesemodell in Dokument Intelligenz extrahiert alle identifizierten Textblöcke in der paragraphs-Sammlung als Objekt der obersten Ebene unter analyzeResults. Jeder Eintrag in dieser Auflistung stellt einen Textblock dar und enthält den extrahierten Text als content sowie die Koordinaten des Begrenzungs-polygon. Die span-Informationen zeigen auf das Textfragment innerhalb der content-Eigenschaft der obersten Ebene, die den vollständigen Text aus dem Dokument enthält.

"paragraphs": [

{

"spans": [],

"boundingRegions": [],

"content": "While healthcare is still in the early stages of its Al journey, we are seeing pharmaceutical and other life sciences organizations making major investments in Al and related technologies.\" TOM LAWRY | National Director for Al, Health and Life Sciences | Microsoft"

}

]

Text, Zeilen und Wörter

Das OCR-Lesemodell extrahiert gedruckten und handschriftlichen Text als lines und words. Das Modell gibt Koordinaten für das Begrenzungs-polygon und confidence für die extrahierten Wörter aus. Die styles-Auflistung enthält alle handschriftlichen Formatvorlagen für Zeilen (sofern erkannt) sowie die Spannen, die auf den zugeordneten Text zeigen. Dieses Feature gilt für unterstützte handschriftliche Sprachen.

Für Microsoft Word, Excel, PowerPoint und HTML extrahiert das Lesemodell Version 3.1 und später den gesamten eingebetteten Text unverändert. Texte werden als Wörter und Absätze extrahiert. Eingebettete Bilder werden nicht unterstützt.

"words": [

{

"content": "While",

"polygon": [],

"confidence": 0.997,

"span": {}

},

],

"lines": [

{

"content": "While healthcare is still in the early stages of its Al journey, we",

"polygon": [],

"spans": [],

}

]

Handschriftlicher Text für Textzeilen

Die Antwort umfasst die Klassifizierung, ob es sich bei den einzelnen Textzeilen um einen handschriftlichen Stil handelt, sowie eine Konfidenzbewertung. Weitere Informationen finden Sie im Abschnitt zurUnterstützung für handschriftlichen Text. Das folgende Beispiel zeigt einen beispielhaften JSON-Ausschnitt.

"styles": [

{

"confidence": 0.95,

"spans": [

{

"offset": 509,

"length": 24

}

"isHandwritten": true

]

}

Wenn Sie die Add-On-Funktion für Schriftart/Schriftschnitt aktiviert haben, erhalten Sie als Teil des styles-Objekts auch das Ergebnis für die Schriftart und den Schriftschnitt.

Nächste Schritte

Schnellstart für Dokument Intelligenz:

Erkunden Sie unsere REST-API: