Multimodale Einbettungen (Version 4.0)

Multimodale Einbettungen ist der Prozess des Generierens einer numerischen Darstellung eines Bildes, die seine Features und Merkmale in einem Vektorformat erfasst. Diese Vektoren codieren den Inhalt und den Kontext eines Bildes auf eine Weise, die mit der Textsuche über denselben Vektorraum kompatibel ist.

Bildabrufsysteme haben traditionell aus den Bildern extrahierte Features wie Inhaltsbezeichnungen, Tags und Deskriptoren für Bilder verwendet, um Bilder zu vergleichen und nach Ähnlichkeit zu bewerten. Die Vektorähnlichkeitssuche gewinnt jedoch aufgrund einer Reihe von Vorteilen gegenüber der traditionellen, auf Schlüsselwörtern basierenden Suche an Popularität und wird zu einer wichtigen Komponente in beliebten Inhaltssuchdiensten.

Was ist der Unterschied zwischen der Vektorsuche und der auf Schlüsselwörtern basierten Suche?

Die Schlüsselwortsuche ist die einfachste und traditionellste Methode zum Informationsabruf. Bei diesem Ansatz sucht die Suchmaschine nach der exakten Übereinstimmung der Schlüsselwörter oder Ausdrücke, die der bzw. die Benutzer*in in der Suchabfrage eingegeben hat, und vergleicht sie mit Bezeichnungen und Tags, die für die Bilder bereitgestellt werden. Die Suchmaschine gibt dann Bilder zurück, die genau diese Schlüsselwörter als Inhaltstags und Bildbezeichnungen enthalten. Die Schlüsselwortsuche hängt stark von der Fähigkeit des Benutzers bzw. der Benutzer*in ab, relevante und spezifische Suchbegriffe einzugeben.

Die Vektorsuche durchsucht große Sammlungen von Vektoren im hochdimensionalen Raum, um Vektoren zu finden, die einer bestimmten Abfrage ähneln. Die Vektorsuche sucht nach semantischen Ähnlichkeiten, indem sie den Kontext und die Bedeutung der Suchabfrage erfasst. Dieser Ansatz ist oft effizienter als herkömmliche Bildabruftechniken, da er den Suchraum reduzieren und die Genauigkeit der Ergebnisse verbessern kann.

Geschäftsanwendungen

Multimodale Einbettung kann in vielen Bereichen angewendet werden, darunter:

- Verwaltung digitaler Ressourcen: Multimodale Einbettung kann verwendet werden, um große Sammlungen digitaler Bilder zu verwalten, z. B. in Museen, Archiven oder Onlinegalerien. Benutzer können Bilder basierend auf visuellen Merkmalen suchen und die Bilder abrufen, die ihren Kriterien entsprechen.

- Sicherheit und Überwachung: Vektorisierung kann in Sicherheits- und Überwachungssystemen verwendet werden, um Bilder basierend auf bestimmten Merkmalen oder Mustern zu suchen, z. B. bei der Personen- und Objektnachverfolgung oder bei der Bedrohungserkennung.

- Forensischer Bildabruf: Vektorisierung kann in forensischen Untersuchungen verwendet werden, um Bilder basierend auf ihren visuellen Inhalten oder Metadaten zu suchen, z. B. in Fällen von Cyberkriminalität.

- E-Commerce: Vektorisierung kann in Online-Shopping-Anwendungen verwendet werden, um nach ähnlichen Produkten basierend auf ihren Merkmalen oder Beschreibungen zu suchen oder Empfehlungen basierend auf vorherigen Käufen bereitzustellen.

- Mode und Design: Vektorisierung kann in Mode und Design verwendet werden, um Bilder basierend auf ihren visuellen Merkmalen wie Farbe, Muster oder Textur zu suchen. Dies kann Designern oder Einzelhändlern helfen, ähnliche Produkte oder Trends zu identifizieren.

Achtung

Multimodale Einbettung ist nicht dafür konzipiert, medizinische Bilder für Diagnosefunktionen oder Krankheitsmuster zu analysieren. Verwenden Sie die multimodale Einbettung nicht für medizinische Zwecke.

Was sind Vektoreinbettungen?

Vektoreinbettungen sind eine Möglichkeit, Inhalte – Text oder Bilder – als Vektoren realer Zahlen in einem hochdimensionalen Raum darzustellen. Vektoreinbettungen werden häufig aus großen Mengen von textuellen und visuellen Daten mithilfe von Algorithmen für maschinelles Lernen gelernt, beispielsweise ein neuronales Netz.

Jede Dimension des Vektors entspricht einem anderen Merkmal oder Attribut des Inhalts, beispielsweise seiner semantischen Bedeutung, der syntaktischen Rolle oder dem Kontext, in dem er häufig angezeigt wird. In Azure KI Vision weisen Bild- und Textvektoreinbettungen 1024 Dimensionen auf.

Wichtig

Vektoreinbettungen können nur verglichen und einander zugeordnet werden, wenn sie vom gleichen Modelltyp stammen. Bilder, die von einem Modell vektorisiert werden, können nicht über ein anderes Modell durchsucht werden. Die neueste Bildanalyse-API bietet zwei Modelle: Version 2023-04-15 unterstützt die Textsuche in vielen Sprachen, und das ältere 2022-04-11-Modell unterstützt nur Englisch.

Wie funktioniert dies?

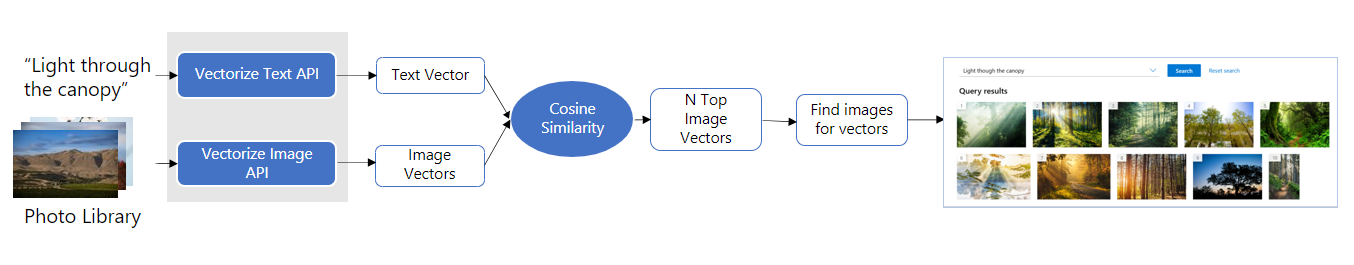

Im Folgenden werden die wichtigsten Schritte des Bildabrufprozesses mithilfe von multimodalen Einbettungen beschrieben.

Vektorisieren von Bildern und Text: Die multimodalen Einbettungs-APIs VectorizeImage und VectorizeText können verwendet werden, um Merkmalvektoren aus einem Bild respektive Text zu extrahieren. Die APIs geben einen einzelnen Merkmalvektor zurück, der die gesamte Eingabe darstellt.

Hinweis

Multimodale Einbettung führt keine biometrische Verarbeitung von menschlichen Gesichtern durch. Informationen zur Gesichtserkennung und -identifizierung finden Sie im Azure KI-Gesichtserkennungsdienst.

Messen der Ähnlichkeit: Vektorsuchsysteme verwenden in der Regel Abstandsmetriken wie den Kosinusabstand oder den euklidische Abstand, um Vektoren zu vergleichen und nach Ähnlichkeit zu bewerten. Die Vision Studio-Demo verwendet den Kosinusabstand, um die Ähnlichkeit zu messen.

Abrufen von Bildern: Verwenden Sie die obersten N Vektoren ähnlich wie bei der Suchabfrage, und rufen Sie Bilder aus Ihrer Fotobibliothek ab, die diesen Vektoren entsprechen, um sie als Endergebnis bereitzustellen.

Relevanzbewertung

Die Bild- und Videoempfangsdienste geben ein Feld mit dem Namen „Relevanz“ zurück. Der Begriff „Relevanz“ bezeichnet ein Maß für die Ähnlichkeitsbewertung zwischen einer Abfrage und Bild- oder Videoframe-Einbettungen. Die Relevanzbewertung besteht aus zwei Teilen:

- Die Kosinusähnlichkeit, die (im Bereich von [0,1]) zwischen der Abfrage und Bild- oder Videoframe-Einbettungen liegt.

- Eine Metadatenbewertung, welche die Ähnlichkeit zwischen der Abfrage und den Metadaten widerspiegelt, die dem Bild- oder Videoframe zugeordnet sind.

Wichtig

Die Relevanzbewertung ist ein gutes Maß, um Ergebnisse wie Bilder oder Videoframes in Bezug auf eine einzelne Abfrage zu bewerten. Die Relevanzbewertung kann jedoch nicht exakt in Abfragen verglichen werden. Daher ist es nicht möglich, die Relevanzbewertung einem Konfidenzniveau zuzuordnen. Es ist auch nicht möglich, einen Schwellenwertalgorithmus zu erstellen, um irrelevante Ergebnisse basierend ausschließlich auf der Relevanzbewertung zu beseitigen.

Eingabeanforderungen

Bildeingabe

- Die Dateigröße muss weniger als 20 MB betragen.

- Die Abmessungen des Bilds müssen größer als 10 x 10 Pixel und kleiner als 16.000 x 16.000 Pixel sein.

Texteingabe

- Die Textzeichenfolge muss zwischen (einschließlich) einem Wort und 70 Wörtern lang sein.

Nächste Schritte

Aktivieren Sie multimodale Einbettungen für Ihren Suchdienst und folgen Sie den Schritten zum Generieren von Vektoreinbettungen für Text und Bilder.