Adatok migrálása helyszíni Netezza-kiszolgálóról az Azure-ba az Azure Data Factory használatával

A következőkre vonatkozik: Azure Data Factory

Azure Data Factory  Azure Synapse Analytics

Azure Synapse Analytics

Tipp.

Próbálja ki a Data Factoryt a Microsoft Fabricben, amely egy teljes körű elemzési megoldás a nagyvállalatok számára. A Microsoft Fabric az adattovábbítástól az adatelemzésig, a valós idejű elemzésig, az üzleti intelligenciáig és a jelentéskészítésig mindent lefed. Ismerje meg, hogyan indíthat új próbaverziót ingyenesen!

Az Azure Data Factory hatékony, robusztus és költséghatékony mechanizmust biztosít az adatok nagy léptékű migrálásához a helyszíni Netezza-kiszolgálóról az Azure Storage-fiókba vagy az Azure Synapse Analytics-adatbázisba.

Ez a cikk az alábbi információkat tartalmazza az adatmérnökök és fejlesztők számára:

- Teljesítmény

- Másolási rugalmasság

- Network security

- Magas szintű megoldásarchitektúra

- Ajánlott megvalósítási eljárások

Teljesítmény

Az Azure Data Factory kiszolgáló nélküli architektúrát kínál, amely lehetővé teszi a párhuzamosságot különböző szinteken. Ha Ön fejlesztő, ez azt jelenti, hogy olyan folyamatokat hozhat létre, amely teljes mértékben kihasználja a hálózati és az adatbázis-sávszélességet az adatáthelyezési sebesség maximalizálása érdekében a környezet számára.

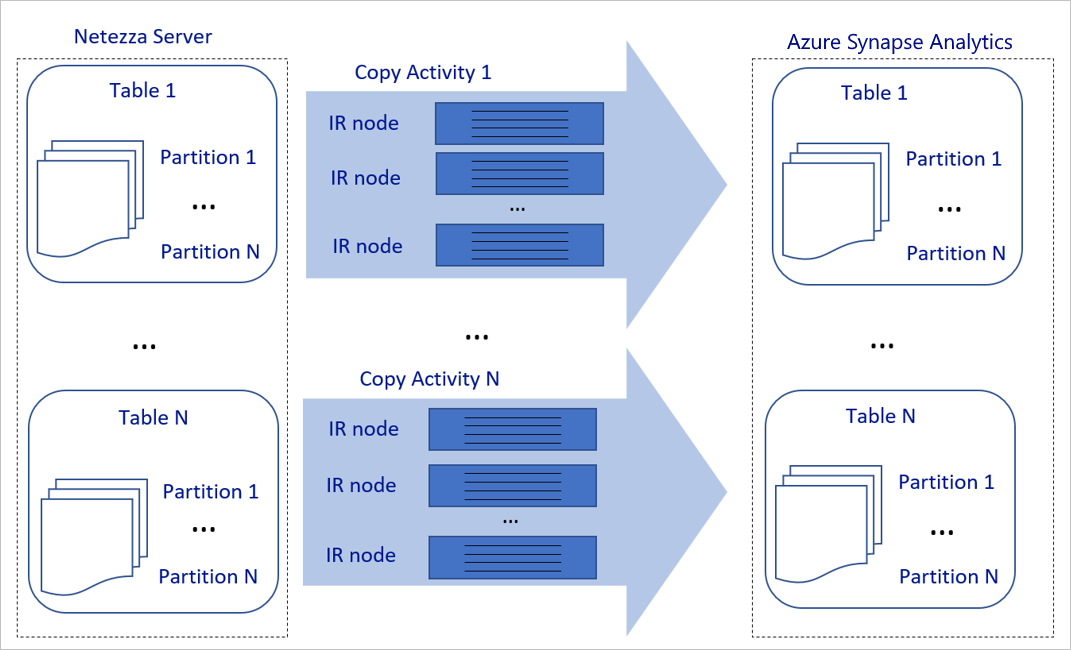

Az előző diagram a következőképpen értelmezhető:

Egy másolási tevékenység kihasználhatja a méretezhető számítási erőforrások előnyeit. Az Azure Integration Runtime használata esetén kiszolgáló nélküli módon legfeljebb 256 DIU-t adhat meg minden másolási tevékenységhez. Egy saját üzemeltetésű integrációs modul (saját üzemeltetésű integrációs modul) segítségével manuálisan skálázhatja fel a gépet, vagy több gépre (legfeljebb négy csomópontra) méretezheti a skálázást, és egyetlen másolási tevékenység minden csomóponton elosztja a partícióját.

Egy másolási tevékenység több szál használatával olvas és ír az adattárba.

Az Azure Data Factory vezérlési folyamata több másolási tevékenységet is elindíthat párhuzamosan. Például elindíthatja őket egy For Each ciklus használatával.

További információ: Copy tevékenység teljesítmény- és méretezhetőségi útmutató.

Rugalmasság

Egy másolási tevékenységen belül az Azure Data Factory beépített újrapróbálkozási mechanizmussal rendelkezik, amely lehetővé teszi az adattárakban vagy a mögöttes hálózaton előforduló átmeneti hibák bizonyos szintű kezelését.

Az Azure Data Factory másolási tevékenységével, amikor adatokat másol a forrás- és fogadóadattárak között, kétféleképpen kezelheti a nem kompatibilis sorokat. Megszakíthatja és meghiúsulhatja a másolási tevékenységet, vagy folytathatja a többi adat másolását a nem kompatibilis adatsorok kihagyásával. Emellett a hiba okának megismeréséhez naplózhatja a nem kompatibilis sorokat az Azure Blob Storage-ban vagy az Azure Data Lake Store-ban, kijavíthatja az adatokat az adatforráson, és újra megpróbálhatja a másolási tevékenységet.

Network security

Az Azure Data Factory alapértelmezés szerint a helyszíni Netezza-kiszolgálóról egy Azure Storage-fiókba vagy Azure Synapse Analytics-adatbázisba továbbítja az adatokat titkosított kapcsolattal a Hypertext Transfer Protocol Secure (HTTPS) protokollon keresztül. A HTTPS adattitkosítást biztosít az átvitel során, és megakadályozza a lehallgatást és a közbeékelt támadásokat.

Másik lehetőségként, ha nem szeretné, hogy az adatok a nyilvános interneten keresztül legyenek átadva, az Azure Express Route-on keresztüli privát társviszony-létesítési hivatkozáson keresztüli adatátadással nagyobb biztonságot érhet el.

A következő szakasz a magasabb biztonság elérését ismerteti.

Megoldásarchitektúra

Ez a szakasz az adatok migrálásának két módját ismerteti.

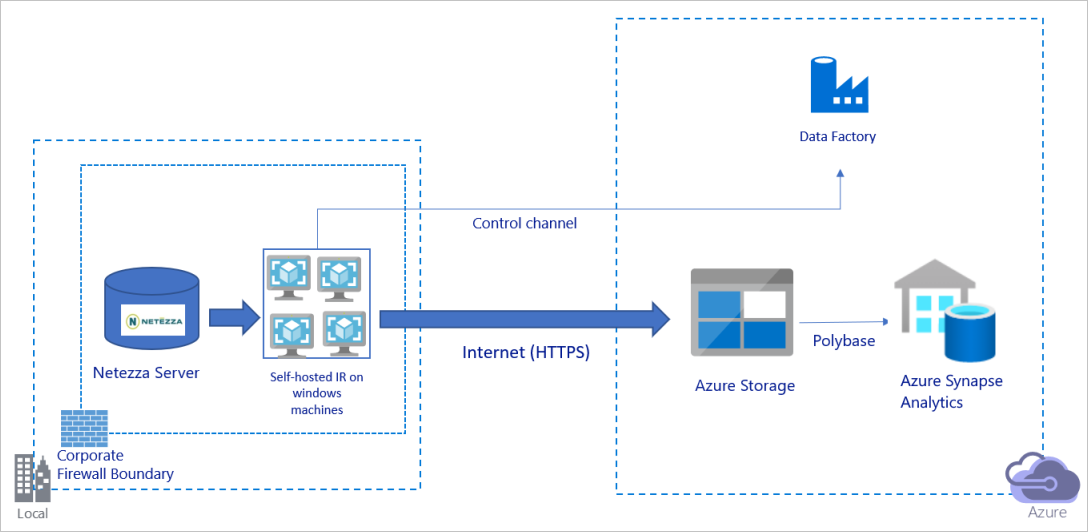

Adatok migrálása a nyilvános interneten keresztül

Az előző diagram a következőképpen értelmezhető:

Ebben az architektúrában biztonságosan továbbíthatja az adatokat HTTPS használatával a nyilvános interneten keresztül.

Az architektúra eléréséhez telepítenie kell az Azure Data Factory integrációs modult (saját üzemeltetésű) egy windowsos gépre egy vállalati tűzfal mögött. Győződjön meg arról, hogy ez az integrációs modul közvetlenül hozzáfér a Netezza-kiszolgálóhoz. Ha teljes mértékben használni szeretné a hálózati és adattárolási sávszélességet az adatok másolásához, manuálisan skálázhatja fel a gépet, vagy több gépre is méretezheti a skálázást.

Az architektúra használatával migrálhatja a kezdeti pillanatképadatokat és a deltaadatokat is.

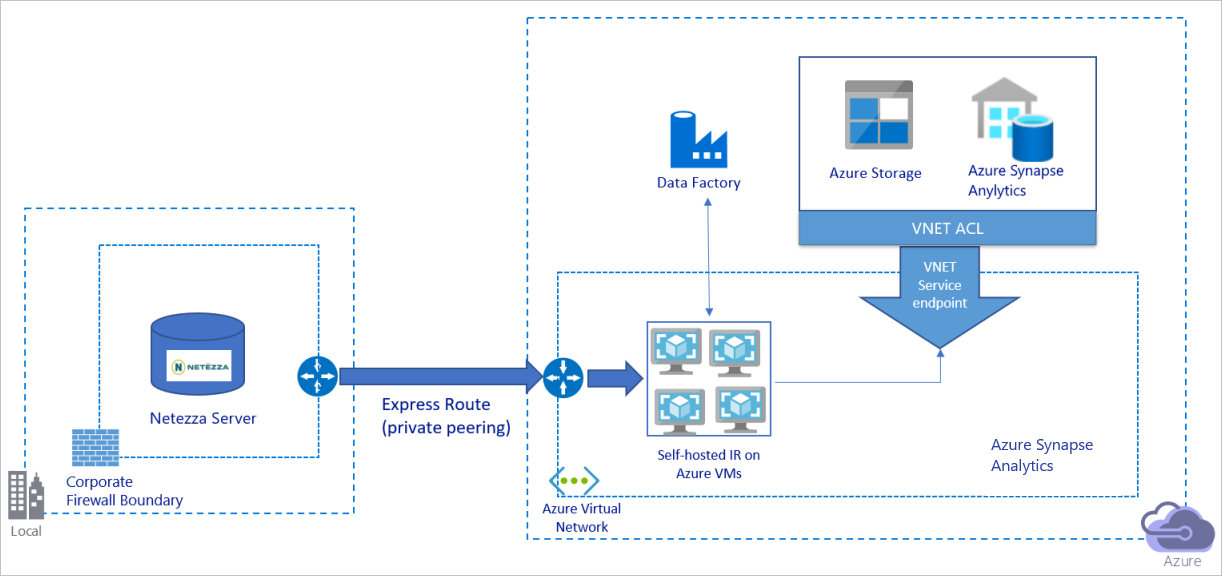

Adatok migrálása magánhálózaton keresztül

Az előző diagram a következőképpen értelmezhető:

Ebben az architektúrában egy privát társviszony-létesítési hivatkozáson keresztül migrálhatja az adatokat az Azure Express Route-on keresztül, és az adatok soha nem haladnak át a nyilvános interneten.

Az architektúra eléréséhez telepítenie kell az Azure Data Factory integrációs modult (saját üzemeltetésű) egy Windows rendszerű virtuális gépre (VM) az Azure-beli virtuális hálózaton belül. Ha teljes mértékben szeretné használni a hálózati és adattárolási sávszélességet az adatok másolásához, manuálisan skálázhatja fel a virtuális gépet, vagy vertikálisan felskálázhatja több virtuális gépre.

Az architektúra használatával migrálhatja a kezdeti pillanatképadatokat és a deltaadatokat is.

Ajánlott eljárások megvalósítása

Hitelesítés és hitelesítő adatok kezelése

A Netezza-hitelesítéshez ODBC-hitelesítést használhat kapcsolati sztring keresztül.

Hitelesítés az Azure Blob Storage-ban:

Erősen javasoljuk, hogy felügyelt identitásokat használjunk az Azure-erőforrásokhoz. A Microsoft Entra ID-ban automatikusan felügyelt Azure Data Factory-identitásra épülő felügyelt identitások lehetővé teszik a folyamatok konfigurálását anélkül, hogy hitelesítő adatokat kellene megadniuk a társított szolgáltatás definíciójában.

Az Azure Blob Storage szolgáltatásnévvel, közös hozzáférésű jogosultságkóddal vagy tárfiók-kulccsal is hitelesíthető.

Hitelesítés az Azure Data Lake Storage Gen2-ben:

Erősen javasoljuk, hogy felügyelt identitásokat használjunk az Azure-erőforrásokhoz.

Használhat szolgáltatásnevet vagy tárfiókkulcsot is.

Hitelesítés az Azure Synapse Analyticsben:

Erősen javasoljuk, hogy felügyelt identitásokat használjunk az Azure-erőforrásokhoz.

Szolgáltatásnév vagy SQL-hitelesítés is használható.

Ha nem felügyelt identitásokat használ az Azure-erőforrásokhoz, javasoljuk , hogy tárolja a hitelesítő adatokat az Azure Key Vaultban , hogy egyszerűbbé tegye a kulcsok központi kezelését és elforgatását anélkül, hogy módosítania kellene az Azure Data Factory társított szolgáltatásait. Ez a CI/CD egyik ajánlott eljárása is.

Kezdeti pillanatképadatok migrálása

Kis méretű táblák esetén (azaz a 100 GB-nál kisebb kötetű vagy két órán belül az Azure-ba migrálható táblák esetében) minden egyes másolási feladat adatait táblázatonként betöltheti. A nagyobb átviteli sebesség érdekében több Azure Data Factory másolási feladatot is futtathat, hogy egyidejűleg külön táblákat töltsön be.

Az egyes másolási feladatokban a párhuzamos lekérdezések futtatásához és az adatok partíciók szerinti másolásához a tulajdonságbeállítással a következő adatpartíciós beállítások egyikével is elérheti a parallelCopies párhuzamosság bizonyos szintjét:

A nagyobb hatékonyság érdekében javasoljuk, hogy egy adatszeletből kezdjen. Győződjön meg arról, hogy a

parallelCopiesbeállítás értéke kisebb, mint a Netezza-kiszolgálón lévő táblában lévő adatszeletpartíciók teljes száma.Ha az egyes adatszelet-partíciók mennyisége továbbra is nagy (például 10 GB vagy nagyobb), javasoljuk, hogy váltson dinamikus tartománypartícióra. Ez a beállítás nagyobb rugalmasságot biztosít a partíciók számának és az egyes partíciók kötetének definiálásához partícióoszlop, felső és alsó kötés szerint.

Nagyobb táblák esetén (azaz a 100 GB-os vagy nagyobb kötetű táblák esetében, vagy amelyek két órán belül nem migrálhatók az Azure-ba), javasoljuk, hogy az adatokat egyéni lekérdezéssel particionálja, majd minden másolási feladat egy partíciót másoljon egy-egy partícióra. A jobb átviteli sebesség érdekében egyszerre több Azure Data Factory másolási feladatot is futtathat. Minden egyes másolási feladat esetében, amely egy partíciót tölt be egyéni lekérdezéssel, növelheti az átviteli sebességet az adatszelet vagy a dinamikus tartomány párhuzamosságának engedélyezésével.

Ha egy másolási feladat hálózati vagy adattárbeli átmeneti probléma miatt meghiúsul, újrafuttathatja a sikertelen másolási feladatot, hogy újra betöltse az adott partíciót a táblából. Más partíciókat betöltő másolási feladatokra nincs hatással.

Amikor adatokat tölt be egy Azure Synapse Analytics-adatbázisba, javasoljuk, hogy az Azure Blob Storage-beli másolási feladaton belül engedélyezze a PolyBase-t előkészítésként.

Változásadatok migrálása

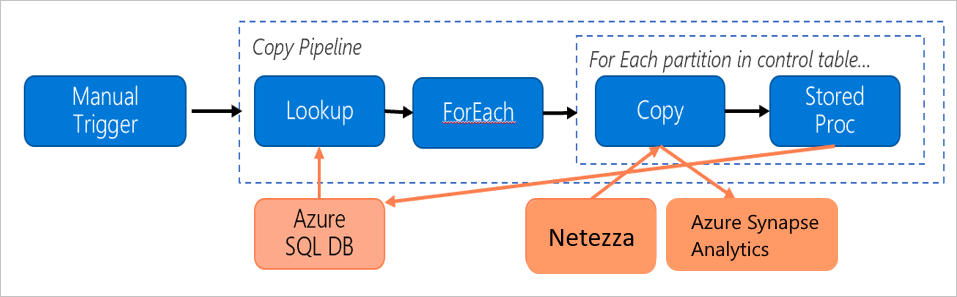

A táblázat új vagy frissített sorainak azonosításához használjon időbélyegoszlopot vagy egy növekményes kulcsot a sémán belül. Ezután a legújabb értéket magas vízjelként tárolhatja egy külső táblában, majd a következő adatbetöltéskor szűrheti a deltaadatokat.

Minden tábla egy másik vízjeloszlopot használhat az új vagy frissített sorok azonosításához. Javasoljuk, hogy hozzon létre egy külső vezérlőtáblát. A táblázatban minden sor egy táblát jelöl a Netezza-kiszolgálón, annak konkrét vízjel oszlopnevével és magas vízjelértékével.

Saját üzemeltetésű integrációs modul konfigurálása

Ha adatokat migrál a Netezza-kiszolgálóról az Azure-ba, függetlenül attól, hogy a kiszolgáló a vállalati tűzfal mögött vagy virtuális hálózati környezetben található-e, telepítenie kell egy saját üzemeltetésű integrációs modult egy Windows-gépen vagy virtuális gépen, amely az adatok áthelyezéséhez használt motor. A saját üzemeltetésű integrációs modul telepítése során a következő megközelítést javasoljuk:

Minden Windows rendszerű géphez vagy virtuális géphez 32 vCPU- és 128 GB-os memóriát kell konfigurálni. Az adatmigrálás során folyamatosan figyelheti az integrációs modul számítógépének processzor- és memóriahasználatát, hogy lássa, fel kell-e skáláznia a gépet a jobb teljesítmény érdekében, vagy leskálázhatja a gépet a költségek megtakarítása érdekében.

A vertikális felskálázáshoz akár négy csomópontot is társíthat egyetlen saját üzemeltetésű integrációs modullal. A saját üzemeltetésű integrációs modulon futó egyetlen másolási feladat automatikusan alkalmazza az összes virtuálisgép-csomópontot az adatok párhuzamos másolására. A magas rendelkezésre állás érdekében kezdjen négy virtuálisgép-csomóponttal, hogy elkerülje az adatmigrálás során előforduló egyetlen meghibásodási pontot.

Partíciók korlátozása

Ajánlott eljárásként készítsen egy teljesítményigazolást (POC) egy reprezentatív mintaadatkészlettel, hogy minden másolási tevékenységhez meg tudja határozni a megfelelő partícióméretet. Javasoljuk, hogy minden partíciót két órán belül töltsön be az Azure-ba.

Táblázat másolásához kezdje egyetlen másolási tevékenységgel egyetlen, saját üzemeltetésű integrációs modullal. Fokozatosan növelje a parallelCopies beállítást a tábla adatszeletelési partícióinak száma alapján. Ellenőrizze, hogy a teljes tábla betölthető-e az Azure-ba két órán belül a másolási feladatból származó átviteli sebességnek megfelelően.

Ha két órán belül nem tölthető be az Azure-ba, és a saját üzemeltetésű INTEGRÁCIÓS csomópont és az adattár kapacitása nincs teljesen kihasználva, fokozatosan növelje az egyidejű másolási tevékenységek számát, amíg el nem éri a hálózat vagy az adattárak sávszélességkorlátját.

Folyamatosan monitorozza a processzor- és memóriahasználatot a saját üzemeltetésű integrációs modult futtató gépen, és készen áll a gép vertikális felskálázására vagy több gépre történő skálázásra, ha azt látja, hogy a processzor és a memória teljes mértékben használatban van.

Ha szabályozási hibákba ütközik az Azure Data Factory másolási tevékenységének jelentése szerint, csökkentse az egyidejűséget vagy parallelCopies a beállítást az Azure Data Factoryben, vagy fontolja meg a hálózat és az adattárak sávszélesség- vagy I/O-műveleteinek másodpercenkénti (IOPS) korlátozásának növelését.

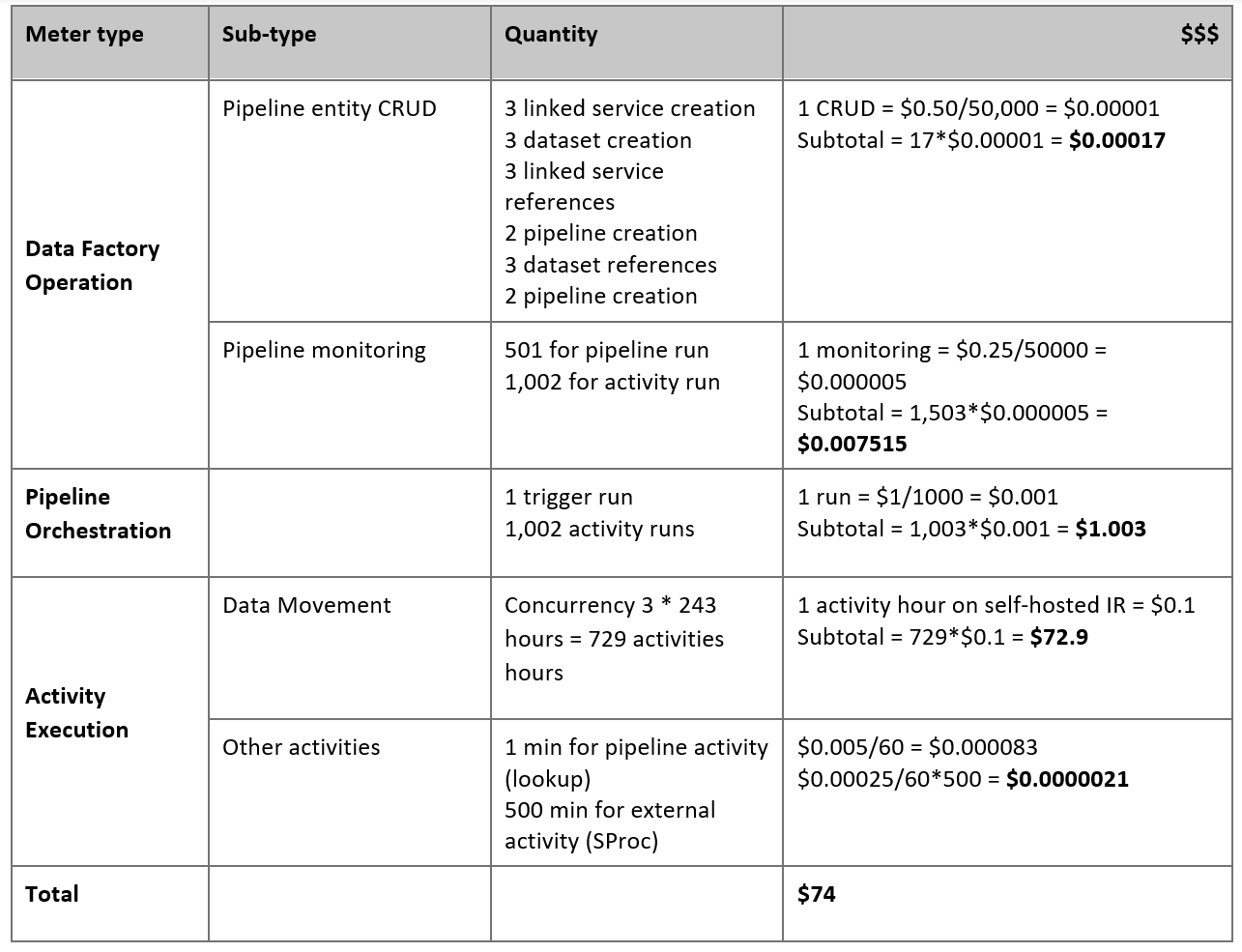

A díjszabás becslése

Fontolja meg a következő folyamatot, amely a helyszíni Netezza-kiszolgálóról egy Azure Synapse Analytics-adatbázisba való adatok migrálásához készült:

Tegyük fel, hogy a következő állítások igazak:

A teljes adatmennyiség 50 terabájt (TB).

Az adatokat az első megoldás architektúrájának használatával migráljuk (a Netezza-kiszolgáló a helyszínen található, a tűzfal mögött).

Az 50 TB-os kötet 500 partícióra van osztva, és minden másolási tevékenység egy partíciót helyez át.

Minden másolási tevékenység egy saját üzemeltetésű integrációs modullal van konfigurálva négy gépen, és másodpercenként 20 megabájtos átviteli sebességet (MBps) ér el. (A másolási tevékenységen

parallelCopiesbelül 4 értékre van állítva, és minden olyan szál, amely adatokat tölt be a táblából, 5 MBps átviteli sebességet ér el.)A ForEach egyidejűsége 3, az összesített átviteli sebesség pedig 60 MBps.

A migrálás összesen 243 órát vesz igénybe.

Az előző feltételezések alapján a becsült ár a következő:

Megjegyzés:

Az előző táblázatban látható díjszabás hipotetikus. A tényleges díjszabás a környezet tényleges átviteli sebességétől függ. A Windows rendszerű gép ára (a saját üzemeltetésű integrációs modul telepítve) nem szerepel a csomagban.

További referenciák

További információkért tekintse meg az alábbi cikkeket és útmutatókat:

- Netezza-összekötő

- ODBC-összekötő

- Azure Blob Storage-összekötő

- Azure Data Lake Storage Gen2-összekötő

- Azure Synapse Analytics-összekötő

- Copy tevékenység teljesítmény finomhangolási útmutatója

- Create and configure a self-hosted integration runtime

- Saját üzemeltetésű integrációs modul – HA és méretezhetőség

- Adatáthelyezési biztonsági szempontok

- Hitelesítő adatok tárolása az Azure Key Vaultban

- Adatok növekményes másolása egy táblából

- Adatok növekményes másolása több táblából

- Az Azure Data Factory díjszabási oldala