Integrar o Apache Zeppelin com o Hive Warehouse Connector no Azure HDInsight

Os clusters do HDInsight Spark incluem notebooks Apache Zeppelin com diferentes intérpretes. Neste artigo, nos concentramos apenas no interpretador Livy para acessar tabelas do Hive a partir do Spark usando o Hive Warehouse Connector.

Nota

Este artigo contém referências a um termo que a Microsoft já não utiliza. Quando o termo for removido do software, iremos removê-lo deste artigo.

Pré-requisito

Conclua as etapas de configuração do Hive Warehouse Connector.

Introdução

Use o comando ssh para se conectar ao cluster do Apache Spark. Edite o seguinte comando substituindo CLUSTERNAME pelo nome do cluster e digite o comando:

ssh sshuser@CLUSTERNAME-ssh.azurehdinsight.netNa sessão ssh, execute o seguinte comando para anotar as versões de

hive-warehouse-connector-assemblyepyspark_hwc:ls /usr/hdp/current/hive_warehouse_connectorSalve a saída para uso posterior ao configurar o Apache Zeppelin.

Configurar o Livy

As configurações a seguir são necessárias para acessar as tabelas de hive do Zeppelin com o interpretador Livy.

Cluster de consulta interativo

Em um navegador da Web, navegue até

https://LLAPCLUSTERNAME.azurehdinsight.net/#/main/services/HDFS/configsonde LLAPCLUSTERNAME é o nome do cluster de Consulta Interativa.Navegue até >Advanced Custom core-site. Selecione Adicionar propriedade... para adicionar as seguintes configurações:

Configuração Value hadoop.proxyuser.livy.groups * hadoop.proxyuser.livy.hosts * Salve as alterações e reinicie todos os componentes afetados.

Aglomerado de faíscas

Em um navegador da Web, navegue até

https://CLUSTERNAME.azurehdinsight.net/#/main/services/SPARK2/configsonde CLUSTERNAME é o nome do cluster do Apache Spark.Expanda Custom livy2-conf. Selecione Adicionar propriedade... para adicionar a seguinte configuração:

Configuração Value livy.file.local-dir-whitelist /usr/hdp/atual/hive_warehouse_connector/ Salve as alterações e reinicie todos os componentes afetados.

Configurar o Livy Interpreter na interface do usuário do Zeppelin (Spark Cluster)

Em um navegador da Web, navegue até

https://CLUSTERNAME.azurehdinsight.net/zeppelin/#/interpreter, ondeCLUSTERNAMEé o nome do cluster do Apache Spark.Navegue até livy2.

Adicione as seguintes configurações:

Configuração Value livy.spark.hadoop.hive.llap.daemon.service.hosts @llap0 livy.spark.security.credentials.hiveserver2.enabled verdadeiro livy.spark.sql.hive.llap verdadeiro livy.spark.yarn.security.credentials.hiveserver2.enabled verdadeiro livy.superusuários Lívio, Zeppelin livy.spark.jars file:///usr/hdp/current/hive_warehouse_connector/hive-warehouse-connector-assembly-VERSION.jar.

Substitua VERSION pelo valor obtido em Introdução, anteriormente.livy.spark.submit.pyArquivos file:///usr/hdp/current/hive_warehouse_connector/pyspark_hwc-VERSION.zip.

Substitua VERSION pelo valor obtido em Introdução, anteriormente.livy.spark.sql.hive.hiveserver2.jdbc.url Defina-o como a URL JDBC interativa do HiveServer2 do cluster de consulta interativa. spark.security.credentials.hiveserver2.enabled verdadeiro Apenas para clusters ESP, adicione a seguinte configuração:

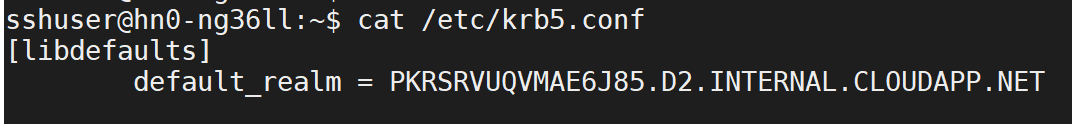

Configuração Value livy.spark.sql.hive.hiveserver2.jdbc.url.principal hive/_HOST@<AAD-Domain>Use o comando ssh para se conectar ao cluster de Consulta Interativa. Procure

default_realmo/etc/krb5.confparâmetro no arquivo. Substitua<AAD-DOMAIN>por esse valor como uma cadeia de caracteres maiúscula, caso contrário, a credencial não poderá ser encontrada.

Salve as alterações e reinicie o intérprete Livy.

Se o interpretador Livy não estiver acessível, modifique o shiro.ini arquivo presente no componente Zeppelin no Ambari. Para obter mais informações, consulte Configurando a segurança do Apache Zeppelin.

Executando consultas no Zeppelin

Inicie um bloco de anotações do Zeppelin usando o interpretador Livy e execute o seguinte

%livy2

import com.hortonworks.hwc.HiveWarehouseSession

import com.hortonworks.hwc.HiveWarehouseSession._

import org.apache.spark.sql.SaveMode

# Initialize the hive context

val hive = HiveWarehouseSession.session(spark).build()

# Create a database

hive.createDatabase("hwc_db",true)

hive.setDatabase("hwc_db")

# Create a Hive table

hive.createTable("testers").ifNotExists().column("id", "bigint").column("name", "string").create()

val dataDF = Seq( (1, "foo"), (2, "bar"), (8, "john")).toDF("id", "name")

# Validate writes to the table

dataDF.write.format("com.hortonworks.spark.sql.hive.llap.HiveWarehouseConnector").mode("append").option("table", "hwc_db.testers").save()

# Validate reads

hive.executeQuery("select * from testers").show()