Обучение профессиональной голосовой модели

Из этой статьи вы узнаете, как обучить Пользовательский нейронный голос с помощью портала Speech Studio.

Внимание

Настраиваемое обучение нейронных голосов в настоящее время доступно только в некоторых регионах. После обучения модели голосовой связи в поддерживаемом регионе его можно скопировать в ресурс "Речь" в другом регионе по мере необходимости. Дополнительные сведения см. в сносках в таблице службы "Речь".

Длительность обучения зависит от того, сколько данных вы используете. В среднем для обучения пользовательского нейронного голоса требуется около 40 часов вычислений. Пользователи со стандартной подпиской (S0) могут одновременно обучать четыре голоса. Если этот предел достигнут, подождите, пока хотя бы одна из моделей завершит обучение, а затем повторите попытку.

Примечание.

Хотя общее количество часов, необходимых для каждого метода обучения, зависит от одной и той же цены на единицу. Дополнительные сведения см. в разделе о ценах на настраиваемую нейронную подготовку.

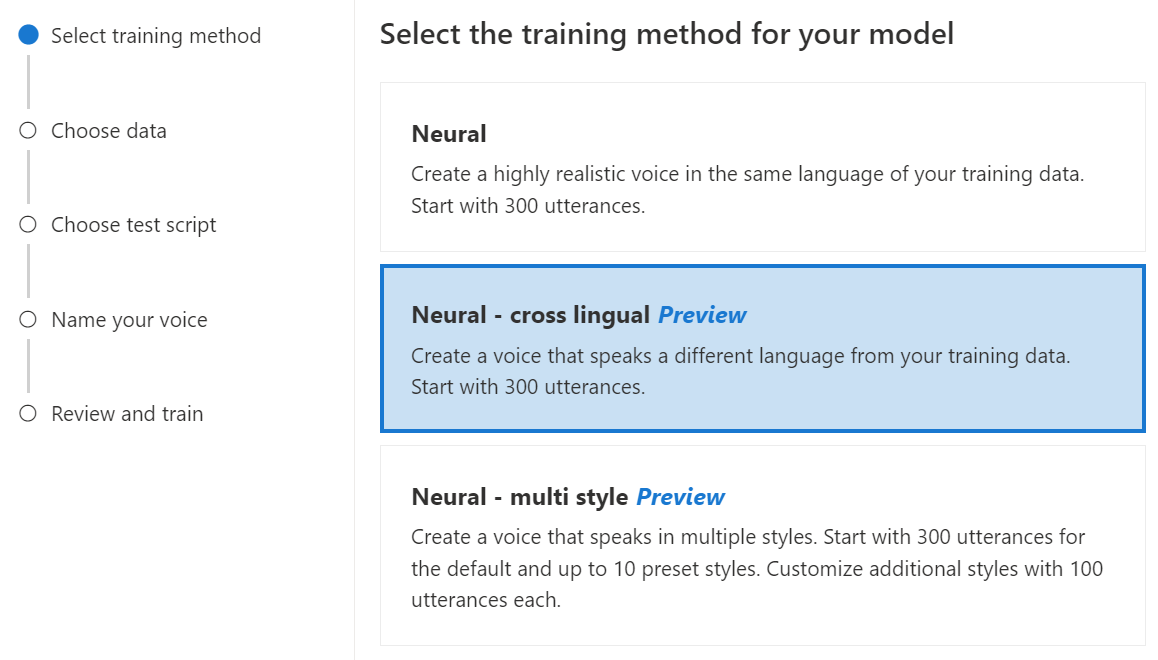

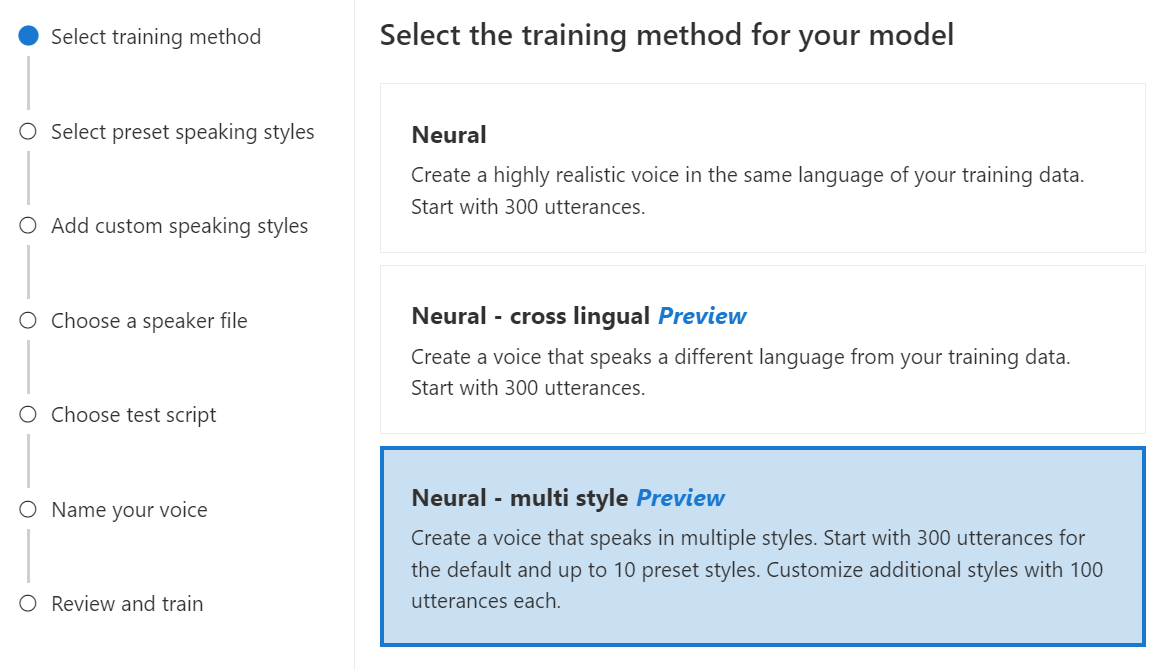

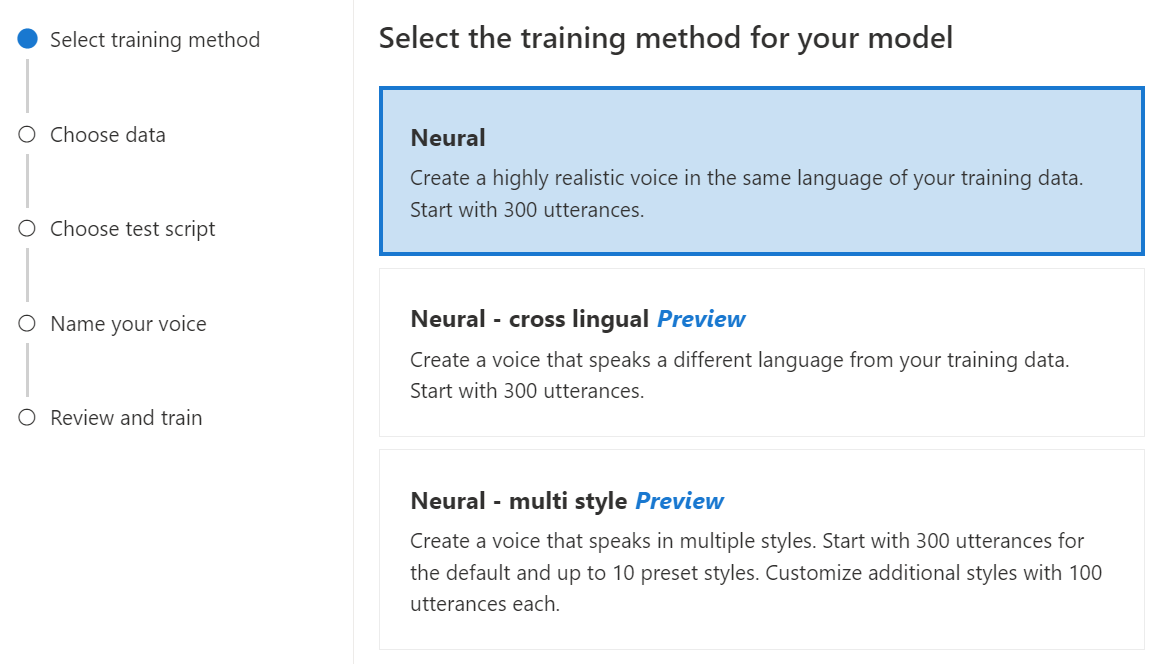

Выбор метода обучения

После проверки файлов данных используйте их для создания пользовательской нейронной голосовой модели. При создании пользовательского нейронного голоса вы можете обучить его одним из следующих методов:

Нейронный: создайте голос на том же языке данных обучения.

Нейронный — кросслингвальный: создайте голос, который говорит на другом языке, отличном от обучающих данных. Например, с

zh-CNпомощью обучающих данных можно создать голос, который говоритen-US.Язык обучающих данных и целевого языка должен быть одним из языков, которые поддерживаются для перекрестного обучения голосовой связи. Вам не нужно подготавливать обучающие данные на целевом языке, но тестовый скрипт должен находиться на целевом языке.

Нейронная — многоуровневая: создание пользовательского нейронного голоса, выступающего в нескольких стилях и эмоциях, без добавления новых обучающих данных. Несколько стилей голоса полезны для игровых персонажей, беседных чат-ботов, аудиокниг, средств чтения содержимого и многое другое.

Чтобы создать несколько стилей голоса, необходимо подготовить набор общих обучающих данных, по крайней мере 300 речевых фрагментов. Выберите один или несколько предустановленных стилей речи целевого объекта. Вы также можете создать несколько пользовательских стилей, предоставив примеры стилей, по крайней мере 100 речевых фрагментов на стиль, в качестве дополнительных обучающих данных для одного голоса. Поддерживаемые стили предустановок зависят от разных языков. Просмотрите доступные стили предустановок на разных языках.

Язык обучающих данных должен быть одним из языков, поддерживаемых для пользовательского нейронного голоса, перекрестного обучения или обучения по нескольким стилям.

Обучение модели пользовательского нейронного голоса

Чтобы создать пользовательский нейронный голос в Speech Studio, выполните следующие действия для одного из следующих методов:

Войдите в службу Speech Studio.

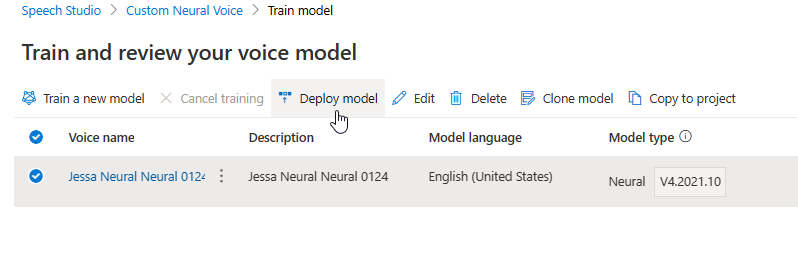

Выберите "Настраиваемый голосовой голос<>" Для обучения>>модели>обучения новой модели.

Выберите "Нейрон" в качестве метода обучения для модели и нажмите кнопку "Далее". Сведения об использовании другого метода обучения см. в разделе "Нейронная" — перекрестная или нейронная — многоуровневая.

Выберите версию рецепта обучения для модели. По умолчанию выбрана последняя версия. Поддерживаемые функции и время обучения могут отличаться по версии. Как правило, мы рекомендуем последнюю версию. В некоторых случаях можно выбрать более раннюю версию, чтобы сократить время обучения. Дополнительные сведения о двуязычной подготовке и различиях между языковыми стандартами см . в двуязычной подготовке .

Выберите данные, которые вы хотите использовать для обучения. Дубликаты аудиофайлов не будут использоваться в обучении. Убедитесь, что данные, которые вы выбрали, не содержат одинаковых звуковых имен в нескольких .zip файлах.

Вы можете выбрать только успешно обработанные наборы данных для обучения. Если вы не видите набор обучения в списке, проверка состояние обработки данных.

Выберите файл говорящего с оператором голосового таланта, соответствующий динамику в обучающих данных.

Выберите Далее.

Каждое обучение создает 100 примеров звуковых файлов автоматически, чтобы протестировать модель с помощью скрипта по умолчанию.

При необходимости можно также выбрать " Добавить собственный скрипт теста" и предоставить собственный скрипт теста до 100 речевых фрагментов, чтобы протестировать модель без дополнительных затрат. Созданные звуковые файлы — это сочетание скриптов автоматического тестирования и пользовательских скриптов тестирования. Дополнительные сведения см. в статье о требованиях к скрипту тестирования.

Введите имя, чтобы определить модель. Тщательно выбирайте имя. Имя модели используется в качестве голосового имени в запросе синтеза речи в пакете SDK и входных данных SSML. Разрешены только буквы, цифры и несколько знаков препинания. Используйте разные имена для разных нейронных голосовых моделей.

При необходимости введите описание , чтобы определить модель. Обычное использование описания заключается в записи имен данных, используемых для создания модели.

Выберите Далее.

Просмотрите параметры и выберите поле для принятия условий использования.

Нажмите кнопку "Отправить ", чтобы начать обучение модели.

Двуязычное обучение

Если выбрать тип обучения нейронных данных , вы можете обучить голос для выступления на нескольких языках. И местные zh-CN жители оба поддерживают двуязычное обучение для голоса, чтобы говорить как на китайском, так и zh-TW на английском языках. В зависимости от ваших обучающих данных синтезированный голос может говорить на английском языке с английским собственным акцентом или английским с тем же акцентом, что и данные обучения.

Примечание.

Чтобы включить голос в zh-CN языковом стандарте, чтобы говорить на английском языке с тем же акцентом, что и пример данных, следует выбрать Chinese (Mandarin, Simplified), English bilingual при создании проекта или указать zh-CN (English bilingual) языковой стандарт для данных набора обучения с помощью REST API.

В следующей таблице показаны различия между двумя языковыми стандартами:

| Языковой стандарт Speech Studio | Языковой стандарт REST API | Двуязычная поддержка |

|---|---|---|

Chinese (Mandarin, Simplified) |

zh-CN |

Если образец данных содержит английский, синтезированный голос говорит на английском языке с английским собственным акцентом вместо того же акцента, что и выборка данных, независимо от объема данных английского языка. |

Chinese (Mandarin, Simplified), English bilingual |

zh-CN (English bilingual) |

Если вы хотите, чтобы синтезированный голос говорил на английском языке с тем же акцентом, что и выборка данных, рекомендуется включить более 10 % данных английского языка в обучающий набор. В противном случае акцент на английском языке может быть не идеальным. |

Chinese (Taiwanese Mandarin, Traditional) |

zh-TW |

Если вы хотите обучить синтезированный голос, способный говорить на английском языке с тем же акцентом, что и образец данных, обязательно предоставьте более 10 % английских данных в учебном наборе. В противном случае он по умолчанию используется для английского собственного акцента. Пороговое значение 10 % вычисляется на основе данных, принятых после успешной отправки, а не данных перед отправкой. Если некоторые отправленные данные английского языка отклоняются из-за дефектов и не соответствуют пороговой значению 10 %, синтезированный голос по умолчанию используется для английского собственного акцента. |

Доступные стили предустановок на разных языках

В следующей таблице перечислены различные предустановленные стили в соответствии с различными языками.

| Стиль речи | Язык (языковой стандарт) |

|---|---|

| Сердиться | Английский (США) (en-US)Японский (Япония) ( ja-JP1) Китайский (Мандарин, упрощенное письмо) ( zh-CN) 1 |

| Спокойствие | Китайский (Мандарин, упрощенное письмо) (zh-CN) 1 |

| чат | Китайский (Мандарин, упрощенное письмо) (zh-CN) 1 |

| Веселый | Английский (США) (en-US)Японский (Япония) ( ja-JP1) Китайский (Мандарин, упрощенное письмо) ( zh-CN) 1 |

| Недовольных | Китайский (Мандарин, упрощенное письмо) (zh-CN) 1 |

| Взволнован | Английский (США) (en-US) |

| Страшно | Китайский (Мандарин, упрощенное письмо) (zh-CN) 1 |

| учетной | Английский (США) (en-US) |

| Надежды | Английский (США) (en-US) |

| Грустно | Английский (США) (en-US)Японский (Япония) ( ja-JP1) Китайский (Мандарин, упрощенное письмо) ( zh-CN) 1 |

| Кричать | Английский (США) (en-US) |

| Серьезные | Китайский (Мандарин, упрощенное письмо) (zh-CN) 1 |

| Ужасе | Английский (США) (en-US) |

| недружественный | Английский (США) (en-US) |

| Шепот | Английский (США) (en-US) |

1 Стиль нейронного голоса доступен в общедоступной предварительной версии. Стили в общедоступной предварительной версии доступны только в этих регионах службы: восточная часть США, Западная Европа и Юго-Восточная Азия.

В таблице обучения модели появится новая запись, соответствующая вновь созданной модели. Состояние отражает процесс преобразования данных в голосовую модель, как описано в этой таблице:

| Состояние | Значение |

|---|---|

| Обработка | Идет создание голосовой модели. |

| Выполнено | Голосовая модель создана и может быть развернута. |

| Неудачно | При обучении голосовой модели произошел сбой. Причиной сбоя могут быть, например, незамеченные проблемы с данными или неполадки в сети. |

| Отменено | Обучение модели голосовой связи отменено. |

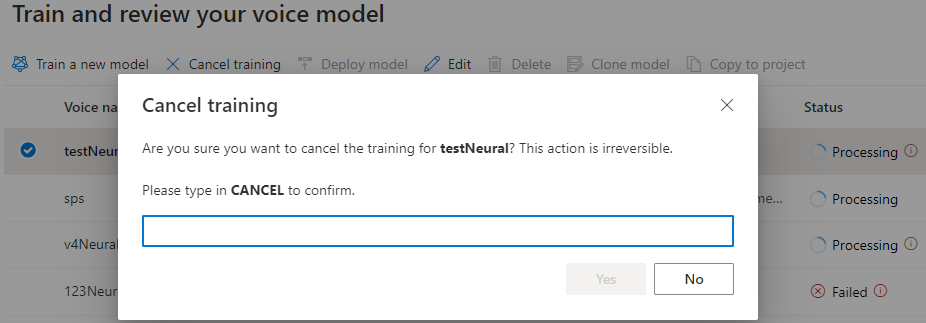

Пока состояние модели — обработка, можно выбрать команду "Отмена обучения", чтобы отменить модель голосовой связи. Плата за отмененное обучение не взимается.

После успешного обучения модели можно просмотреть сведения о модели и протестировать голосовую модель.

Вы можете использовать средство создания аудиоконтентов в Speech Studio для создания звука и точной настройки развернутого голоса. Если применимо для голоса, можно выбрать один из нескольких стилей.

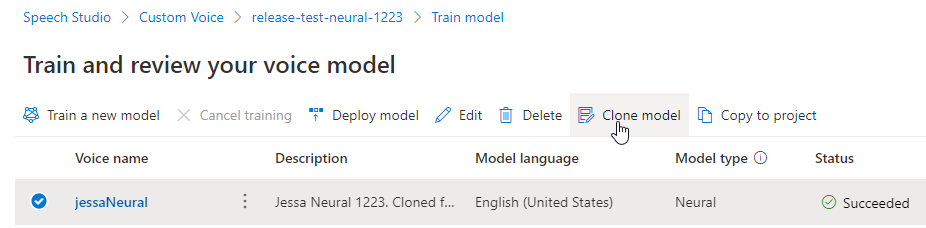

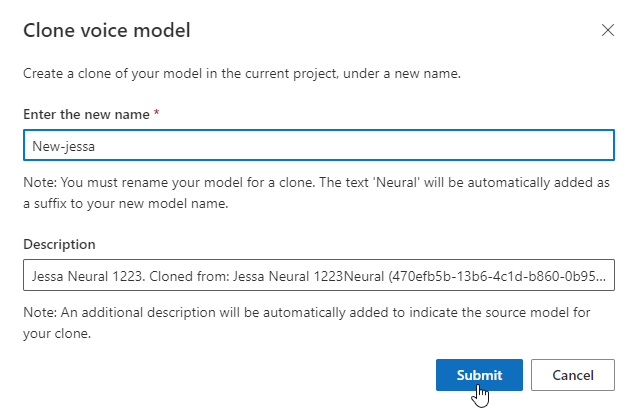

Переименование модели

Если вы хотите переименовать созданную модель, выберите "Клонировать модель", чтобы создать клон модели с новым именем в текущем проекте.

Введите новое имя в окне "Клонировать голосовую модель " и нажмите кнопку "Отправить". Текстовый нейрон автоматически добавляется в качестве суффикса в имя новой модели.

Тестирование голосовой модели

После успешной сборки модели голосовой связи можно использовать созданные примеры звуковых файлов для его тестирования перед развертыванием.

Качество голоса зависит от многих факторов, таких как:

- Размер набора обучающих данных.

- Качество записи.

- Правильность транскрипции.

- Насколько хорошо записанный голос в обучающих данных соответствует индивидуальному шаблону для вашего предполагаемого варианта использования.

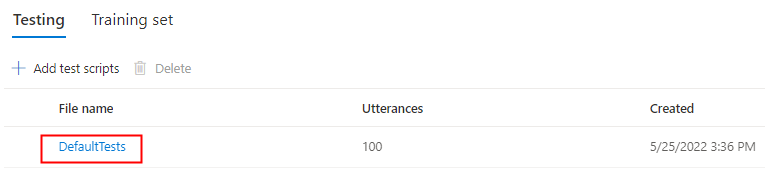

Выберите DefaultTests в разделе "Тестирование", чтобы прослушивать образец звуковых файлов. Примеры тестов по умолчанию включают 100 примеров звуковых файлов, созданных автоматически во время обучения, чтобы помочь вам протестировать модель. Помимо этих 100 звуковых файлов, предоставляемых по умолчанию, собственные речевые фрагменты скрипта тестирования также добавляются в набор DefaultTests . Это дополнение составляет не более 100 речевых фрагментов. Плата за тестирование с помощью DefaultTests не взимается.

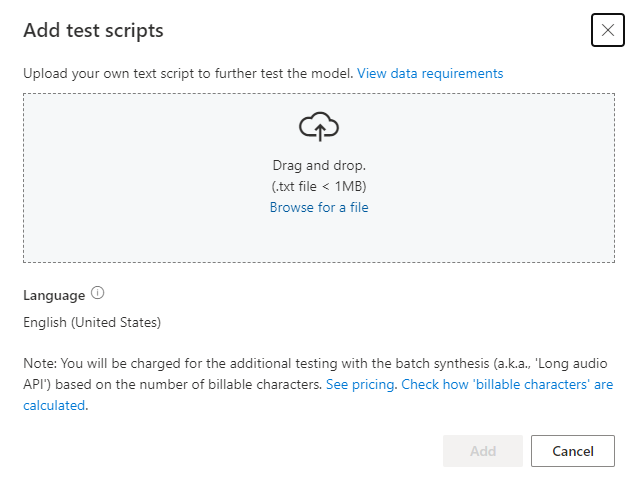

Если вы хотите отправить собственные тестовые скрипты для дальнейшего тестирования модели, выберите Add test scripts (Добавить тестовые скрипты).

Перед отправкой тестового скрипта проверка требования к скрипту тестирования. Плата за дополнительное тестирование с помощью пакетного синтеза взимается на основе количества оплачиваемых символов. См . цены на распознавание речи ВИ Azure.

В разделе "Добавить тестовые скрипты" выберите "Обзор файла ", чтобы выбрать собственный скрипт, а затем нажмите кнопку "Добавить ", чтобы отправить его.

Требования к скрипту тестирования

Тестовый скрипт должен быть файлом .txt, который меньше 1 МБ. В число поддерживаемых форматов кодирования входят: ANSI/ASCII, UTF-8, UTF-8-BOM, UTF-16-LE и UTF-16-BE.

В отличие от файлов обучающего транскрибирования, скрипт теста должен исключить идентификатор высказываний, который является именем файла каждого высказывания. В противном случае эти идентификаторы будут озвучены.

Ниже приведен пример набора речевых фрагментов в одном файле .txt :

This is the waistline, and it's falling.

We have trouble scoring.

It was Janet Maslin.

Для каждого абзаца речевого фрагмента создается отдельный звуковой файл. Если вы хотите объединить все предложения в один файл, объедините их в один абзац.

Примечание.

Созданные звуковые файлы — это сочетание скриптов автоматического тестирования и пользовательских скриптов тестирования.

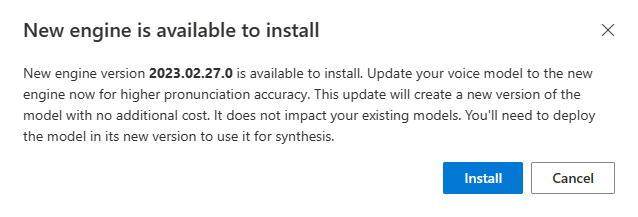

Обновление версии подсистемы для голосовой модели

Текст Azure для подсистем речи обновляется от времени, чтобы записать последнюю языковую модель, которая определяет произношение языка. После обучения голоса вы можете применить голос к новой языковой модели, обновив до последней версии двигателя.

Когда будет доступна новая подсистема, вам будет предложено обновить модель нейронного голоса.

Перейдите на страницу сведений о модели и следуйте инструкциям на экране, чтобы установить последнюю версию подсистемы.

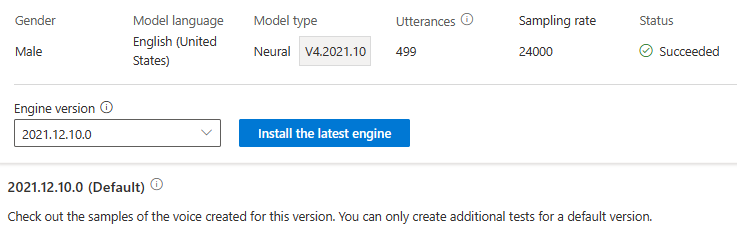

Кроме того, выберите " Установить последнюю версию подсистемы ", чтобы обновить модель до последней версии ядра.

Плата за обновление подсистемы не взимается. Предыдущие версии сохраняются.

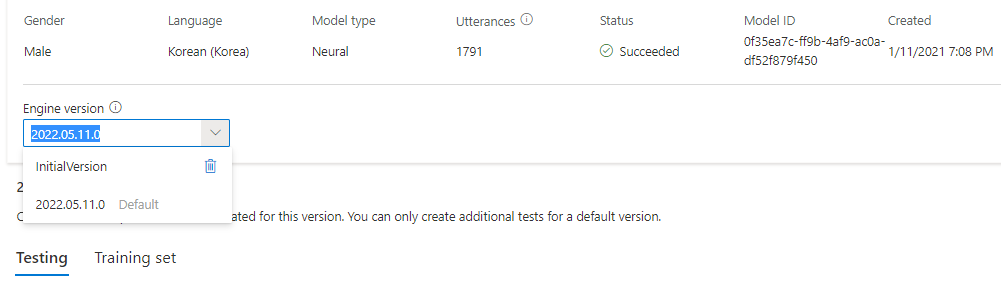

Вы можете проверка все версии подсистемы для модели из списка версий подсистемы или удалить ее, если она больше не нужна.

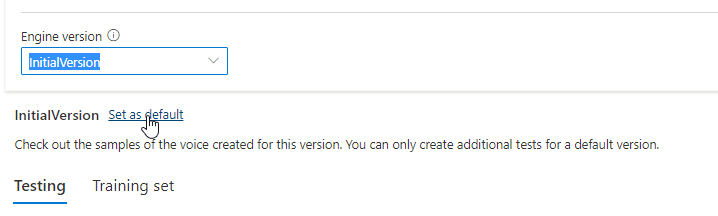

Обновленная версия автоматически устанавливается по умолчанию. Но вы можете изменить версию по умолчанию, выбрав версию из раскрывающегося списка и выбрав "Задать в качестве значения по умолчанию".

Если вы хотите протестировать каждую версию подсистемы голосовой модели, можно выбрать версию из списка, а затем выберите DefaultTests в разделе "Тестирование ", чтобы прослушивать образец звуковых файлов. Если вы хотите отправить собственные тестовые скрипты для дальнейшего тестирования текущей версии подсистемы, сначала убедитесь, что версия задана по умолчанию, а затем выполните действия, описанные в разделе "Тестирование голосовой модели".

Обновление подсистемы создает новую версию модели без дополнительных затрат. После обновления версии подсистемы для голосовой модели необходимо развернуть новую версию, чтобы создать новую конечную точку. Вы можете развернуть только версию по умолчанию.

После создания новой конечной точки необходимо передать трафик в новую конечную точку в продукте.

Дополнительные сведения о возможностях и ограничениях этой функции и рекомендации по улучшению качества модели см. в разделе "Характеристики и ограничения" для использования пользовательского нейронного голоса.

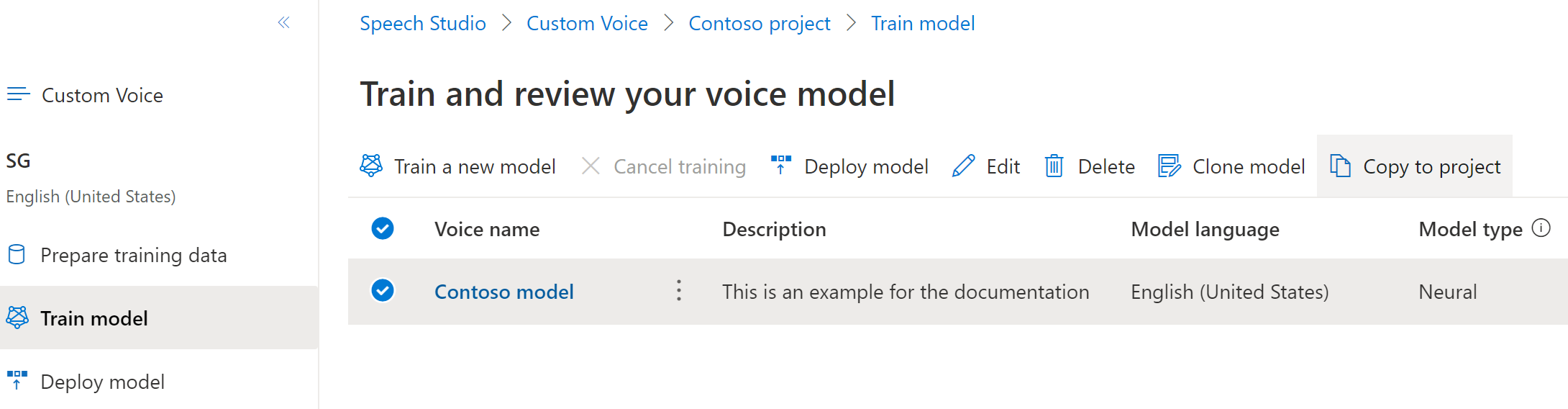

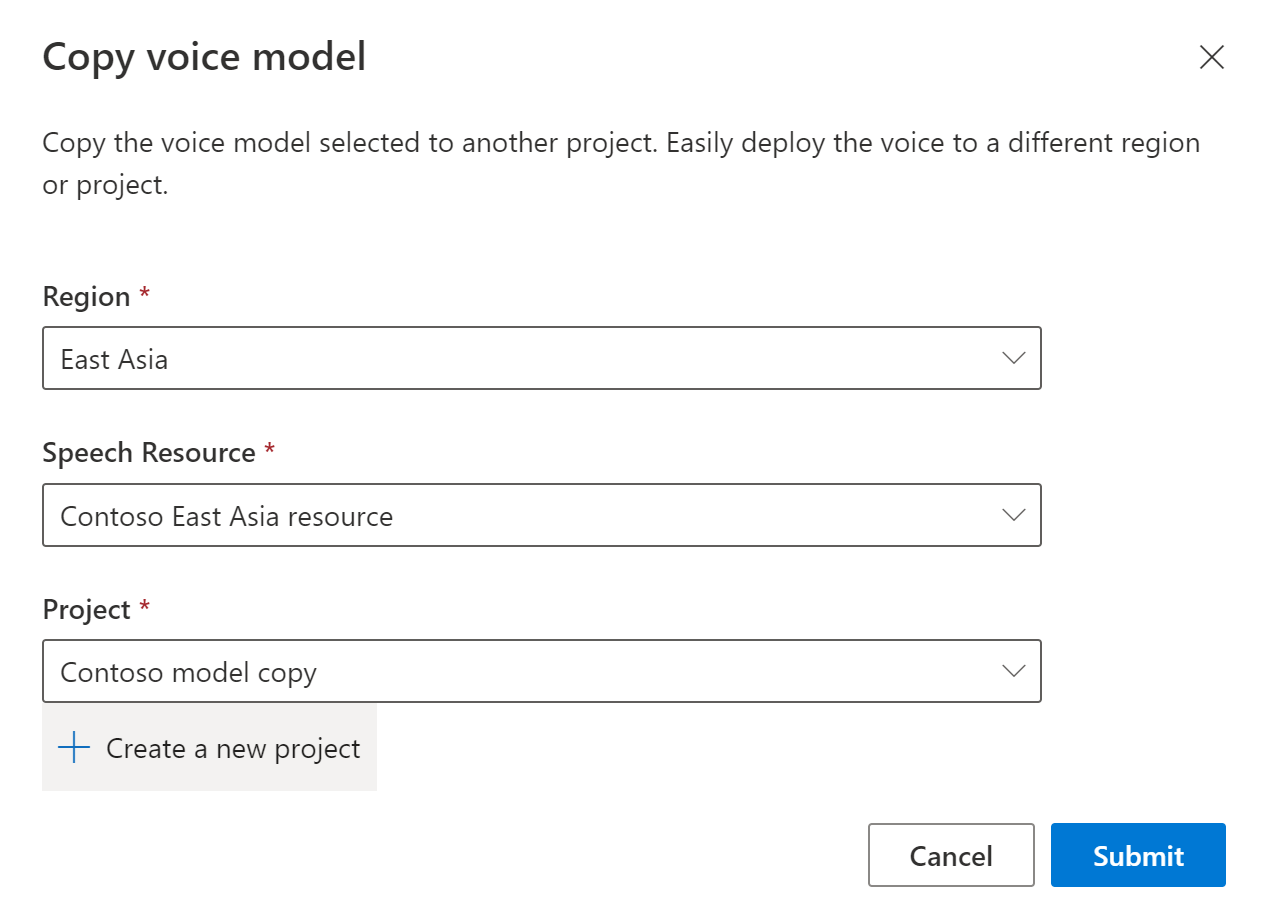

Копирование голосовой модели в другой проект

Вы можете скопировать голосовую модель в другой проект для того же или другого региона. Например, можно скопировать модель нейронной голоса, обученную в одном регионе, в проект для другого региона.

Примечание.

Настраиваемое обучение нейронных голосов в настоящее время доступно только в некоторых регионах. Вы можете скопировать нейронную голосовую модель из этих регионов в другие регионы. Дополнительные сведения см. в разделе Регионы для Пользовательского нейронного голоса.

Чтобы скопировать настраиваемую модель нейронного голоса в другой проект, необходимо выполнить следующие действия:

На вкладке Обучение модели выберите голосовую модель, которую необходимо скопировать, а затем выберите Копировать в проект.

Выберите Регион, Речевой ресурси Проект для модели, которую необходимо скопировать. Если речевой ресурс и проект находятся не в целевом регионе, сначала необходимо их создать.

Нажмите кнопку Отправить, чтобы скопировать модель.

Выберите модель представления в сообщении уведомления об успешном копировании.

Перейдите к проекту, в котором вы скопировали модель для развертывания копии модели.

Следующие шаги

В этой статье вы узнаете, как обучить пользовательский нейронный голос с помощью пользовательского API голосовой связи.

Внимание

Настраиваемое обучение нейронных голосов в настоящее время доступно только в некоторых регионах. После обучения модели голосовой связи в поддерживаемом регионе его можно скопировать в ресурс "Речь" в другом регионе по мере необходимости. Дополнительные сведения см. в сносках в таблице службы "Речь".

Длительность обучения зависит от того, сколько данных вы используете. В среднем для обучения пользовательского нейронного голоса требуется около 40 часов вычислений. Пользователи со стандартной подпиской (S0) могут одновременно обучать четыре голоса. Если этот предел достигнут, подождите, пока хотя бы одна из моделей завершит обучение, а затем повторите попытку.

Примечание.

Хотя общее количество часов, необходимых для каждого метода обучения, зависит от одной и той же цены на единицу. Дополнительные сведения см. в разделе о ценах на настраиваемую нейронную подготовку.

Выбор метода обучения

После проверки файлов данных используйте их для создания пользовательской нейронной голосовой модели. При создании пользовательского нейронного голоса вы можете обучить его одним из следующих методов:

Нейронный: создайте голос на том же языке данных обучения.

Нейронный — кросслингвальный: создайте голос, который говорит на другом языке, отличном от обучающих данных. Например, с

fr-FRпомощью обучающих данных можно создать голос, который говоритen-US.Язык обучающих данных и целевого языка должен быть одним из языков, которые поддерживаются для перекрестного обучения голосовой связи. Вам не нужно подготавливать обучающие данные на целевом языке, но тестовый скрипт должен находиться на целевом языке.

Нейронная — многоуровневая: создание пользовательского нейронного голоса, выступающего в нескольких стилях и эмоциях, без добавления новых обучающих данных. Несколько стилей голоса полезны для игровых персонажей, беседных чат-ботов, аудиокниг, средств чтения содержимого и многое другое.

Чтобы создать несколько стилей голоса, необходимо подготовить набор общих обучающих данных, по крайней мере 300 речевых фрагментов. Выберите один или несколько предустановленных стилей речи целевого объекта. Вы также можете создать несколько пользовательских стилей, предоставив примеры стилей, по крайней мере 100 речевых фрагментов на стиль, в качестве дополнительных обучающих данных для одного голоса. Поддерживаемые стили предустановок зависят от разных языков. Просмотрите доступные стили предустановок на разных языках.

Язык обучающих данных должен быть одним из языков, поддерживаемых для пользовательского нейронного голоса, перекрестного обучения или обучения по нескольким стилям.

Создание голосовой модели

Чтобы создать нейронный голос, используйте операцию Models_Create пользовательского голосового API. Создайте текст запроса в соответствии со следующими инструкциями:

- Задайте обязательное свойство

projectId. См. статью о создании проекта. - Задайте обязательное свойство

consentId. См . добавление согласия на голосовые таланты. - Задайте обязательное свойство

trainingSetId. См. статью о создании обучаемого набора. - Задайте требуемое свойство

Defaultрецептаkindдля обучения нейронного голоса. Тип рецепта указывает метод обучения и не может быть изменен позже. Сведения об использовании другого метода обучения см. в разделе "Нейронная" — перекрестная или нейронная — многоуровневая. Дополнительные сведения о двуязычной подготовке и различиях между языковыми стандартами см . в двуязычной подготовке . - Задайте обязательное свойство

voiceName. Имя голоса должно заканчиваться нейронным и не может быть изменено позже. Тщательно выбирайте имя. Имя голоса используется в запросе синтеза речи в пакете SDK и входных данных SSML. Разрешены только буквы, цифры и несколько знаков препинания. Используйте разные имена для разных нейронных голосовых моделей. - При необходимости задайте

descriptionсвойство для описания голоса. Описание голоса можно изменить позже.

Выполните HTTP-запрос PUT с помощью URI, как показано в следующем Models_Create примере.

- Замените

YourResourceKeyключом ресурса службы речи. - Замените

YourResourceRegionрегион ресурсов службы "Речь". - Замените

JessicaModelIdидентификатором модели по своему усмотрению. Конфиденциальный идентификатор регистра будет использоваться в URI модели и не может быть изменен позже.

curl -v -X PUT -H "Ocp-Apim-Subscription-Key: YourResourceKey" -H "Content-Type: application/json" -d '{

"voiceName": "JessicaNeural",

"description": "Jessica voice",

"recipe": {

"kind": "Default"

},

"projectId": "ProjectId",

"consentId": "JessicaConsentId",

"trainingSetId": "JessicaTrainingSetId"

} ' "https://YourResourceRegion.api.cognitive.microsoft.com/customvoice/models/JessicaModelId?api-version=2023-12-01-preview"

Вы должны получить ответ в следующем формате:

{

"id": "JessicaModelId",

"voiceName": "JessicaNeural",

"description": "Jessica voice",

"recipe": {

"kind": "Default",

"version": "V7.2023.03"

},

"projectId": "ProjectId",

"consentId": "JessicaConsentId",

"trainingSetId": "JessicaTrainingSetId",

"locale": "en-US",

"engineVersion": "2023.07.04.0",

"status": "NotStarted",

"createdDateTime": "2023-04-01T05:30:00.000Z",

"lastActionDateTime": "2023-04-02T10:15:30.000Z"

}

Двуязычное обучение

Если выбрать тип обучения нейронных данных , вы можете обучить голос для выступления на нескольких языках. И местные zh-CN жители оба поддерживают двуязычное обучение для голоса, чтобы говорить как на китайском, так и zh-TW на английском языках. В зависимости от ваших обучающих данных синтезированный голос может говорить на английском языке с английским собственным акцентом или английским с тем же акцентом, что и данные обучения.

Примечание.

Чтобы включить голос в zh-CN языковом стандарте, чтобы говорить на английском языке с тем же акцентом, что и пример данных, следует выбрать Chinese (Mandarin, Simplified), English bilingual при создании проекта или указать zh-CN (English bilingual) языковой стандарт для данных набора обучения с помощью REST API.

В следующей таблице показаны различия между двумя языковыми стандартами:

| Языковой стандарт Speech Studio | Языковой стандарт REST API | Двуязычная поддержка |

|---|---|---|

Chinese (Mandarin, Simplified) |

zh-CN |

Если образец данных содержит английский, синтезированный голос говорит на английском языке с английским собственным акцентом вместо того же акцента, что и выборка данных, независимо от объема данных английского языка. |

Chinese (Mandarin, Simplified), English bilingual |

zh-CN (English bilingual) |

Если вы хотите, чтобы синтезированный голос говорил на английском языке с тем же акцентом, что и выборка данных, рекомендуется включить более 10 % данных английского языка в обучающий набор. В противном случае акцент на английском языке может быть не идеальным. |

Chinese (Taiwanese Mandarin, Traditional) |

zh-TW |

Если вы хотите обучить синтезированный голос, способный говорить на английском языке с тем же акцентом, что и образец данных, обязательно предоставьте более 10 % английских данных в учебном наборе. В противном случае он по умолчанию используется для английского собственного акцента. Пороговое значение 10 % вычисляется на основе данных, принятых после успешной отправки, а не данных перед отправкой. Если некоторые отправленные данные английского языка отклоняются из-за дефектов и не соответствуют пороговой значению 10 %, синтезированный голос по умолчанию используется для английского собственного акцента. |

Доступные стили предустановок на разных языках

В следующей таблице перечислены различные предустановленные стили в соответствии с различными языками.

| Стиль речи | Язык (языковой стандарт) |

|---|---|

| Сердиться | Английский (США) (en-US)Японский (Япония) ( ja-JP1) Китайский (Мандарин, упрощенное письмо) ( zh-CN) 1 |

| Спокойствие | Китайский (Мандарин, упрощенное письмо) (zh-CN) 1 |

| чат | Китайский (Мандарин, упрощенное письмо) (zh-CN) 1 |

| Веселый | Английский (США) (en-US)Японский (Япония) ( ja-JP1) Китайский (Мандарин, упрощенное письмо) ( zh-CN) 1 |

| Недовольных | Китайский (Мандарин, упрощенное письмо) (zh-CN) 1 |

| Взволнован | Английский (США) (en-US) |

| Страшно | Китайский (Мандарин, упрощенное письмо) (zh-CN) 1 |

| учетной | Английский (США) (en-US) |

| Надежды | Английский (США) (en-US) |

| Грустно | Английский (США) (en-US)Японский (Япония) ( ja-JP1) Китайский (Мандарин, упрощенное письмо) ( zh-CN) 1 |

| Кричать | Английский (США) (en-US) |

| Серьезные | Китайский (Мандарин, упрощенное письмо) (zh-CN) 1 |

| Ужасе | Английский (США) (en-US) |

| недружественный | Английский (США) (en-US) |

| Шепот | Английский (США) (en-US) |

1 Стиль нейронного голоса доступен в общедоступной предварительной версии. Стили в общедоступной предварительной версии доступны только в этих регионах службы: восточная часть США, Западная Европа и Юго-Восточная Азия.

Получение состояния обучения

Чтобы получить состояние обучения голосовой модели, используйте Models_Get операцию пользовательского API голосовой связи. Создайте URI запроса в соответствии со следующими инструкциями:

Выполните HTTP-запрос GET с помощью URI, как показано в следующем Models_Get примере.

- Замените

YourResourceKeyключом ресурса службы речи. - Замените

YourResourceRegionрегион ресурсов службы "Речь". - Замените

JessicaModelId, если вы указали другой идентификатор модели на предыдущем шаге.

curl -v -X GET "https://YourResourceRegion.api.cognitive.microsoft.com/customvoice/models/JessicaModelId?api-version=2023-12-01-preview" -H "Ocp-Apim-Subscription-Key: YourResourceKey"

Текст ответа должен быть получен в следующем формате.

Примечание.

Рецепт kind и другие свойства зависят от того, как вы обучили голос. В этом примере тип рецепта предназначен Default для обучения нейронного голоса.

{

"id": "JessicaModelId",

"voiceName": "JessicaNeural",

"description": "Jessica voice",

"recipe": {

"kind": "Default",

"version": "V7.2023.03"

},

"projectId": "ProjectId",

"consentId": "JessicaConsentId",

"trainingSetId": "JessicaTrainingSetId",

"locale": "en-US",

"engineVersion": "2023.07.04.0",

"status": "Succeeded",

"createdDateTime": "2023-04-01T05:30:00.000Z",

"lastActionDateTime": "2023-04-02T10:15:30.000Z"

}

Может потребоваться ждать несколько минут до завершения обучения. В конечном итоге состояние изменится на либо SucceededFailed.