Azure Data Factory İş Akışı Düzenleme Yöneticisi nasıl çalışır?

UYGULANANLAR: Azure Data Factory

Azure Data Factory  Azure Synapse Analytics

Azure Synapse Analytics

İpucu

Kuruluşlar için hepsi bir arada analiz çözümü olan Microsoft Fabric'te Data Factory'yi deneyin. Microsoft Fabric , veri taşımadan veri bilimine, gerçek zamanlı analize, iş zekasına ve raporlamaya kadar her şeyi kapsar. Yeni bir deneme sürümünü ücretsiz olarak başlatmayı öğrenin!

Not

Workflow Orchestration Manager, Apache Airflow tarafından desteklenir.

Not

Azure Data Factory için workflow orchestration manager, apache airflow uygulamasını açık kaynak kullanır. Airflow belgeleri ve diğer öğreticiler Apache Airflow Belgeleri veya Topluluk sayfalarında bulunabilir.

Azure Data Factory'deki Workflow Orchestration Manager, düzenleme iş akışlarınızı çalıştırmak için Python tabanlı Directed Acyclic Graphs (DAG) kullanır. Bu özelliği kullanmak için Azure Blob Depolama'de DAG'lerinizi ve eklentilerinizi sağlamanız gerekir. DAG'lerinizi yönetmek için bir komut satırı arabirimi (CLI) veya yazılım geliştirme seti (SDK) kullanarak ADF'den Airflow kullanıcı arabirimini başlatabilirsiniz.

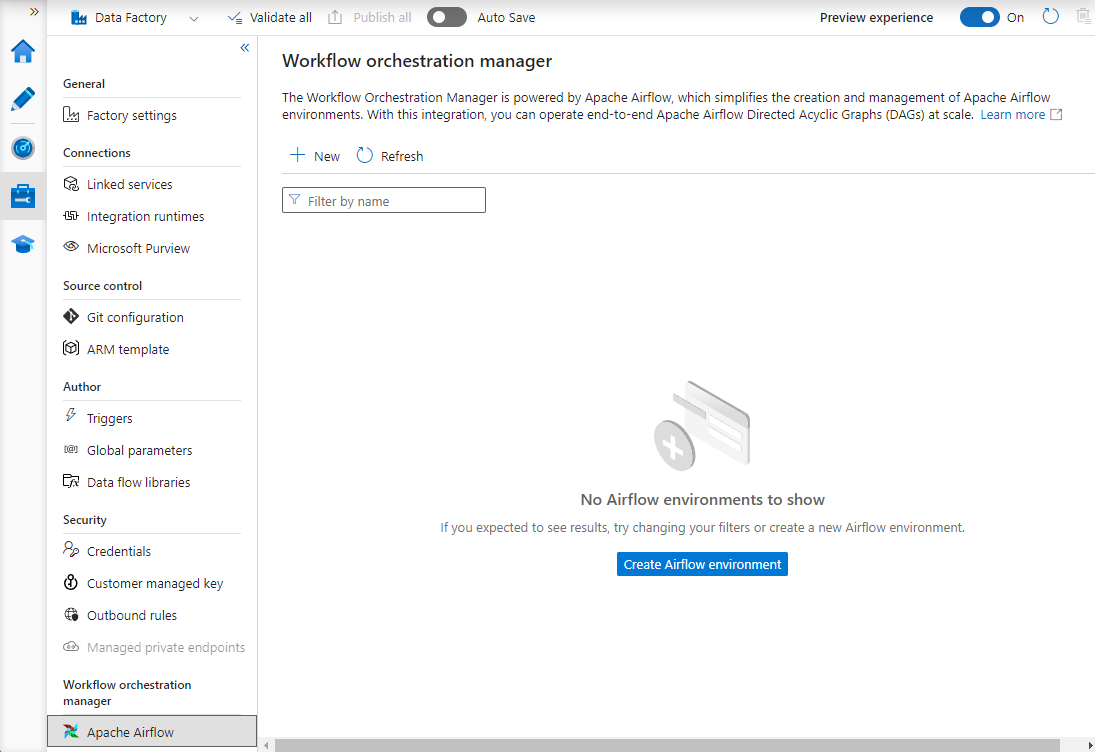

İş Akışı Düzenleme Yöneticisi ortamı oluşturma

Aşağıdaki adımlar workflow orchestration manager ortamınızı ayarlama ve yapılandırma.

Önkoşullar

Azure aboneliği: Azure aboneliğiniz yoksa başlamadan önce ücretsiz bir hesap oluşturun. İş Akışı Düzenleme Yöneticisi önizlemesinin desteklendiği bölgede mevcut bir Data Factory oluşturun veya seçin.

Ortam oluşturma adımları

Yeni İş Akışı Düzenleme Yöneticisi ortamı oluşturun. Yeni bir Airflow ortamı oluşturmak için Hub'ı yönet ->Airflow (Önizleme) ->+Yeni'ye gidin

Ayrıntıları sağlayın (Airflow yapılandırması)

Önemli

Temel kimlik doğrulamasını kullanırken, bu ekranda belirtilen kullanıcı adını ve parolayı unutmayın. Daha sonra workflow orchestration manager kullanıcı arabiriminde oturum açmak için gerekli olacaktır. Varsayılan seçenek Microsoft Entra ID'dir ve Airflow ortamınız için kullanıcı adı/ parola oluşturulmasını gerektirmez, bunun yerine OTURUM açmak/DAG'leri izlemek için oturum açmış kullanıcının Azure Data Factory kimlik bilgilerini kullanır.

Ortam, rastgele içerik veya ayarları depolamak ve almak için Airflow'da basit bir anahtar değeri depolar.

Gereksinimler Python kitaplıklarını önceden yüklemek için kullanılabilir. Bunları daha sonra da güncelleştirebilirsiniz.

DAG'leri içeri aktarma

Aşağıdaki adımlarda DAG'lerin Workflow Orchestration Manager'a nasıl aktarıldığı açıklanmaktadır.

Önkoşullar

Erişilebilir bir Depolama hesabına örnek bir DAG yüklemeniz gerekir (Dags klasörünün altında olmalıdır).

Not

Sanal ağın arkasındaki blob Depolama önizleme sırasında desteklenmez.

StorageLinkedServices içindeki KeyVault yapılandırması, dag'ları içeri aktarmak için desteklenmez.

Örnek Apache Airflow v2.x DAG. Örnek Apache Airflow v1.10 DAG.

İçeri aktarma adımları

İçeriği kopyalayıp tutorial.py olarak adlandırılan yeni bir dosyaya yapıştırın (v2.x veya v1.10, ayarlamış olduğunuz Airflow ortamına göre).

tutorial.py bir blob depolama alanına yükleyin. (Bloba dosya yükleme)

Not

Bunları Airflow ortamına aktarmak için dags ve plugins adlı klasörleri içeren bir blob depolama hesabından dizin yolu seçmeniz gerekir. Eklentiler zorunlu değildir. Ayrıca dags adlı bir kapsayıcınız olabilir ve içindeki tüm Airflow dosyalarını karşıya yükleyebilirsiniz.

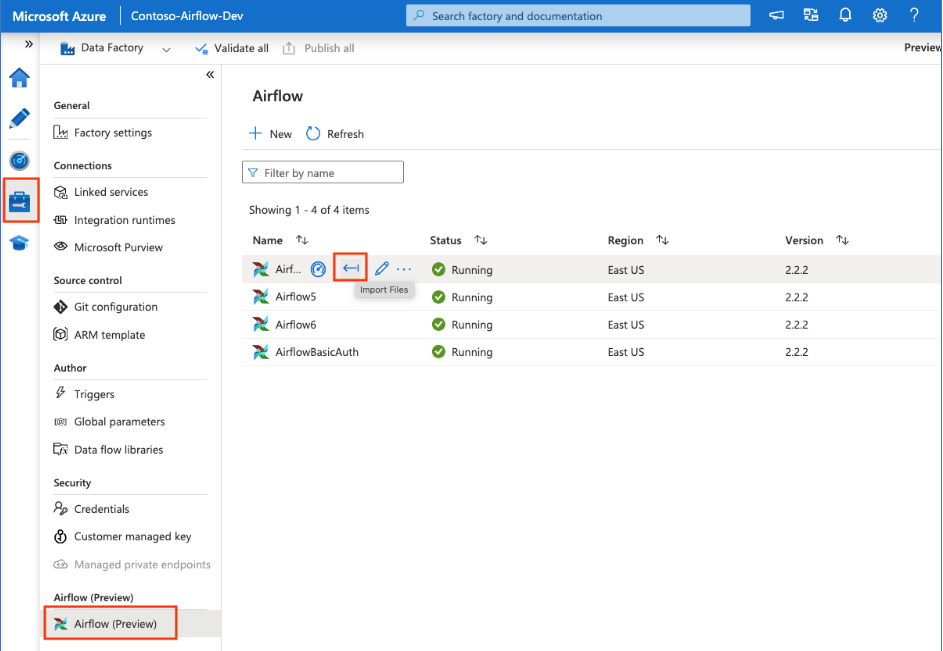

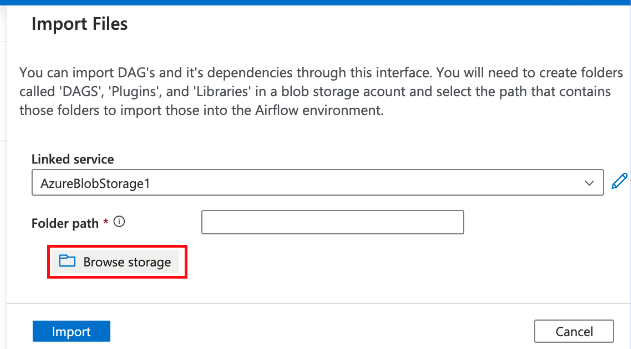

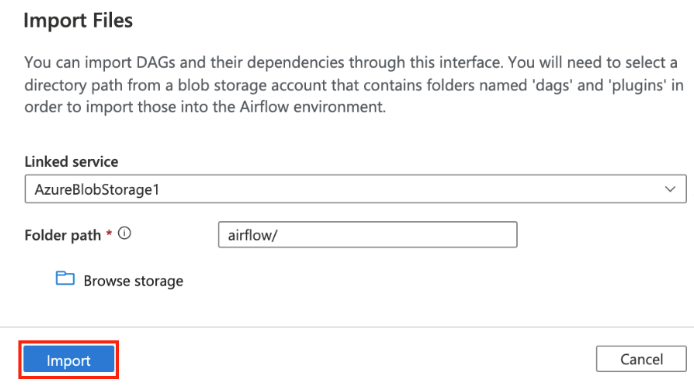

Merkezi yönet'in altında Airflow (Önizleme) seçeneğini belirleyin. Ardından, daha önce oluşturulan Airflow ortamının üzerine gelin ve Dosyaları içeri aktar'ı seçerek Tüm DAG'leri ve bağımlılıkları Airflow Ortamına aktarın.

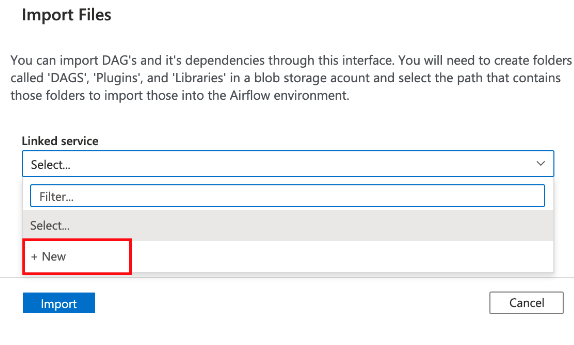

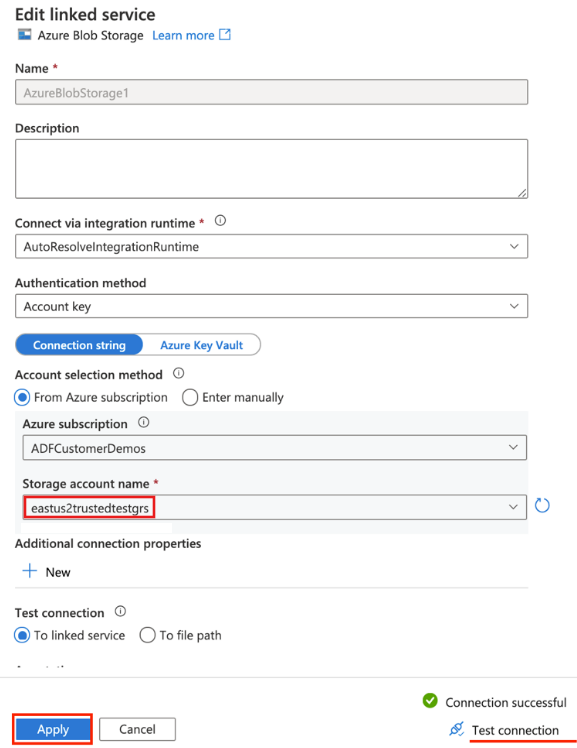

Önkoşulda belirtilen erişilebilir depolama hesabına yeni bir Bağlı Hizmet oluşturun (veya zaten kendi DAG'leriniz varsa mevcut bir bağlı hizmeti kullanın).

DAG'yi yüklediğiniz depolama hesabını kullanın (önkoşulu denetleyin). Bağlantıyı test edin ve oluştur'u seçin.

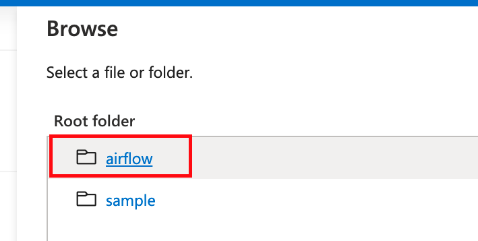

Örnek SAS URL'sini kullanıyorsanız hava akışına göz atın ve hava akışını seçin veya DAG dosyaları içeren dags klasörünü içeren klasörü seçin.

Not

DAG'leri ve bağımlılıklarını bu arabirim aracılığıyla içeri aktarabilirsiniz. Bunları Airflow ortamına aktarmak için dags ve plugins adlı klasörleri içeren bir blob depolama hesabından dizin yolu seçmeniz gerekir. Eklentiler zorunlu değildir.

Not

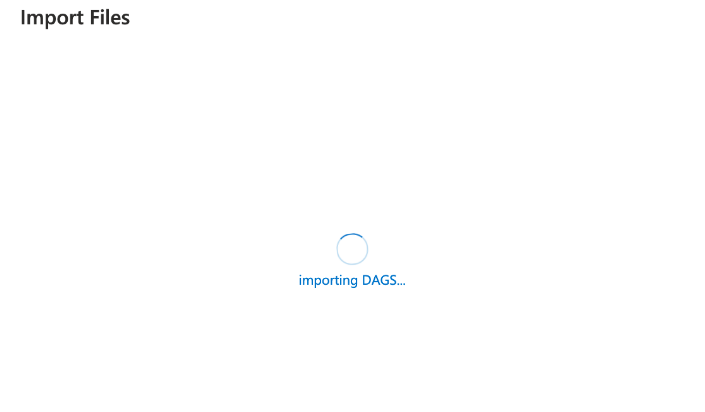

DAG'lerin içeri aktarılması Önizleme sırasında birkaç dakika sürebilir. İçeri aktarma durumu güncelleştirmelerini izlemek için bildirim merkezi (ADF kullanıcı arabirimindeki zil simgesi) kullanılabilir.

İçeri aktarma DAG sorunlarını giderme

Sorun: DAG içeri aktarma işlemi 5 dakikadan fazla sürüyor Risk Azaltma: tek bir içeri aktarma ile içeri aktarılan DAG'lerin boyutunu küçültün. Bunu başarma yollarından biri, birden çok kapsayıcıda daha az DAG içeren birden çok DAG klasörü oluşturmaktır.

Sorun: Airflow kullanıcı arabiriminde oturum açtığınızda içeri aktarılan DAG'ler gösterilmiyor. Azaltma: Airflow kullanıcı arabiriminde oturum açın ve DAG ayrıştırma hataları olup olmadığına bakın. DAG dosyaları uyumsuz kod içeriyorsa bu durum oluşabilir. Sorunu airflow kullanıcı arabirimi aracılığıyla içeren tam satır numaralarını ve dosyaları bulabilirsiniz.

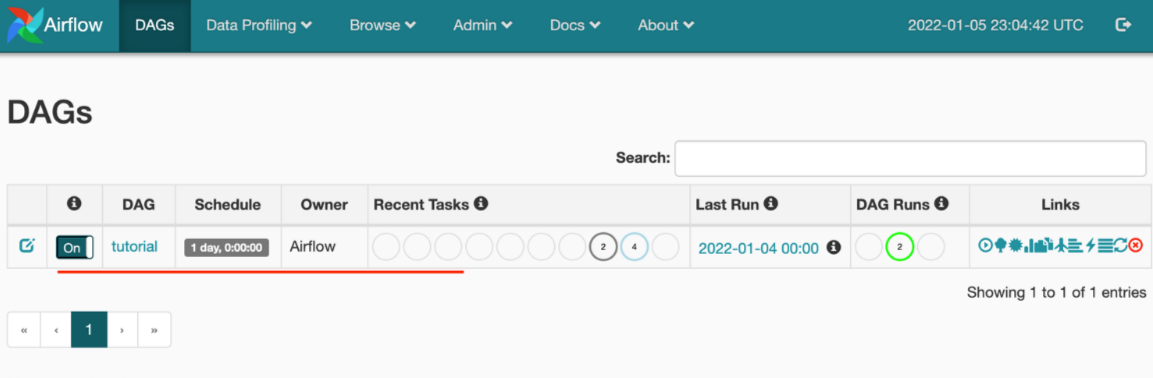

DAG çalıştırmalarını izleme

Airflow DAG'lerini izlemek için airflow kullanıcı arabiriminde daha önce oluşturulan kullanıcı adı ve parolayla oturum açın.

Oluşturulan Airflow ortamında öğesini seçin.

Airflow Integration Runtime oluşturma sırasında sağlanan kullanıcı adı-parolayı kullanarak oturum açın. (Gerekirse Airflow Integration çalışma zamanını düzenleyerek kullanıcı adını veya parolayı sıfırlayabilirsiniz)

HAVA AKıŞı ortamından DAG'leri kaldırma

Airflow sürüm 1.x kullanıyorsanız, herhangi bir Airflow ortamına (IR) dağıtılan DAG'leri silin, DAG'leri iki farklı yerde silmeniz gerekir.

- Airflow kullanıcı arabiriminden DAG'yi silme

- ADF kullanıcı arabiriminde DAG'yi silme

Not

Bu, Genel Önizleme sırasındaki geçerli deneyimdir ve bu deneyimi geliştireceğiz.