Creare un assistente vocale senza codice in Azure Percept Studio

Importante

Ritiro di Azure Percept DK:

Aggiornamento 22 febbraio 2023: è ora disponibile un aggiornamento del firmware per i componenti accessori Percept DK Vision e Audio (noto anche come Visione e Audio SOM) e consentirà ai componenti accessori di continuare a funzionare oltre la data di ritiro.

L'anteprima pubblica di Azure Percept si evolverà per supportare nuove piattaforme perimetrali per dispositivi e esperienze per sviluppatori. Nell'ambito di questa evoluzione, Azure Percept DK e Audio Accessorio e i servizi di supporto associati ai servizi di Azure per percept DK verranno ritirati il 30 marzo 2023.

A partire dal 30 marzo 2023, Azure Percept DK e Audio Accessorio non saranno più supportati da tutti i servizi di Azure, tra cui Azure Percept Studio, aggiornamenti del sistema operativo, aggiornamenti dei contenitori, visualizzazione flusso Web e integrazione Visione personalizzata. Microsoft non fornirà più supporto tecnico ai clienti e qualsiasi servizio di supporto associato. Per altre informazioni, visitare il post di blog sull'avviso di ritiro.

In questa esercitazione si creerà una voce assistente da un modello da usare con Azure Percept DK e Azure Percept Audio. La demo voce assistente viene eseguita all'interno di Azure Percept Studio e contiene una selezione di oggetti virtuali controllati dalla voce. Per controllare un oggetto, dire la parola chiave, ovvero una parola o una frase breve che riattiva il dispositivo, seguita da un comando. Ogni modello risponde a un set di comandi specifici.

Questa guida illustra il processo di configurazione dei dispositivi, la creazione di una voce assistente e le risorse necessarie di Servizi vocali, il test della voce assistente, la configurazione della parola chiave e la creazione di parole chiave personalizzate.

Prerequisiti

- Azure Percept DK (devkit)

- Azure Percept Audio

- Altoparlante o cuffie che possono connettersi a jack audio 3.5mm (facoltativo)

- Sottoscrizione di Azure

- Esperienza di configurazione di Azure Percept DK: è stato connesso il devkit a una rete Wi-Fi, è stata creata una hub IoT e è stato connesso il devkit all'hub IoT

- Configurazione di Azure Percept Audio

Creare una voce assistente usando un modello disponibile

Passare a Azure Percept Studio.

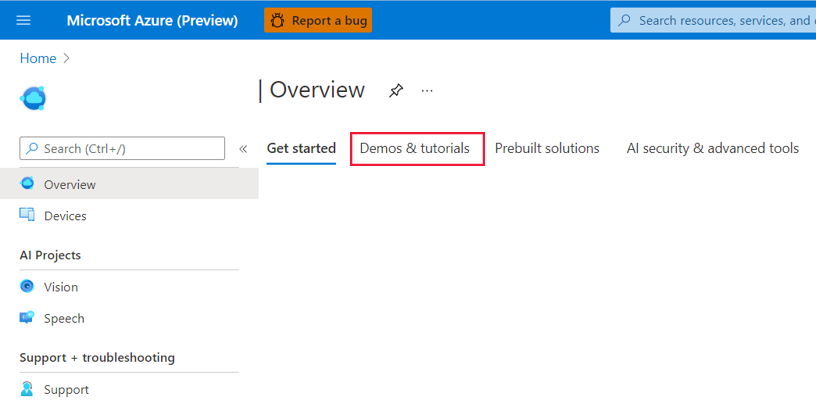

Aprire la scheda Demos & esercitazioni .

Fare clic su Prova voce assistente modelli in Esercitazioni vocali e demo. Verrà aperta una finestra sul lato destro dello schermo.

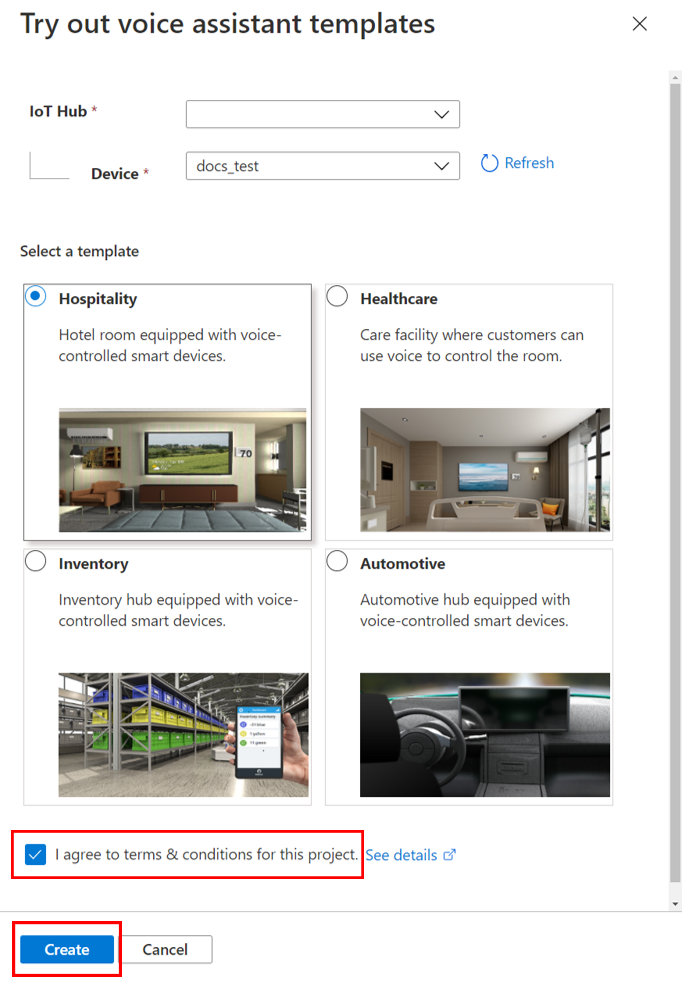

Eseguire le operazioni seguenti nella finestra:

Nel menu a discesa hub IoT selezionare l'hub IoT a cui è connesso il devkit.

Nel menu a discesa Dispositivo selezionare il devkit.

Selezionare uno dei modelli di assistente voce disponibili.

Fare clic sulla casella di controllo I accettare i termini & condizioni per questo progetto .

Fare clic su Crea.

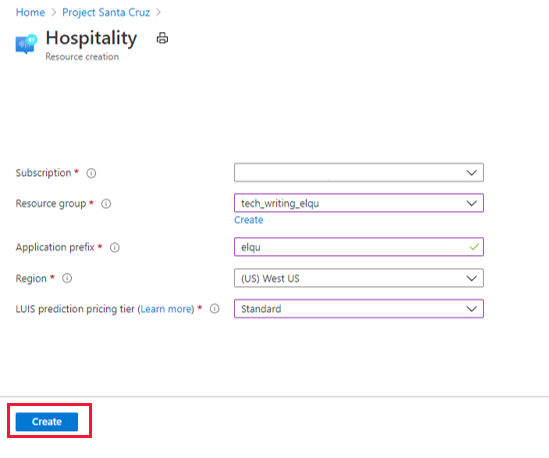

Dopo aver fatto clic su Crea, il portale apre un'altra finestra per creare la risorsa tema voce. Eseguire le operazioni seguenti nella finestra:

Selezionare la sottoscrizione di Azure nella casella Sottoscrizione .

Selezionare il gruppo di risorse preferito dal menu a discesa Gruppo di risorse. Se si vuole creare un nuovo gruppo di risorse da usare con la voce assistente, fare clic su Crea nel menu a discesa e seguire le istruzioni.

Per Prefisso applicazione immettere un nome. Questo sarà il prefisso per il progetto e il nome del comando personalizzato.

In Area selezionare l'area in cui distribuire le risorse.

In Piano tariffario di stima LUIS selezionare Standard (il piano gratuito non supporta le richieste vocali).

Fare clic sul pulsante Crea. Le risorse per l'applicazione voce assistente verranno distribuite nella sottoscrizione.

Avviso

Non chiudere la finestra fino a quando il portale non ha completato la distribuzione della risorsa. La chiusura prematura della finestra può comportare un comportamento imprevisto della voce assistente. Una volta distribuita la risorsa, verrà visualizzata la demo.

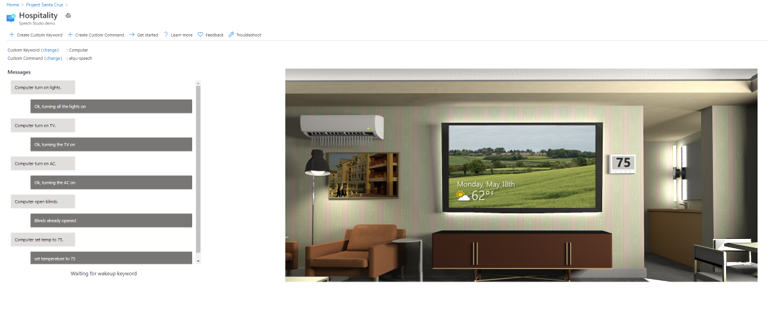

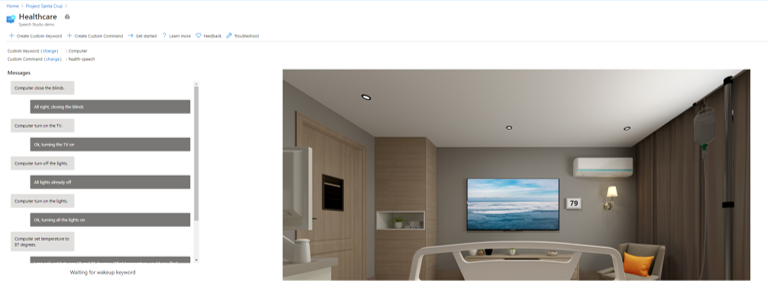

Testare la voce assistente

Per interagire con la voce assistente, dire la parola chiave seguita da un comando. Quando l'orecchio SoM riconosce la parola chiave, il dispositivo genera un chime (che è possibile sentire se un altoparlante o cuffie sono connessi) e i LED lampeggiano blu. I LED passano a blu da corsa mentre il comando viene elaborato. La risposta della voce assistente al comando verrà stampata nel testo nella finestra demo e generata audibly tramite altoparlante/cuffie. La parola chiave predefinita (elencata accanto a Parola chiave personalizzata) è impostata su "Computer" e ogni modello ha un set di comandi compatibili che consentono di interagire con oggetti virtuali nella finestra demo. Ad esempio, se si usa la demo dell'ospitalità o dell'assistenza sanitaria, si supponga che "Computer, attivare la TV" per attivare la TV virtuale.

Comandi demo per l'ospitalità e l'assistenza sanitaria

Sia le demo sanitarie che di ospitalità hanno televisori virtuali, luci, blind e termostati che è possibile interagire con. Sono supportati i comandi seguenti (e varianti aggiuntive):

- "Attiva/disattiva le luci".

- "Attiva/disattiva la TV".

- "Attivare/disattivare l'ac".

- "Aprire/chiudere i blind".

- "Impostare la temperatura su X gradi". (X è la temperatura desiderata, ad esempio 75.)

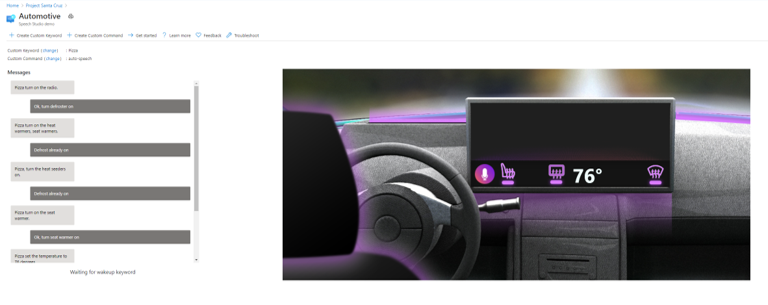

Comandi demo automobilistici

La demo automobilistica ha un sedile più caldo, sbrinatore e termostato che è possibile interagire con. Sono supportati i comandi seguenti (e varianti aggiuntive):

- "Attivare/disattivare il defroster".

- "Attiva/disattiva il sedile più caldo".

- "Impostare la temperatura su X gradi". (X è la temperatura desiderata, ad esempio 75.)

- "Aumentare/ridurre la temperatura per gradi Y".

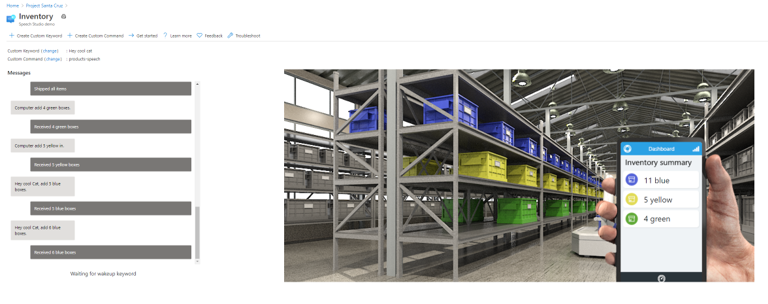

Comandi demo di inventario

La demo di inventario include una selezione di caselle virtuali blu, giallo e verde per interagire con un'app di inventario virtuale. Sono supportati i comandi seguenti (e varianti aggiuntive):

- "Aggiungi/rimuovi caselle X". (X è il numero di caselle, ad esempio 4.)

- "Order/ship X box".

- "Quante caselle sono in magazzino?"

- "Conteggio caselle Y". (Y è il colore delle caselle, ad esempio giallo.

- "Spedisci tutto in magazzino".

Configurare la parola chiave

È possibile personalizzare la parola chiave per l'applicazione assistente voce.

Fare clic su Modifica accanto a Parola chiave personalizzata nella finestra demo.

Selezionare una delle parole chiave disponibili. Sarà possibile scegliere tra una selezione di parole chiave di esempio e qualsiasi parola chiave personalizzata creata.

Fare clic su Save (Salva).

Creare una parola chiave personalizzata

È possibile creare una parola chiave personalizzata per l'applicazione vocale. Il training per la parola chiave personalizzata può essere completato in pochi minuti.

Fare clic su + Crea parola chiave personalizzata nella parte superiore della finestra demo.

Immettere la parola chiave desiderata, che può essere una singola parola o una frase breve.

Selezionare la risorsa Voce (questa opzione è elencata accanto al comando personalizzato nella finestra demo e contiene il prefisso dell'applicazione).

Fare clic su Save (Salva).

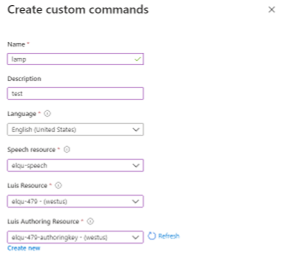

Creare un comando personalizzato

Il portale fornisce anche funzionalità per la creazione di comandi personalizzati con risorse vocali esistenti. "Comando personalizzato" fa riferimento alla voce assistente'applicazione stessa, non a un comando specifico all'interno dell'applicazione esistente. Creando un comando personalizzato, si sta creando un nuovo progetto di riconoscimento vocale, che è necessario sviluppare ulteriormente in Speech Studio.

Per creare un nuovo comando personalizzato dall'interno della finestra demo, fare clic su + Crea comando personalizzato nella parte superiore della pagina ed eseguire le operazioni seguenti:

Immettere un nome per il comando personalizzato.

Immettere una descrizione del progetto (facoltativo).

Selezionare la lingua preferita.

Selezionare la risorsa voce.

Selezionare la risorsa LUIS.

Selezionare la risorsa di creazione LUIS o crearne una nuova.

Fare clic su Crea.

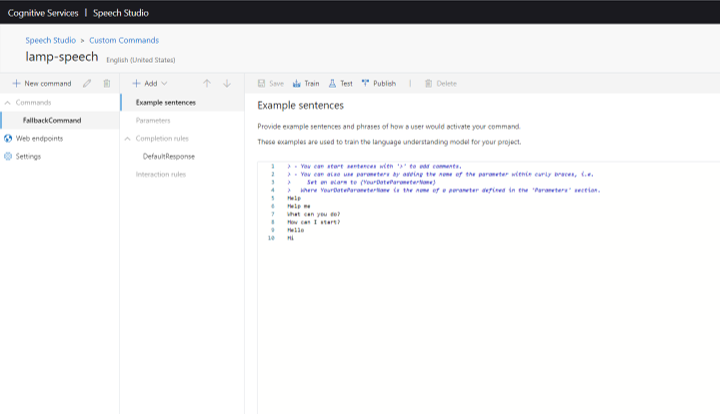

Dopo aver creato un comando personalizzato, è necessario passare a Speech Studio per un ulteriore sviluppo. Se si apre Speech Studio e non viene visualizzato il comando personalizzato elencato, seguire questa procedura:

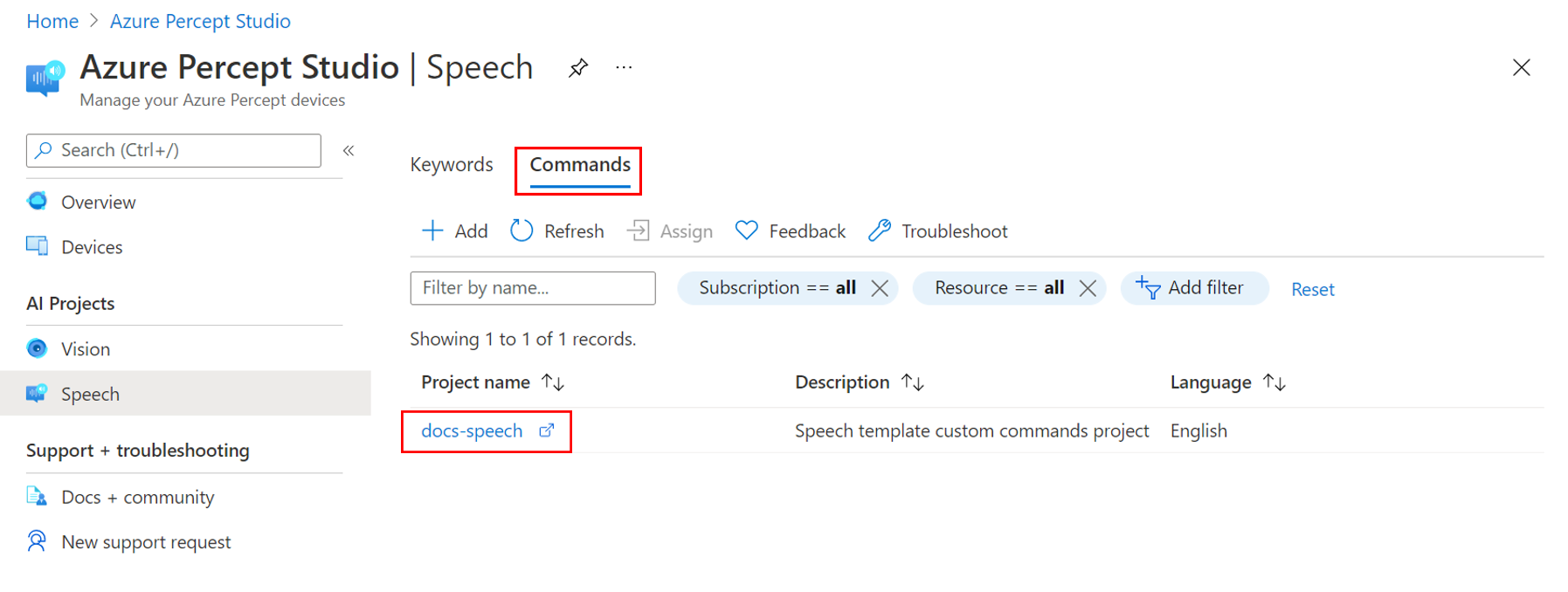

Nel pannello del menu a sinistra in Azure Percept Studio fare clic su Voce in Progetti di intelligenza artificiale.

Selezionare la scheda Comandi .

Selezionare il comando personalizzato che si vuole sviluppare. Verrà aperto il progetto in Speech Studio.

Per altre informazioni sullo sviluppo di comandi personalizzati, vedere la documentazione del servizio Voce.

Risoluzione dei problemi

La assistente vocale è stata creata ma non risponde ai comandi

Controllare le luci a LED sulla scheda Interposer:

- Tre luci blu tinta unita indicano che la voce assistente è pronta e in attesa della parola chiave.

- Se il LED centrale (L02) è bianco, il devkit ha completato l'inizializzazione e deve essere configurato con una parola chiave.

- Se il LED centrale (L02) lampeggia in bianco, il SoM audio non ha ancora completato l'inizializzazione. Il completamento dell'inizializzazione può richiedere alcuni minuti.

Per altre informazioni sugli indicatori LED, vedere l'articolo LED.

Voice assistente non risponde a una parola chiave personalizzata creata in Speech Studio

Questo problema può verificarsi se il modulo di riconoscimento vocale non è aggiornato. Seguire questa procedura per aggiornare il modulo voce alla versione più recente:

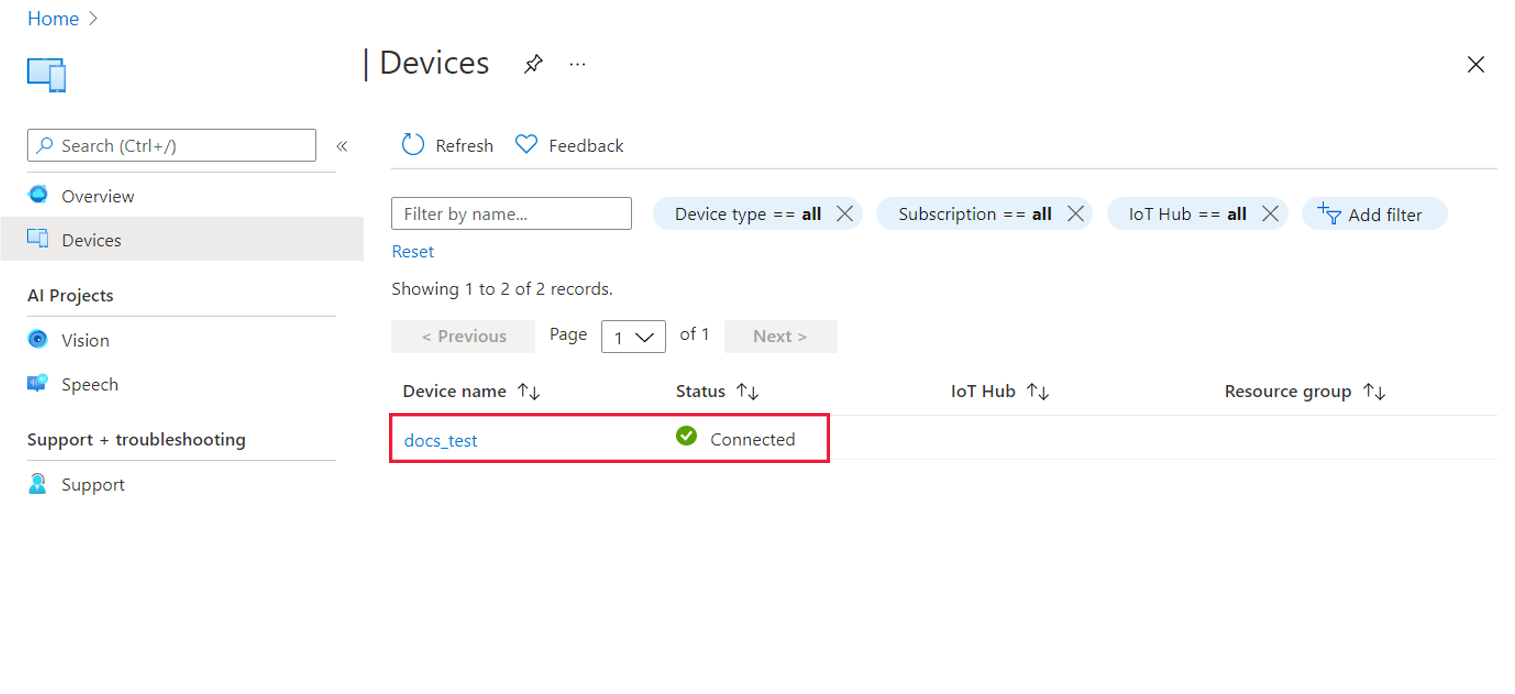

Fare clic su Dispositivi nel pannello del menu a sinistra della home page Azure Percept Studio.

Trovare e selezionare il dispositivo.

Nella finestra del dispositivo selezionare la scheda Voce .

Controllare la versione del modulo voce. Se è disponibile un aggiornamento, accanto al numero di versione verrà visualizzato un pulsante Aggiorna .

Fare clic su Aggiorna per distribuire l'aggiornamento del modulo voce. Il completamento del processo di aggiornamento richiede in genere 2-3 minuti.

Pulire le risorse

Al termine dell'uso dell'applicazione voice assistente, seguire questa procedura per pulire le risorse vocali distribuite durante questa esercitazione:

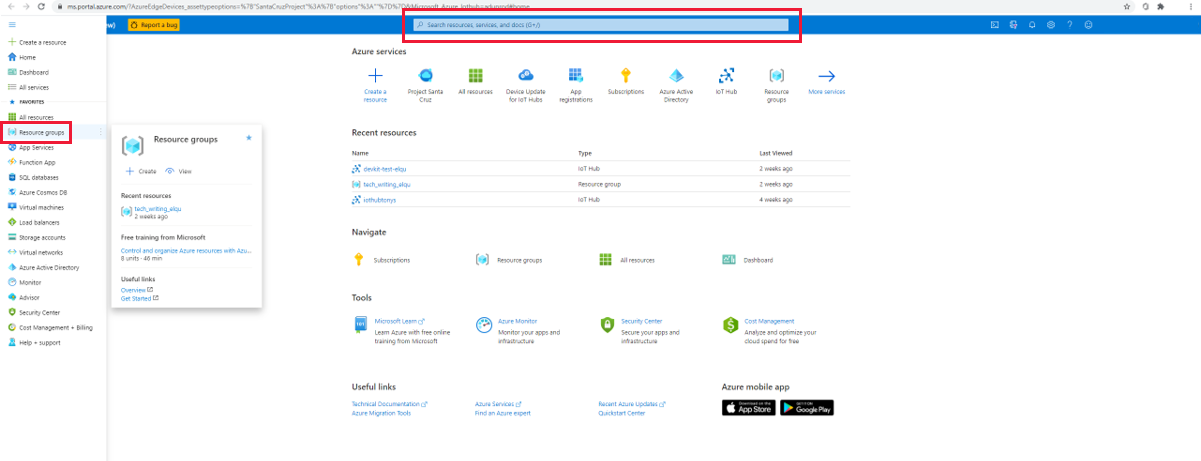

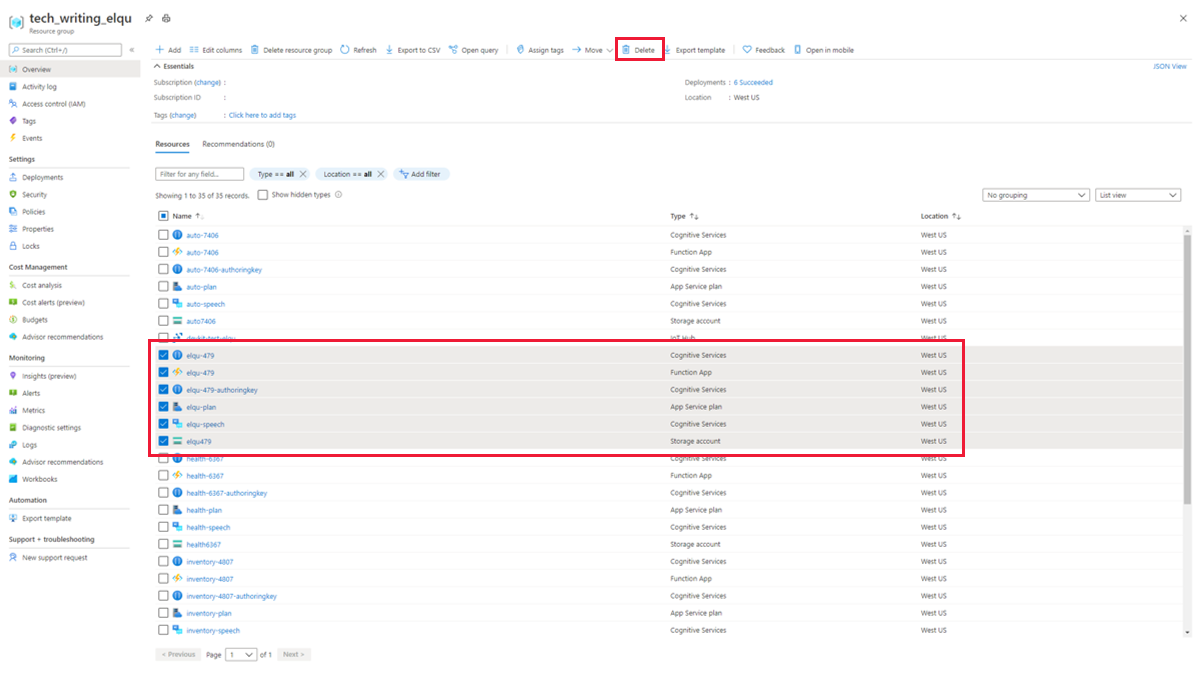

Nella portale di Azure selezionare Gruppi di risorse nel pannello del menu a sinistra o digitarlo nella barra di ricerca.

Selezionare il gruppo di risorse.

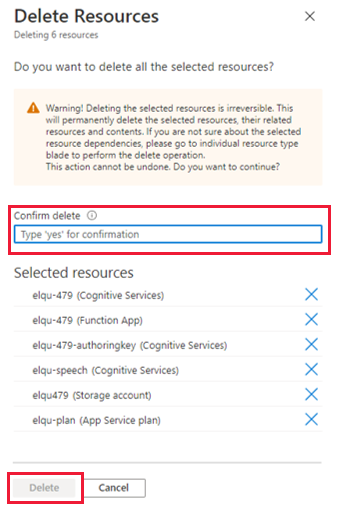

Selezionare tutte e sei le risorse che contengono il prefisso dell'applicazione e fare clic sull'icona Elimina nel pannello del menu in alto.

Per confermare l'eliminazione, digitare sì nella casella di conferma, verificare di aver selezionato le risorse corrette e fare clic su Elimina.

Avviso

Verranno rimosse tutte le parole chiave personalizzate create con le risorse vocali eliminate e la voce assistente demo non funzionerà più.

Passaggi successivi

Dopo aver creato una soluzione di riconoscimento vocale senza codice, provare a creare una soluzione di visione senza codice per Azure Percept DK.