Öğretici: Azure Cosmos DB uç noktasıyla Azure Databricks uygulama

Bu öğreticide Azure Cosmos DB için hizmet uç noktası etkinleştirilmiş bir sanal ağ eklenmiş Databricks ortamının nasıl uygulandığı açıklanmaktadır.

Bu öğreticide şunların nasıl yapılacağını öğreneceksiniz:

- Sanal ağda Azure Databricks çalışma alanı oluşturma

- Azure Cosmos DB hizmet uç noktası oluşturma

- Azure Cosmos DB hesabı oluşturma ve verileri içeri aktarma

- Azure Databricks kümesi oluşturma

- Azure Databricks not defterinden Azure Cosmos DB'yi sorgulama

Önkoşullar

Başlamadan önce aşağıdakileri yapın:

Spark bağlayıcısını indirin.

NOAA Ulusal Çevre Bilgileri Merkezlerinden örnek verileri indirin. Bir durum veya alan seçin ve Ara'yı seçin. Sonraki sayfada varsayılanları kabul edin ve Ara'yı seçin. Ardından sonuçları indirmek için sayfanın sol tarafındaki CSV İndir'i seçin.

Azure Cosmos DB Veri Geçiş Aracı'nın önceden derlenmiş ikili dosyasını indirin.

Azure Cosmos DB hizmet uç noktası oluşturma

Azure Databricks çalışma alanını bir sanal ağa dağıttıktan sonra Azure portal sanal ağa gidin. Databricks dağıtımı aracılığıyla oluşturulan genel ve özel alt ağlara dikkat edin.

Genel alt ağı seçin ve bir Azure Cosmos DB hizmet uç noktası oluşturun. Ardından Kaydet'i seçin.

Azure Cosmos DB hesabı oluşturma

Azure portal açın. Ekranın sol üst tarafında Kaynak > veritabanları > oluştur Azure Cosmos DB'yi seçin.

Temel Bilgiler sekmesindeki Örnek Ayrıntıları'nı aşağıdaki ayarlarla doldurun:

Ayarı Değer Abonelik aboneliğiniz Kaynak Grubu kaynak grubunuz Hesap Adı db-vnet-service-endpoint API Çekirdek (SQL) Konum Batı ABD Geo-Redundancy Devre dışı bırakmak Çok Bölgeli Yazma İşlemleri Etkinleştirmek

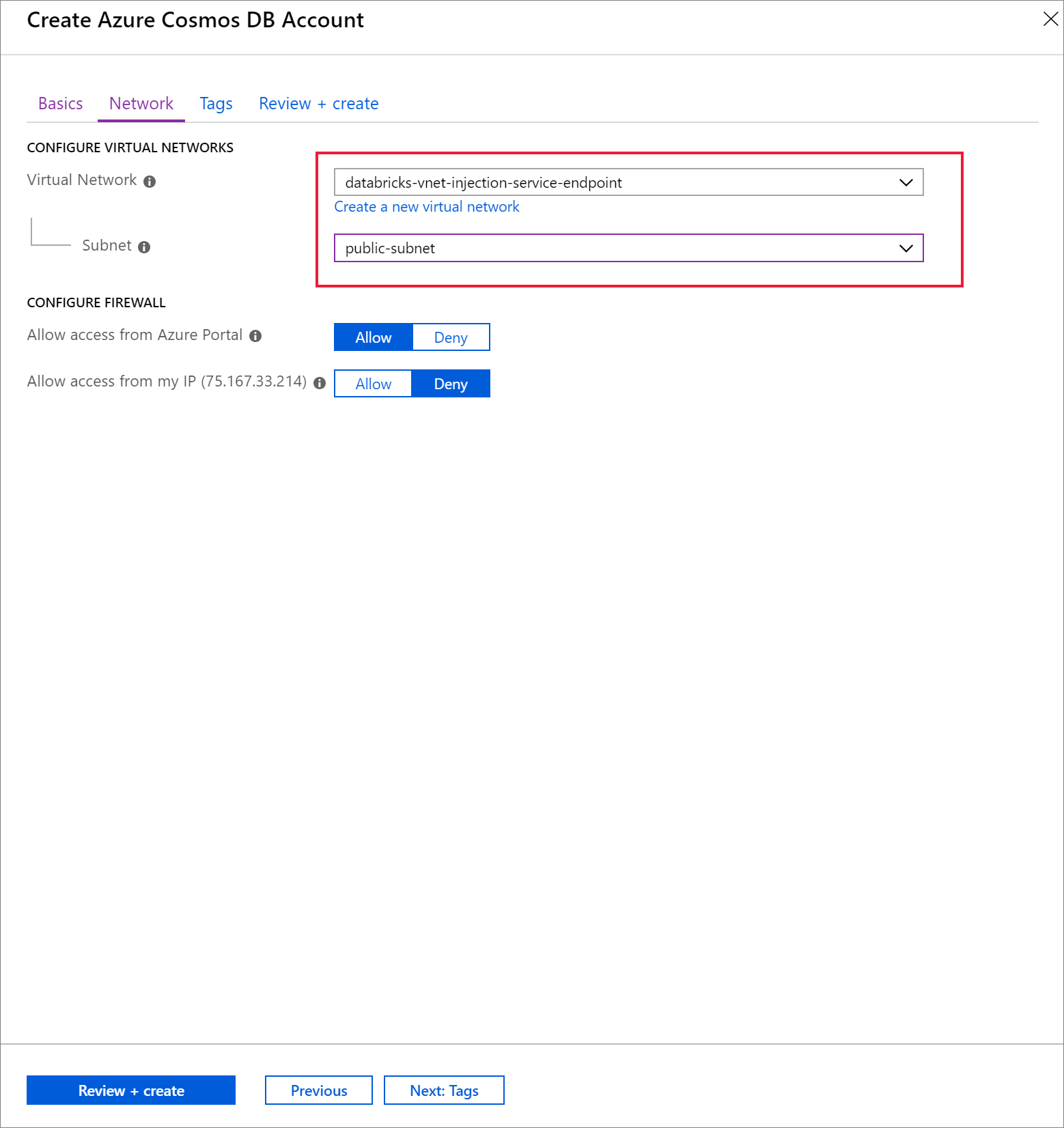

Ağ sekmesini seçin ve sanal ağınızı yapılandırın.

A. Önkoşul olarak oluşturduğunuz sanal ağı seçin ve ardından public-subnet seçeneğini belirleyin. Özel alt ağın'Microsoft AzureCosmosDB' uç noktası eksik' notunu aldığına dikkat edin. Bunun nedeni yalnızca genel alt ağda Azure Cosmos DB hizmet uç noktasını etkinleştirmenizdir.

B. Azure portal erişimine izin ver seçeneğinin etkinleştirildiğinden emin olun. Bu ayar, Azure Cosmos DB hesabınıza Azure portal erişmenizi sağlar. Bu seçenek Reddet olarak ayarlanırsa hesabınıza erişmeye çalışırken hata alırsınız.

Not

Bu öğretici için gerekli değildir, ancak Yerel makinenizden Azure Cosmos DB hesabınıza erişmek istiyorsanız IP'den erişime izin ver seçeneğini de etkinleştirebilirsiniz. Örneğin, Azure Cosmos DB SDK'sını kullanarak hesabınıza bağlanıyorsanız bu ayarı etkinleştirmeniz gerekir. Devre dışı bırakılırsa "Erişim Reddedildi" hataları alırsınız.

Azure Cosmos DB hesabınızı sanal ağ içinde oluşturmak için Gözden Geçir + Oluştur'u ve ardından Oluştur'u seçin.

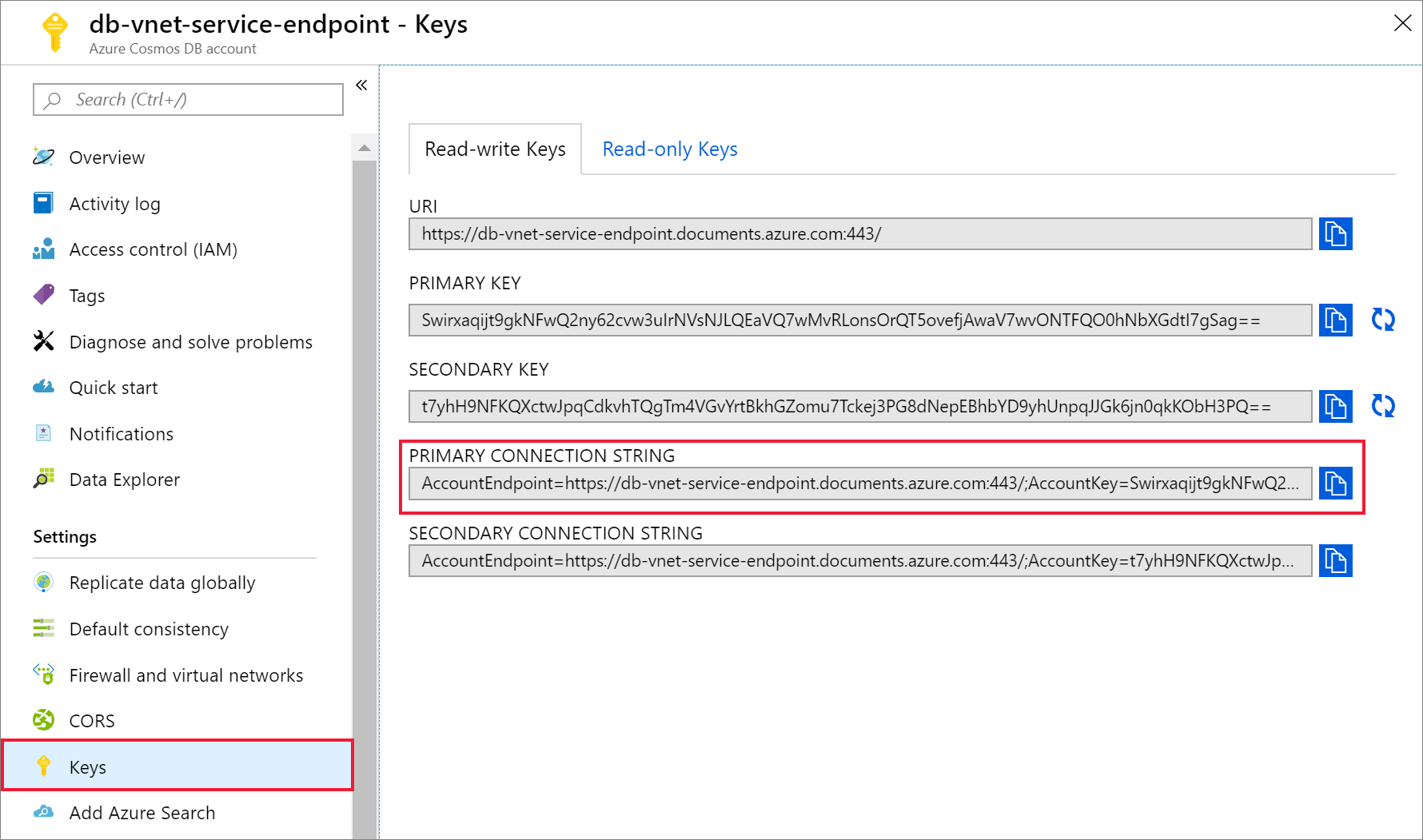

Azure Cosmos DB hesabınız oluşturulduktan sonra Ayarlar'ın altında Anahtarlar'a gidin. Birincil bağlantı dizesini kopyalayın ve daha sonra kullanmak üzere bir metin düzenleyicisine kaydedin.

Azure Cosmos DB hesabınıza yeni bir veritabanı ve kapsayıcı eklemek için Veri Gezgini ve Yeni Kapsayıcı'ya tıklayın.

Azure Cosmos DB'ye veri yükleme

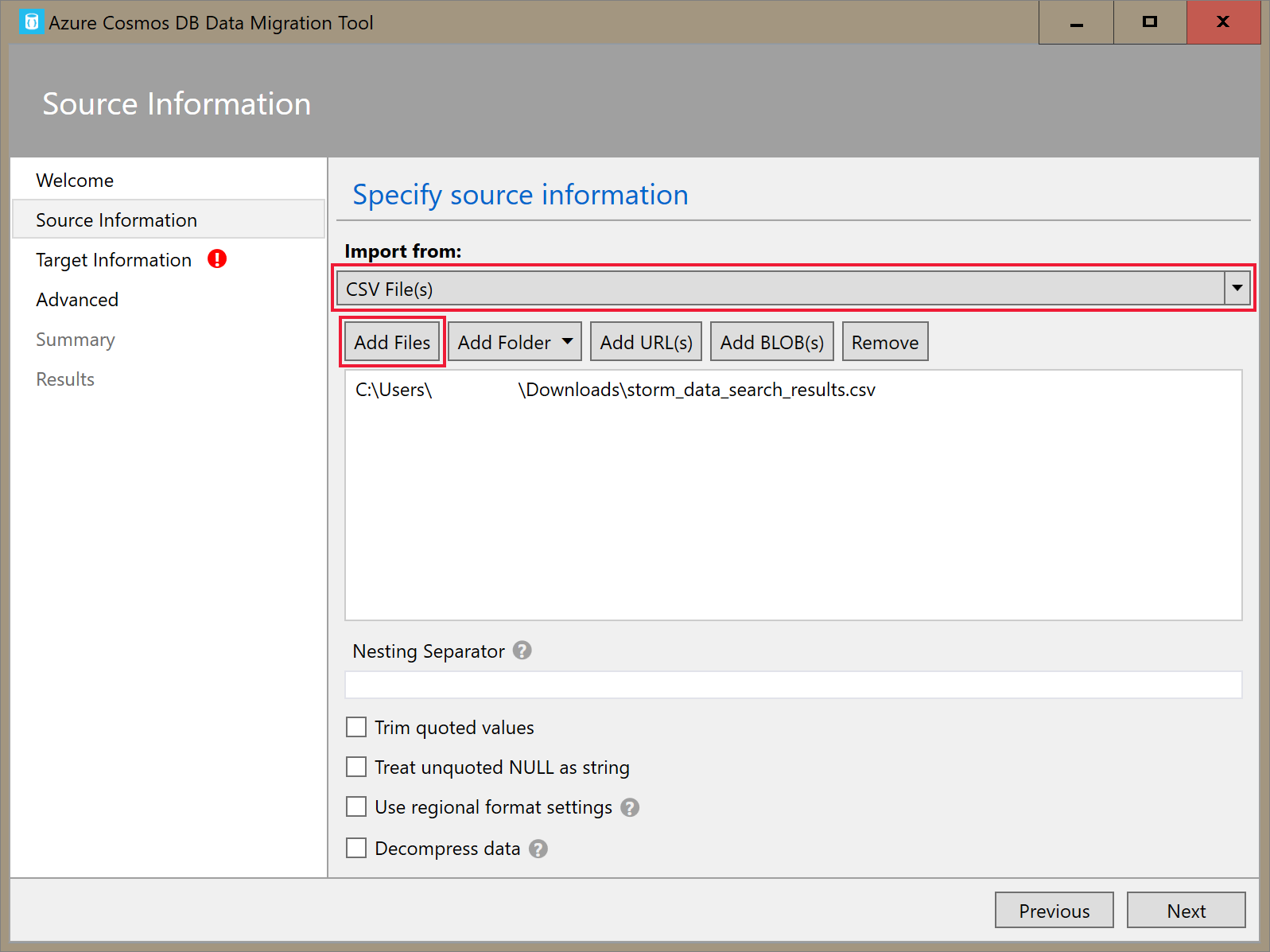

Azure Cosmos DB için veri geçiş aracının grafik arabirim sürümünü açınDtui.exe.

Kaynak Bilgileri sekmesinde, İçeri aktarma kaynağı açılan listesinde CSV Dosyaları'nı seçin. Ardından Dosya Ekle'yi seçin ve indirdiğiniz storm verileri CSV'sini önkoşul olarak ekleyin.

Hedef Bilgileri sekmesinde bağlantı dizenizi girin. Bağlantı dizesi biçimi şeklindedir

AccountEndpoint=<URL>;AccountKey=<key>;Database=<database>. AccountEndpoint ve AccountKey, önceki bölümde kaydettiğiniz birincil bağlantı dizesine eklenir. Bağlantı dizesinin sonuna ekleyinDatabase=<your database name>ve Doğrula'yı seçin. Ardından Kapsayıcı adını ve bölüm anahtarını ekleyin.

Özet sayfasına gelene kadar İleri'yi seçin. Ardından İçeri Aktar'ı seçin.

Küme oluşturma ve kitaplık ekleme

Azure portal Azure Databricks hizmetinize gidin ve Çalışma Alanını Başlat'ı seçin.

Yeni bir küme oluşturun. Küme Adı'nı seçin ve kalan varsayılan ayarları kabul edin.

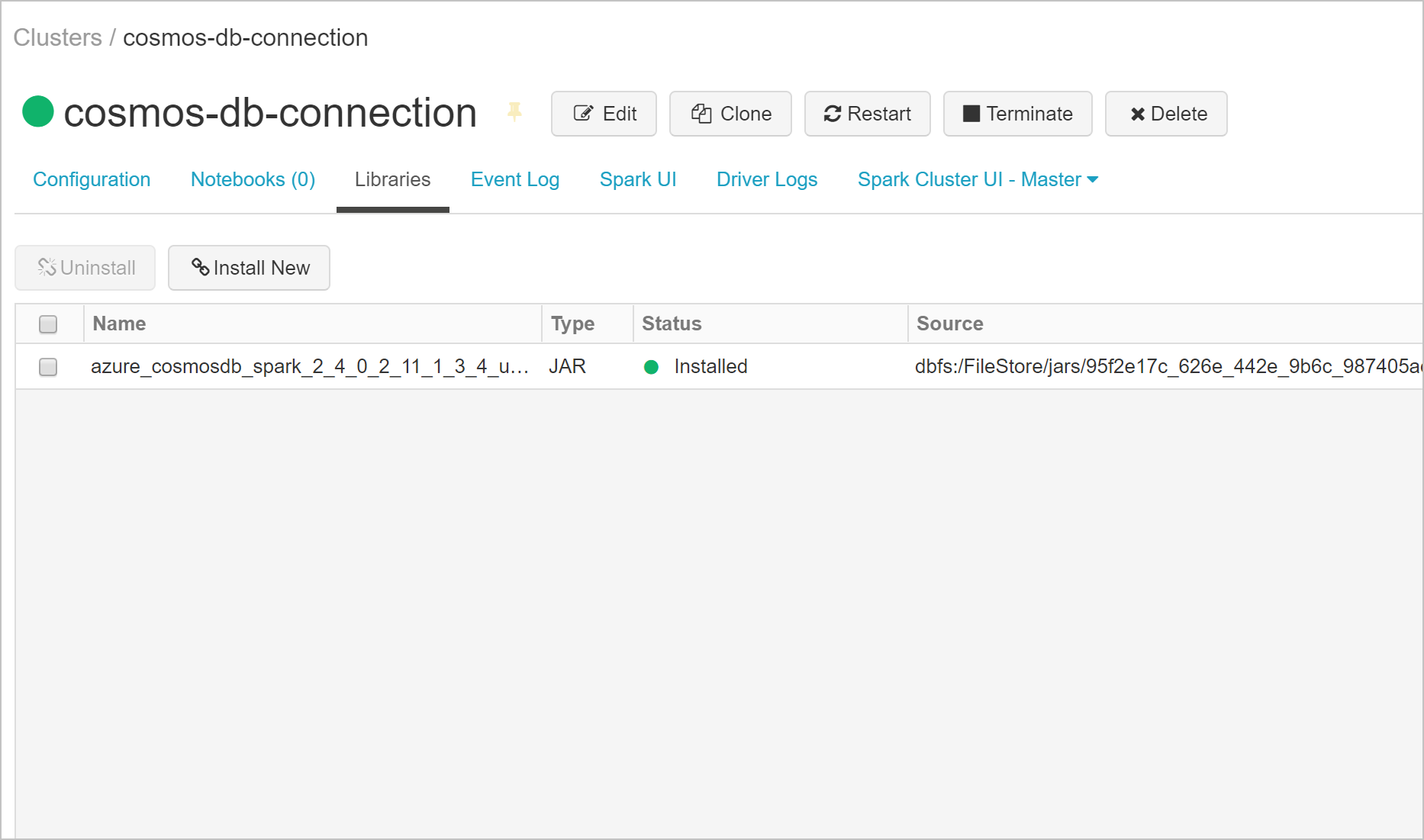

Kümeniz oluşturulduktan sonra küme sayfasına gidin ve Kitaplıklar sekmesini seçin. Yeni Yükle'yi seçin ve kitaplığı yüklemek için Spark bağlayıcısı jar dosyasını karşıya yükleyin.

Kitaplıklar sekmesinde kitaplığın yüklü olduğunu doğrulayabilirsiniz.

Databricks not defterinden Azure Cosmos DB sorgulama

Azure Databricks çalışma alanınıza gidin ve yeni bir Python not defteri oluşturun.

Azure Cosmos DB bağlantı yapılandırmasını ayarlamak için aşağıdaki python kodunu çalıştırın. Endpoint, Masterkey, Database ve Container değerlerini uygun şekilde değiştirin.

connectionConfig = { "Endpoint" : "https://<your Azure Cosmos DB account name.documents.azure.com:443/", "Masterkey" : "<your Azure Cosmos DB primary key>", "Database" : "<your database name>", "preferredRegions" : "West US 2", "Container": "<your container name>", "schema_samplesize" : "1000", "query_pagesize" : "200000", "query_custom" : "SELECT * FROM c" }Verileri yüklemek ve geçici bir görünüm oluşturmak için aşağıdaki Python kodunu kullanın.

users = spark.read.format("com.microsoft.azure.cosmosdb.spark").options(**connectionConfig).load() users.createOrReplaceTempView("storm")Veri döndüren bir SQL deyimi yürütmek için aşağıdaki sihirli komutu kullanın.

%sql select * from stormSanal ağa eklenen Databricks çalışma alanınızı hizmet uç noktası özellikli bir Azure Cosmos DB kaynağına başarıyla bağladınız. Azure Cosmos DB'ye bağlanma hakkında daha fazla bilgi edinmek için bkz. Apache Spark için Azure Cosmos DB Bağlayıcısı.

Kaynakları temizleme

Artık gerekli olmadığında kaynak grubunu, Azure Databricks çalışma alanını ve tüm ilgili kaynakları silin. İşin silinmesi gereksiz faturalamayı önler. Gelecekte Azure Databricks çalışma alanını kullanmayı planlıyorsanız kümeyi durdurup daha sonra yeniden başlatabilirsiniz. Bu Azure Databricks çalışma alanını kullanmaya devam etmeyecekseniz, aşağıdaki adımları kullanarak bu öğreticide oluşturduğunuz tüm kaynakları silin:

Azure portal sol taraftaki menüden Kaynak grupları'na ve ardından oluşturduğunuz kaynak grubunun adına tıklayın.

Kaynak grubu sayfanızda Sil'i seçin, metin kutusuna silinecek kaynağın adını yazın ve sonra yeniden Sil'i seçin.

Sonraki adımlar

Bu öğreticide, sanal ağa bir Azure Databricks çalışma alanı dağıttınız ve Databricks'ten Azure Cosmos DB verilerini sorgulamak için Azure Cosmos DB Spark bağlayıcısını kullandınız. Sanal ağda Azure Databricks ile çalışma hakkında daha fazla bilgi edinmek için Azure Databricks ile SQL Server kullanma öğreticisine geçin.