管理 Robots.txt 和站点地图文件

IIS 搜索引擎优化工具包包括一个“机器人排除”功能,可用于管理网站的 Robots.txt 文件的内容,并包括“站点地图和站点地图索引”功能,可用于管理站点的站点地图。 本演练介绍了如何使用这些功能以及为何使用这些功能。

背景

搜索引擎爬网程序将花费有限的时间和资源在网站上。 因此,必须执行以下操作:

- 防止爬网程序为不重要或不应显示在搜索结果页中的内容编制索引。

- 将爬网程序指向你认为对编制索引最重要的内容。

有两种协议通常用于实现这些任务:机器人排除协议和站点地图协议。

机器人排除协议用于告知搜索引擎爬网程序在爬网网站时不应请求的 URL。 排除指令放置在名为 Robots.txt 的文本文件中,该文件位于网站的根目录中。 大多数搜索引擎爬网程序通常会查找此文件,并按照其中的指令进行操作。

站点地图协议用于通知搜索引擎爬网程序网站上可用于爬网的 URL。 此外,站点地图还用于提供有关站点 URL 的一些附加元数据,例如上次修改时间、修改频率、相对优先级等。搜索引擎在为网站编制索引时可能会使用此元数据。

先决条件

1.设置网站或应用程序

若要完成本演练,需要 IIS 7 或更高版本托管的网站或由你控制的 Web 应用程序。 如果没有,可以从 Microsoft Web 应用程序库安装一个。 在本演练中,我们将使用常用的博客应用程序 DasBlog。

2.分析网站:

有了网站或 Web 应用程序后,可能需要分析它,以了解典型的搜索引擎如何对其内容进行爬网。 为此,请按照文章“使用站点分析爬网网站”和“使用站点分析报告”中所述的步骤进行操作。 执行分析时,你可能会注意到,某些 URL 可供搜索引擎爬网,但在对其进行爬网或编制索引方面没有实际的好处。 例如,搜索引擎爬网程序甚至不应请求登录页面或资源页面。 此类 URL 应通过将它们添加到 Robots.txt 文件来隐藏搜索引擎。

管理 Robots.txt 文件

可以使用 IIS SEO 工具包的“机器人排除”功能创作一个 Robots.txt 文件,该文件告知搜索引擎不应对网站哪些部分进行爬网或编制索引。 以下步骤介绍如何使用此工具。

- 通过在“开始”菜单中键入 INETMGR 打开 IIS 管理控制台。

- 使用左侧的树视图(例如默认网站)导航到网站。

- 单击“管理”部分中的“搜索引擎优化”图标:

- 在 SEO 主页上,单击“机器人排除”部分中的“添加新禁止规则”任务链接。

添加禁止和允许规则

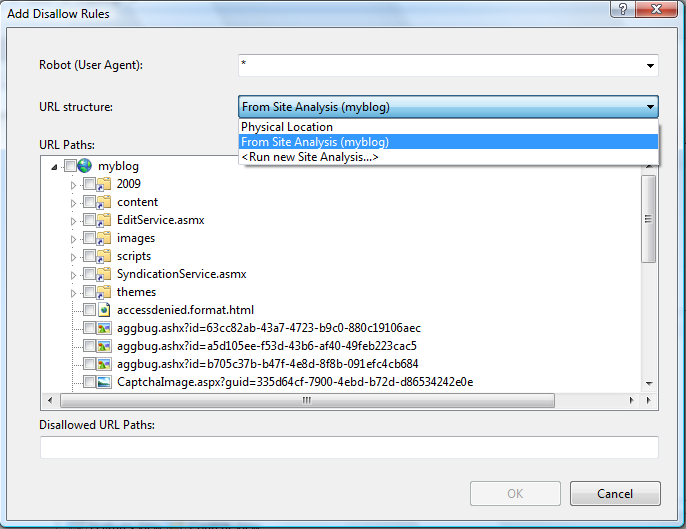

“添加禁止规则”对话框将自动打开:

机器人排除协议使用“允许”和“禁止”指令通知搜索引擎可以爬网的 URL 路径和不能爬网的路径。 可以为所有搜索引擎或由用户代理 HTTP 标头标识的特定用户代理指定这些指令。 在“添加禁止规则”对话框中,可以通过将爬网程序的用户代理输入到“机器人(用户代理)”字段来指定指令适用的搜索引擎爬网程序。

URL 路径树视图用于选择应禁止的 URL。 使用“URL 结构”下拉列表选择 URL 路径时,可以从多个选项中进行选择:

- 物理位置 - 可以从网站的物理文件系统布局中选择路径。

- 从站点分析(分析名称)- 可以从使用 IIS 站点分析工具分析站点时发现的虚拟 URL 结构中选择路径。

- <运行新的站点分析...> - 可以运行新的站点分析来获取网站的虚拟 URL 结构,然后从那里选择 URL 路径。

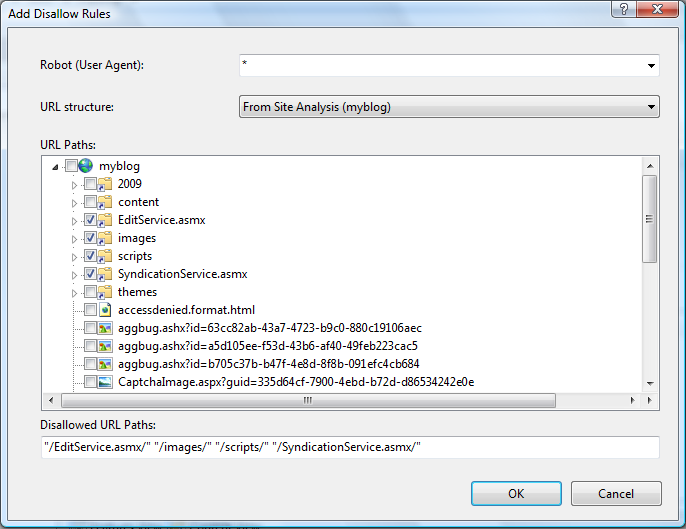

完成先决条件部分中所述的步骤后,你将得到一个站点分析。 在下拉列表中选择分析,然后使用“URL 路径”树视图中的复选框勾选需要向搜索引擎隐藏的 URL:

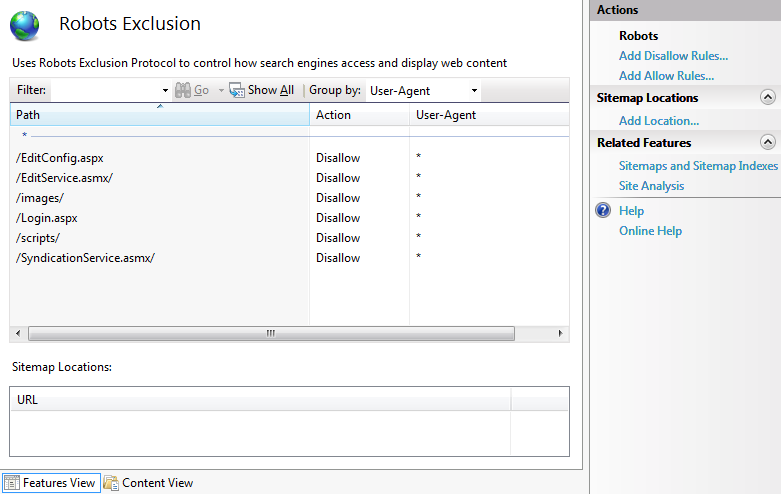

选择所有需要禁止的目录和文件后,单击“确定”。 你将在主要功能视图中看到新的禁止条目:

此外,站点 Robots.txt 文件将更新(如果该文件不存在,则创建一个)。 其内容将会类似于以下内容:

User-agent: *

Disallow: /EditConfig.aspx

Disallow: /EditService.asmx/

Disallow: /images/

Disallow: /Login.aspx

Disallow: /scripts/

Disallow: /SyndicationService.asmx/

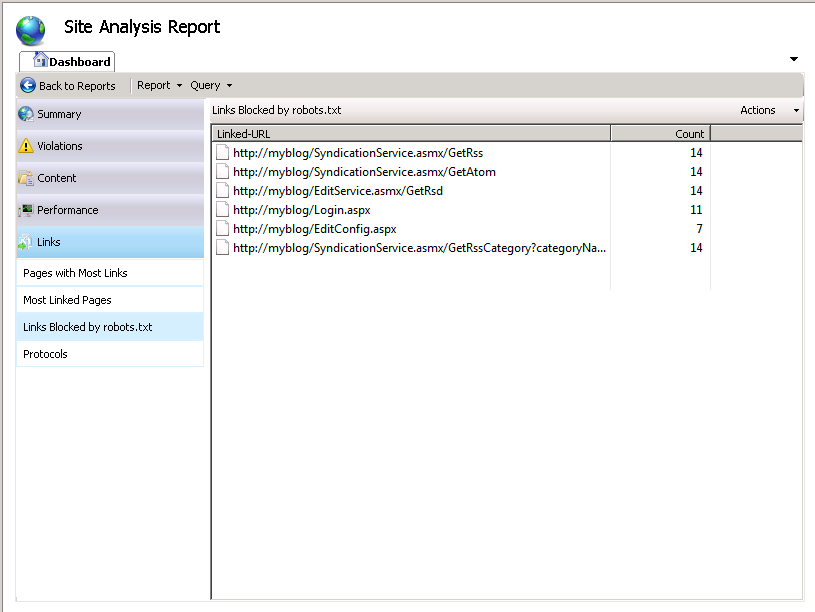

若要查看 Robots.txt 的工作原理,请返回到“站点分析”功能,然后重新运行站点的分析。 在“报表摘要”页面上的“链接”类别中,选择“Robots.txt 阻止的链接”。 此报表将显示尚未爬网的所有链接,因为它们已被刚刚创建的 Robots.txt 文件禁止。

管理站点地图文件

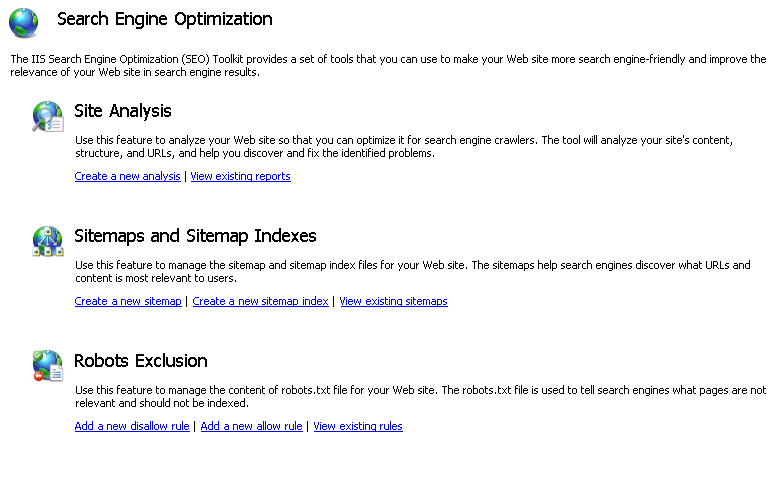

可以使用 IIS SEO 工具包的站点地图和站点地图索引功能在网站上创作站点地图,以通知搜索引擎应爬网和编制索引的页面。 为此,请按照下列步骤进行操作:

- 通过在“开始”菜单中键入 INETMGR 打开 IIS 管理器。

- 使用左侧的树视图导航到网站。

- 单击“管理”部分中的“搜索引擎优化”图标:

- 在 SEO 主页上,单击“站点地图和站点地图索引”部分中的“创建新的站点地图”任务链接。

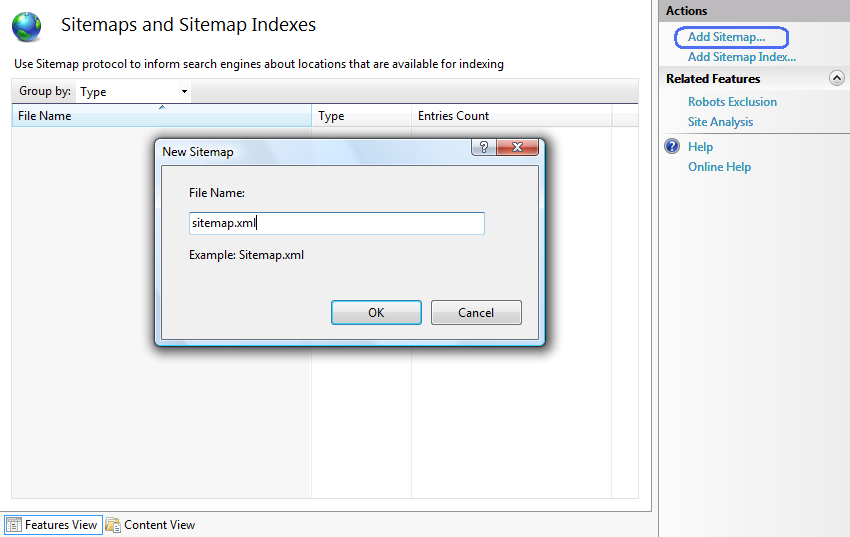

- “添加站点地图”对话框将自动打开。

- 键入站点地图文件的名称,然后单击“确定”。 会出现“添加 URL”对话框。

将 URL 添加到站点地图

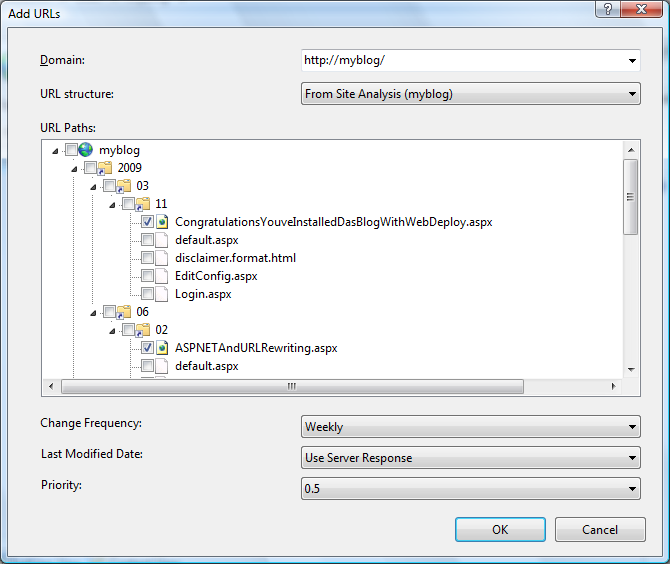

“添加 URL”对话框如下所示:

站点地图文件本质上是一个简单的 XML 文件,其中列出了 URL 以及某些元数据,例如更改频率、上次修改日期和相对优先级。 使用“添加 URL”对话框向 Sitemap xml 文件添加新的 URL 条目。 站点地图中的每个 URL 都必须采用完全限定的 URI 格式(即必须包含协议前缀和域名)。 因此,必须指定的第一件事是将用于要添加到站点地图的 URL 的域。

URL 路径树视图用于选择应添加到站点地图进行索引编制的 URL。 使用“URL 结构”下拉列表可以从多个选项中选择:

- 物理位置 - 可以从网站的物理文件系统布局中选择 URL。

- 从站点分析(分析名称)- 可以从使用站点分析工具分析站点时发现的虚拟 URL 结构中选择 URL。

- <运行新的站点分析...> - 可以运行新的站点分析来获取网站的虚拟 URL 结构,然后从那里选择 URL 要添加得用于索引编制的路径。

完成先决条件部分中的步骤后,你将得到一个站点分析。 从下拉列表中选择它,然后勾选需要添加到站点地图的 URL。

必要时,修改“更改频率”、“上次修改日期”和“优先级”选项,然后单击“确定”以将 URL 添加到站点地图。 sitemap.xml 文件将会更新(如果该文件不存在,则创建一个),其内容如下所示:

<urlset>

<url>

<loc>http://myblog/2009/03/11/CongratulationsYouveInstalledDasBlogWithWebDeploy.aspx</loc>

<lastmod>2009-06-03T16:05:02</lastmod>

<changefreq>weekly</changefreq>

<priority>0.5</priority>

</url>

<url>

<loc>http://myblog/2009/06/02/ASPNETAndURLRewriting.aspx</loc>

<lastmod>2009-06-03T16:05:01</lastmod>

<changefreq>weekly</changefreq>

<priority>0.5</priority>

</url>

</urlset>

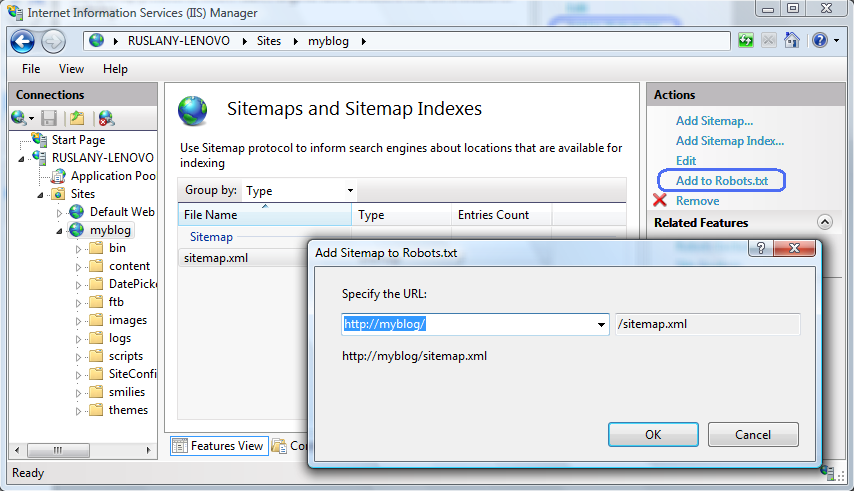

将站点地图位置添加到 Robots.txt 文件

创建站点地图后,需要让搜索引擎知道其所在位置,以便他们可以开始使用它。 执行此操作的最简单方法是将站点地图位置 URL 添加到 Robots.txt 文件。

在“站点地图和站点地图索引”功能中,选择刚刚创建的站点地图,然后单击“操作”窗格中的“添加到 Robots.txt”:

Robots.txt 文件类似于以下内容:

User-agent: *

Disallow: /EditService.asmx/

Disallow: /images/

Disallow: /scripts/

Disallow: /SyndicationService.asmx/

Disallow: /EditConfig.aspx

Disallow: /Login.aspx

Sitemap: http://myblog/sitemap.xml

向搜索引擎注册站点地图

除了将站点地图位置添加到 Robots.txt 文件之外,建议将站点地图位置 URL 提交到主要搜索引擎。 这将允许你从搜索引擎的网站管理员工具获取有关网站的有用状态和统计信息。

总结

在本演练中,你已了解如何使用 IIS 搜索引擎优化工具包的机器人排除及站点地图和站点地图索引功能来管理网站上的 Robots.txt 和站点地图文件。 IIS 搜索引擎优化工具包提供了一组集成的工具,可帮助你创作和验证 Robots.txt 和站点地图文件的正确性,然后再提供给搜索引擎使用。

反馈

即将发布:在整个 2024 年,我们将逐步淘汰作为内容反馈机制的“GitHub 问题”,并将其取代为新的反馈系统。 有关详细信息,请参阅:https://aka.ms/ContentUserFeedback。

提交和查看相关反馈