Memperkenalkan interaksi insting

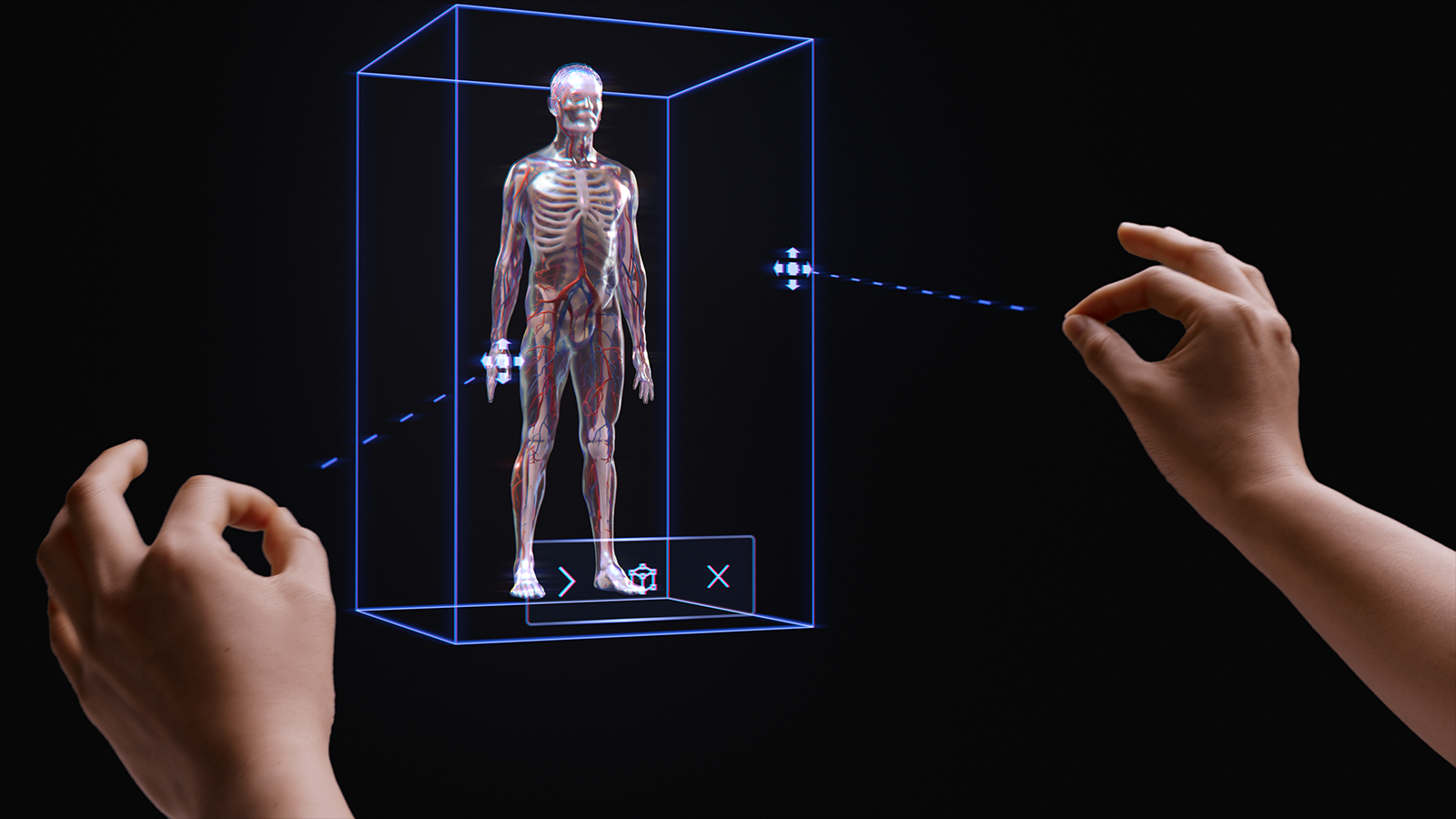

Filosofi interaksi sederhana dan insting terjalin di seluruh platform mixed reality (MR). Kami telah mengambil tiga langkah untuk memastikan bahwa perancang dan pengembang aplikasi dapat memberikan interaksi yang mudah dan intuitif kepada pelanggan mereka.

Pertama, kami telah memastikan sensor dan teknologi input kami digabungkan ke dalam model interaksi multimodal. Model interaksi ini termasuk pelacakan tangan dan mata bersama dengan input bahasa alami. Berdasarkan penelitian kami, merancang dan mengembangkan dalam kerangka kerja multimodal (dan bukan berdasarkan input individu) adalah kunci untuk menciptakan pengalaman insting.

Kedua, kami menyadari bahwa banyak pengembang menargetkan beberapa perangkat HoloLens, seperti HoloLens 2 dan HoloLens (generasi ke-1) atau HoloLens dan VR. Jadi kami telah merancang model interaksi kami untuk bekerja di seluruh perangkat, bahkan jika teknologi input bervariasi pada setiap perangkat. Misalnya, interaksi jauh pada headset Windows Immersive dengan pengontrol 6DoF dan HoloLens 2 keduanya menggunakan ketertanggungan dan pola yang identik. Ini memudahkan pengembangan aplikasi lintas perangkat dan memberikan nuansa alami bagi interaksi pengguna.

Meskipun kami menyadari bahwa ada ribuan interaksi yang efektif, menarik, dan ajaib yang mungkin dilakukan di MR, kami telah menemukan bahwa dengan sengaja menggunakan satu model interaksi dalam aplikasi adalah cara terbaik untuk memastikan pengguna sukses dan memiliki pengalaman hebat. Untuk itu, kami telah menyertakan tiga hal dalam panduan interaksi ini:

- Panduan khusus sekilas tentang tiga model interaksi utama dan komponen dan pola yang diperlukan untuk masing-masing model interaksi utama.

- Panduan tambahan tentang manfaat lain yang diberikan platform kami.

- Panduan umum untuk membantu memilih model interaksi yang sesuai untuk skenario pengembangan Anda.

Pelacakan tangan dasar dan demo interaksi insting

Lihat demo video Designing Holograms - Pelacakan Kepala dan Pelacakan Mata di bawah ini, lalu lanjutkan ke topik yang lebih spesifik:

Video ini diambil dari aplikasi HoloLens 2 "Merancang Hologram". Unduh dan nikmati pengalaman lengkapnya di sini.

Model interaksi multimodal

Berdasarkan penelitian dan umpan balik kami dari pelanggan, kami menemukan bahwa tiga model interaksi utama paling sesuai dengan pengalaman realitas campuran. Dalam banyak hal, model interaksi adalah model mental pengguna tentang cara menyelesaikan alur kerja. Masing-masing model interaksi ini dioptimalkan untuk serangkaian kebutuhan pelanggan dan nyaman, kuat, dan dapat digunakan ketika digunakan dengan benar.

Bagan di bawah ini adalah gambaran umum yang disederhanakan. Informasi terperinci untuk menggunakan setiap model interaksi ditautkan di halaman di bawah ini dengan gambar dan sampel kode.

| Model | Skenario contoh | Fit | Perangkat Keras |

| Pengontrol tangan dan gerakan | Pengalaman spasial 3D, seperti tata ruang dan desain spasial, manipulasi konten, atau simulasi. | Bagus untuk pengguna baru ditambah dengan suara, pelacakan mata atau tatapan kepala. Kurva belajar rendah. UX yang konsisten di seluruh pelacakan tangan dan pengontrol 6DoF. | HoloLens 2 Headset imersif |

| Tanpa menggunakan tangan/Hands-free | Pengalaman kontekstual di mana tangan pengguna sedang sibuk, seperti pembelajaran dan pemeliharaan di tempat kerja. | Beberapa pembelajaran diperlukan. Jika tangan tidak tersedia, perangkat tersebut sangat memadai dengan suara dan bahasa alami. | HoloLens 2 HoloLens (generasi ke-1) Headset imersif |

| Tatapan dan penerapan | Pengalaman melalui-klik, misalnya, presentasi 3D, demo. | Memerlukan pelatihan tentang HMD tetapi tidak pada perangkat seluler. Terbaik untuk pengontrol yang dapat diakses. Terbaik untuk HoloLens (generasi ke-1). | HoloLens 2 HoloLens (generasi ke-1) Headset imersif AR Seluler |

Untuk menghindari kesenjangan dalam pengalaman interaksi pengguna, yang terbaik adalah mengikuti panduan untuk satu model dari awal hingga akhir.

Bagian di bawah ini menjelaskan langkah-langkah untuk memilih dan mengimplementasikan salah satu model interaksi ini.

Pada akhir halaman ini, Anda akan memahami panduan kami tentang:

- Memilih model interaksi untuk pelanggan Anda

- Menerapkan model interaksi

- Transisi antar model interaksi

- Mendesain langkah berikutnya

Pilih model interaksi untuk pelanggan Anda

Biasanya, pengembang dan kreator telah memikirkan jenis interaksi yang dapat dimiliki pelanggan mereka. Untuk mendorong pendekatan yang berfokus pada pelanggan untuk merancang, kami merekomendasikan panduan berikut untuk memilih model interaksi yang dioptimalkan untuk pelanggan Anda.

Mengapa mengikuti panduan ini?

- Kami menguji model interaksi kami untuk kriteria objektif dan subjektif, termasuk upaya fisik dan kognitif, intuitifitas, dan kemampuan belajar.

- Karena interaksi berbeda, ketergantungan visual/audio dan perilaku objek mungkin berbeda antara model interaksi.

- Menggabungkan bagian-bagian dari beberapa model interaksi menciptakan risiko bersaing dengan kemampuan, seperti sinar tangan simultan dan kursor tatapan kepala. Ini dapat membuat pengguna kewalahan dan kebingungan.

Berikut adalah beberapa contoh bagaimana ketertanggungan dan perilaku dioptimalkan untuk setiap model interaksi. Kita sering melihat pengguna baru memiliki pertanyaan serupa, seperti "bagaimana saya tahu sistem berfungsi", "bagaimana saya tahu apa yang bisa saya lakukan", dan "bagaimana saya tahu apakah itu memahami apa yang baru saja saya lakukan?"

| Model | Bagaimana saya tahu itu bekerja? | Bagaimana cara mengetahui apa yang bisa saya lakukan? | Bagaimana saya tahu apa yang baru saja saya lakukan? |

| Pengontrol tangan dan gerakan | Saya melihat jala tangan, kenaikan ujung jari, atau sinar tangan/pengontrol. | Saya melihat handel yang dapat diambil, atau kotak pembatas muncul ketika tangan saya berada di dekat objek. | Aku mendengar nada suara dan melihat animasi pada ambil dan rilis. |

| Tatapan kepala dan penerapan | Saya melihat kursor di tengah bidang tampilan saya. | Kursor mengubah status ketika melebihi objek tertentu. | Saya melihat/mendengar konfirmasi visual dan dapat didengar saat saya mengambil tindakan. |

| Bebas tangan (Tatap kepala dan tempat tinggal) | Saya melihat kursor di tengah bidang tampilan saya. | Saya melihat indikator kemajuan ketika saya tinggal pada objek yang dapat berinteraksi. | Saya melihat/mendengar konfirmasi visual dan dapat didengar saat saya mengambil tindakan. |

| Hands-free (Perintah suara) | Saya melihat indikator mendengarkan dan keterangan yang menunjukkan apa yang didengar sistem. | Saya mendapatkan perintah suara dan petunjuk. Ketika saya mengatakan: "Apa yang bisa saya katakan?" Saya melihat umpan balik. | Saya melihat/mendengar konfirmasi visual dan dapat didengar ketika saya memberikan perintah, atau mendapatkan UX disambiguasi saat diperlukan. |

Di bawah ini adalah pertanyaan yang kami temukan untuk membantu tim memilih model interaksi:

T: Apakah pengguna saya ingin menyentuh hologram dan melakukan manipulasi holografik presisi?

A: Jika demikian, lihat model interaksi pengontrol Tangan dan gerakan untuk penargetan dan manipulasi presisi.T: Apakah pengguna saya perlu menjaga tangan mereka tetap bebas untuk tugas dunia nyata?

A: Jika demikian, lihat model interaksi Hands-free, yang memberikan pengalaman hands-free yang hebat melalui interaksi tatapan dan berbasis suara.T: Apakah pengguna saya memiliki waktu untuk mempelajari interaksi untuk aplikasi MR saya atau apakah mereka memerlukan interaksi dengan kurva pembelajaran terendah yang mungkin?

A: Untuk kurva pembelajaran terendah dan interaksi paling intuitif, kami merekomendasikan model pengontrol Tangan dan gerakan, selama pengguna dapat menggunakan tangan mereka untuk interaksi.T: Apakah pengguna saya menggunakan pengontrol gerakan untuk menunjuk dan memanipulasi?

A: Model pengontrol Tangan dan gerakan mencakup semua panduan untuk pengalaman hebat dengan pengontrol gerakan.T: Apakah pengguna saya menggunakan pengontrol aksesibilitas atau pengontrol Bluetooth umum, seperti clicker?

A: Kami merekomendasikan model Tatapan kepala dan penerapan untuk semua pengontrol yang tidak dilacak. Ini dirancang untuk memungkinkan pengguna melintasi seluruh pengalaman dengan mekanisme "target dan penerapan" sederhana.T: Apakah pengguna saya hanya mengalami kemajuan melalui pengalaman dengan "mengklik" (misalnya di lingkungan seperti peragaan slide 3D), dibandingkan dengan menavigasi tata letak kontrol UI yang padat?

J: Jika pengguna tidak perlu mengontrol banyak UI, Tatapan kepala dan penerapan menawarkan opsi yang dapat dipelajari di mana pengguna tidak perlu khawatir tentang penargetan.T: Apakah pengguna saya menggunakan HoloLens (generasi ke-1) dan headset imersif (VR) HoloLens 2/Windows Mixed Reality?

J: Karena Tatapan kepala dan penerapan adalah model interaksi untuk HoloLens (generasi ke-1), kami menyarankan agar pembuat yang mendukung HoloLens (generasi ke-1) menggunakan Tatapan kepala dan penerapan untuk fitur atau mode apa pun yang akan dialami pengguna pada headset HoloLens (generasi ke-1). Lihat bagian berikutnya tentang Model interaksi transisi untuk detail tentang membuat pengalaman hebat untuk beberapa generasi HoloLens.T: Bagaimana dengan pengguna yang bergerak, mencakup ruang besar atau bergerak di antara spasi, versus pengguna yang cenderung bekerja dalam satu ruang?

A: Salah satu model interaksi akan berfungsi untuk pengguna ini.

Catatan

Panduan lebih khusus untuk desain aplikasi akan segera hadir.

Model interaksi transisi

Ada juga kasus penggunaan yang mungkin memerlukan penggunaan lebih dari satu model interaksi. Misalnya, alur pembuatan aplikasi Anda menggunakan model interaksi "pengontrol tangan dan gerakan" , tetapi Anda ingin menggunakan mode hands-free untuk teknisi lapangan. Jika pengalaman Anda memerlukan beberapa model interaksi, pengguna mungkin mengalami kesulitan bertransisi dari satu model ke model lain, terutama ketika mereka baru menggunakan realitas campuran.

Catatan

Kami terus mengerjakan lebih banyak panduan yang akan tersedia untuk pengembang dan desainer, memberi tahu mereka tentang bagaimana, kapan, dan mengapa menggunakan beberapa model interaksi MR.