Inicio rápido: Creación de un grupo de Apache Spark sin servidor en Azure Synapse Analytics mediante herramientas web

En este inicio rápido, aprenderá a crear un grupo de Apache Spark sin servidor en Azure Synapse mediante herramientas web. Luego, aprenderá a conectarse al grupo de Apache Spark y a ejecutar consultas SQL de Spark en archivos y tablas. Apache Spark permite el análisis rápido de datos y procesamiento de clústeres con el procesamiento en memoria. Para información sobre Spark en Azure Synapse, consulte Introducción: Apache Spark en Azure Synapse.

Importante

La facturación de las instancias de Spark se prorratea por minuto, tanto si se usan como si no. Asegúrese de cerrar la instancia de Spark después de que haya terminado de usarla, o configure un breve tiempo de espera. Para obtener más información, consulte la sección Limpieza de recursos de este artículo.

Si no tiene una suscripción a Azure, cree una cuenta gratuita antes de empezar.

Requisitos previos

- Necesitará una suscripción a Azure. Si es necesario, crea una cuenta gratuita de Azure

- Área de trabajo de Synapse Analytics

- Grupo de Apache Spark sin servidor

Inicio de sesión en Azure Portal

Inicie sesión en Azure Portal.

Si no tiene una suscripción a Azure, cree una cuenta gratuita de Azure antes de empezar.

Creación de un cuaderno

Un cuaderno es un entorno interactivo que admite varios lenguajes de programación. El cuaderno le permite interactuar con los datos, combinar código con texto y Markdown y, realizar visualizaciones simples.

En la vista de Azure Portal del área de trabajo de Azure Synapse que quiera usar, seleccione Iniciar Synapse Studio.

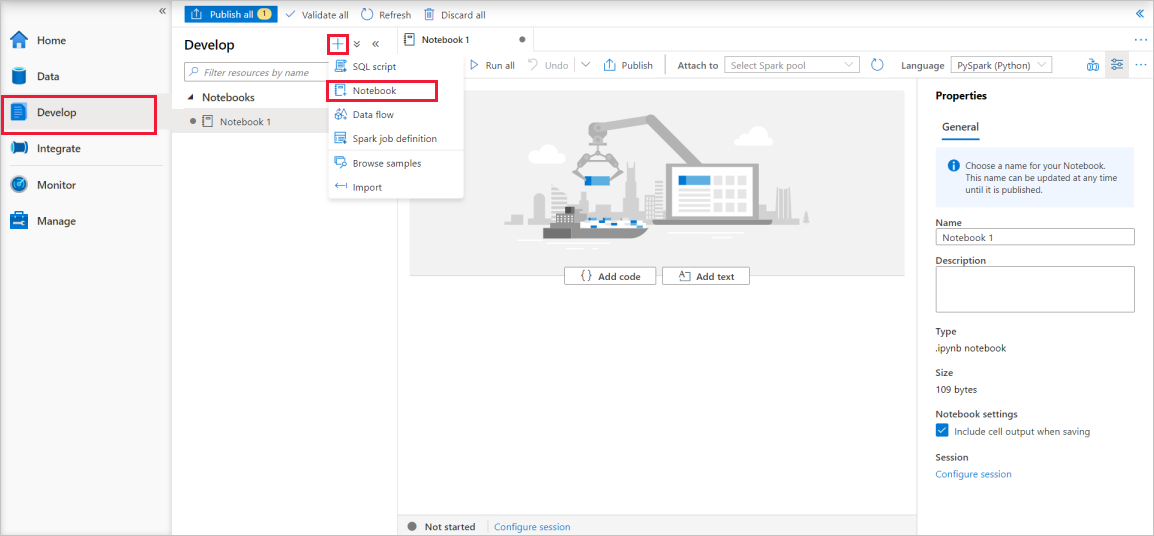

Cuando haya iniciado Synapse Studio, seleccione Desarrollar. A continuación, seleccione el icono " + " para agregar un nuevo recurso.

Desde ahí, seleccione Cuaderno. Se crea un cuaderno y se abre con un nombre generado automáticamente.

En la ventana Properties (Propiedades), proporcione un nombre para el cuaderno.

En la barra de herramientas, haga clic en Publish (Publicar).

Si solo hay un grupo de Apache Spark en el área de trabajo, se selecciona de forma predeterminada. Use la lista desplegable para seleccionar el grupo de Apache Spark correcto si no se selecciona ninguno.

Haga clic en Add code (Agregar código). El lenguaje predeterminado es

Pyspark. Va a usar una combinación de Pyspark y Spark SQL, por lo que la opción predeterminada es correcta. Otros lenguajes admitidos son Scala y .NET para Spark.A continuación, creará un objeto DataFrame simple de Spark para manipularlo. En este caso, se crea a partir del código. Hay tres filas y tres columnas:

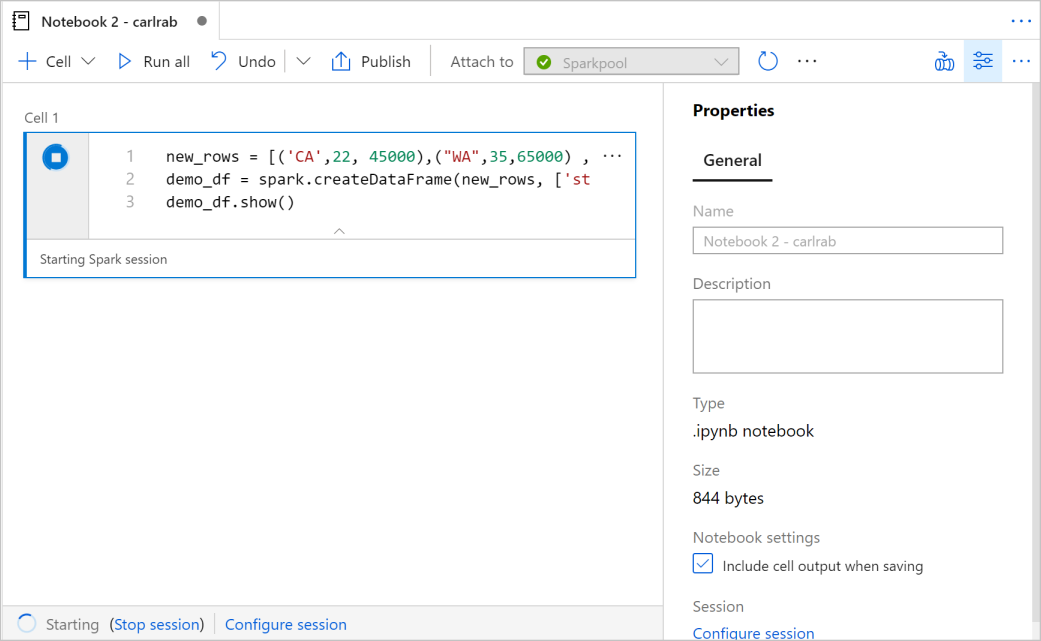

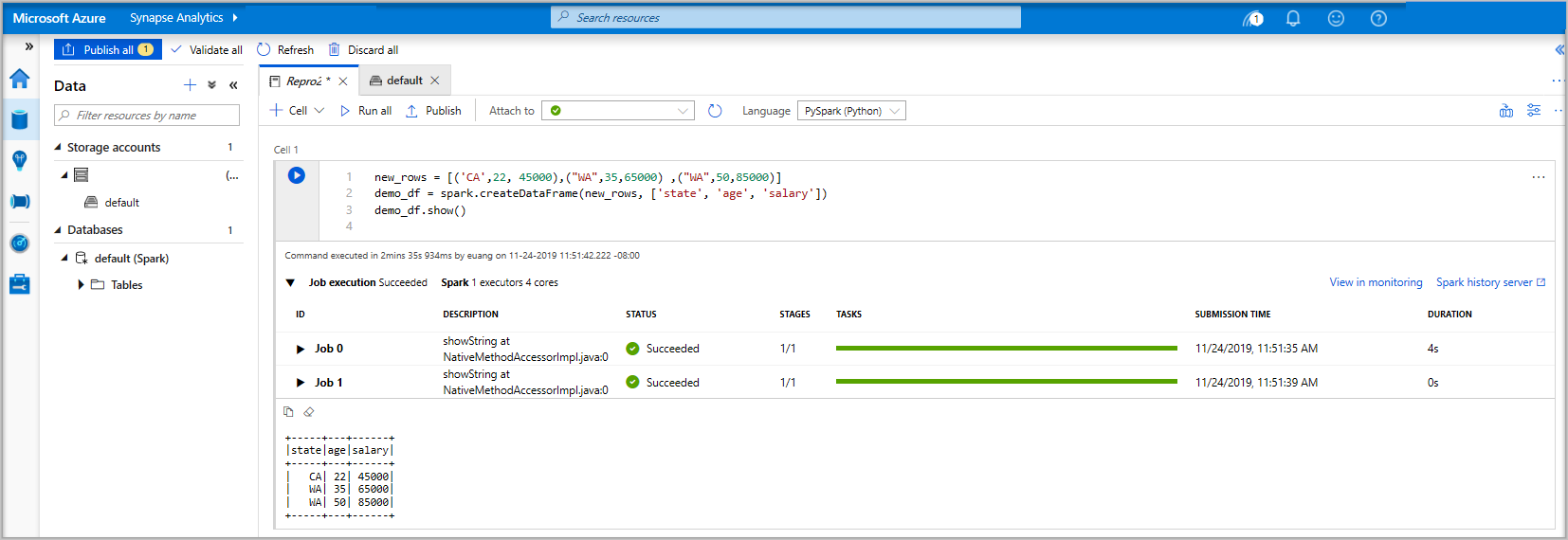

new_rows = [('CA',22, 45000),("WA",35,65000) ,("WA",50,85000)] demo_df = spark.createDataFrame(new_rows, ['state', 'age', 'salary']) demo_df.show()Ahora ejecute la celda con uno de los métodos siguientes:

Presione MAYÚS + ENTRAR.

Seleccione el icono de reproducción azul situado a la izquierda de la celda.

Seleccione el botón Run all (Ejecutar todo) en la barra de herramientas.

Si no se está ejecutando la instancia del grupo de Apache Spark, se inicia automáticamente. Puede ver el estado de la instancia del grupo de Apache Spark tanto debajo de la celda está ejecutando como en el panel de estado de la parte inferior del cuaderno. En función del tamaño del grupo, el inicio debe durar entre 2 y 5 minutos. Una vez que el código haya terminado de ejecutarse, la información que aparece debajo de la celda muestra cuánto tiempo tardó en ejecutarse y su ejecución. En la celda de salida, verá la salida.

Los datos existen ahora en una trama de datos; desde ahí, puede usarlos de muchas maneras diferentes. Los va a necesitar en diferentes formatos durante el resto de este inicio rápido.

Escriba el código siguiente en otra celda y ejecútelo; se crea una tabla de Spark, un archivo CSV y un archivo de Parquet, todos ellos con copias de los datos:

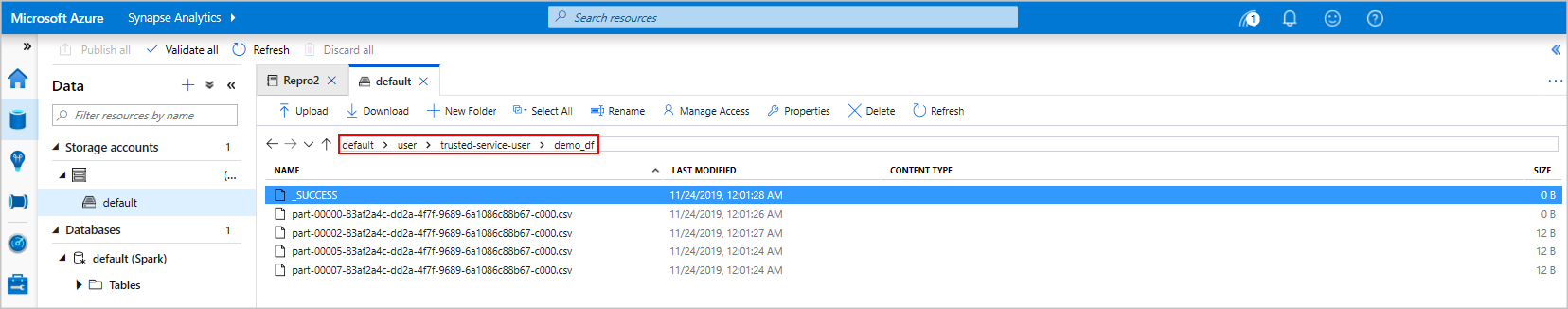

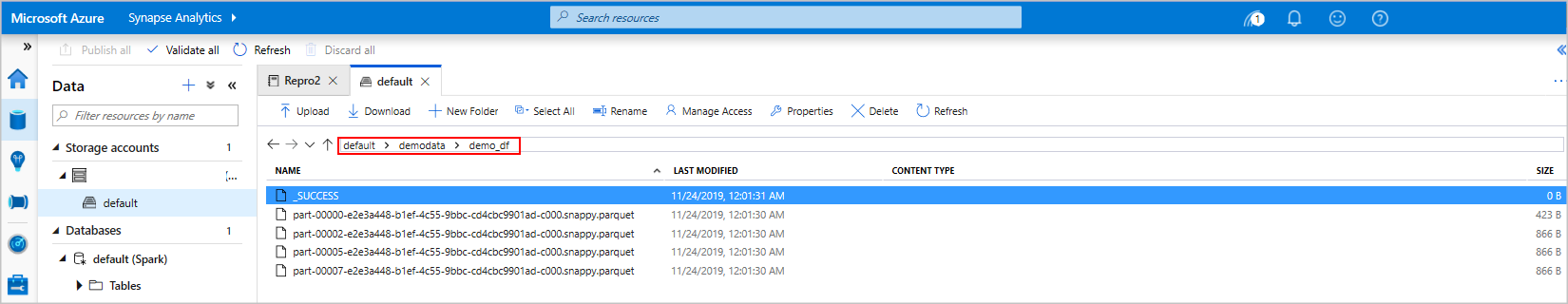

demo_df.createOrReplaceTempView('demo_df') demo_df.write.csv('demo_df', mode='overwrite') demo_df.write.parquet('abfss://<<TheNameOfAStorageAccountFileSystem>>@<<TheNameOfAStorageAccount>>.dfs.core.windows.net/demodata/demo_df', mode='overwrite')Si se usa el explorador de almacenamiento, es posible ver el impacto de las dos formas diferentes de escribir un archivo usadas anteriormente. Cuando no se especifica ningún sistema de archivos, se usa el valor predeterminado, en este caso

default>user>trusted-service-user>demo_df. Los datos se guardan en la ubicación del sistema de archivos especificado.Observe que en los formatos "csv" y "parquet", las operaciones de escritura crean un directorio con muchos archivos con particiones.

Ejecución de instrucciones de Spark SQL

SQL (Lenguaje de consulta estructurado) es el lenguaje más común y ampliamente utilizado para la consulta y definición de datos. Spark SQL funciona como una extensión de Apache Spark para procesar datos estructurados, mediante la conocida sintaxis de SQL.

Pegue el siguiente código en una celda vacía y, luego, ejecútelo. El comando muestra las tablas del grupo.

%%sql SHOW TABLESCuando se usa un cuaderno con el grupo de Apache Spark en Azure Synapse, se obtiene un objeto preestablecido

sqlContextque puede usar para ejecutar consultas con Spark SQL.%%sqlindica al cuaderno que use el valor preestablecido desqlContextpara ejecutar la consulta. La consulta recupera las diez primeras filas de una tabla del sistema que incluye de forma predeterminada todos los grupos de Apache Spark de Azure Synapse.Ejecute otra consulta para ver los datos en

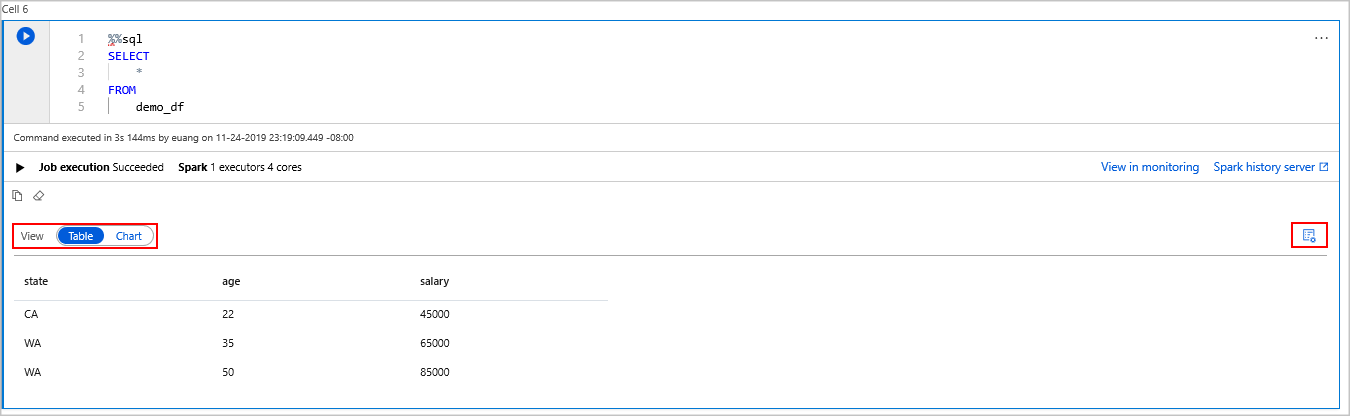

demo_df.%%sql SELECT * FROM demo_dfEl código genera dos celdas de salida, una que contiene los resultados de datos y la otra que muestra la vista del trabajo.

De manera predeterminada la vista de resultados muestra una cuadrícula. Pero hay un modificador de vista debajo que permite cambiar entre la vista de cuadrícula y la de gráfico.

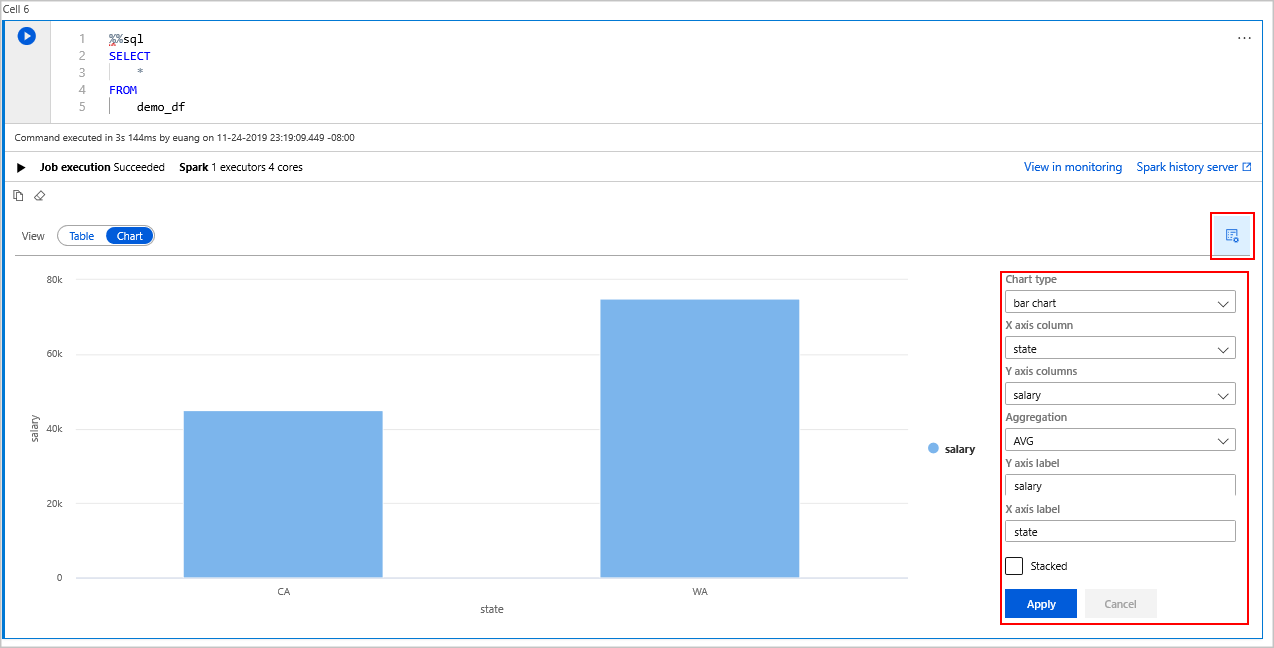

En el modificador View (Vista), seleccione Chart (Gráfico).

Seleccione el icono View options (Opciones de vista) en el extremo derecho.

En el campo Chart type (Tipo de gráfico), seleccione "bar chart" (gráfico de barras).

En el campo de columna del eje X, seleccione "state"(estado).

En el campo de columna del eje Y, seleccione "salary" (salario).

En el campo Aggregation (Agregación), seleccione "AVG" (MEDIA).

Seleccione Aplicar.

Es posible obtener la misma experiencia de ejecutar SQL, pero sin tener que cambiar de lenguaje. Para ello, reemplace la celda de SQL anterior por esta celda de PySpark; la experiencia de salida es la misma porque se usa el comando display:

display(spark.sql('SELECT * FROM demo_df'))Cada una de las celdas que se ejecutaron anteriormente tenía la opción de ir a History Server (Servidor de historial) y Monitoring (Supervisión). Al hacer clic en los vínculos, se le remite a diferentes partes de la experiencia del usuario.

Nota:

Una parte de la documentación oficial de Apache Spark se basa en el uso de la consola de Spark, que no está disponible en Synapse Spark. En su lugar, use las experiencias de cuaderno o IntelliJ.

Limpieza de recursos

Azure Synapse guarda los datos en Azure Data Lake Storage. Puede dejar que se cierre de forma segura una instancia de Spark cuando no esté en uso. Los grupos de Apache Spark sin servidor se le cobrarán mientras estén en ejecución, aunque no esté en uso.

Como en muchas ocasiones los cargos del clúster son mucho más elevados que los cargos de almacenamiento, es mejor para la economía dejar que las instancias de Spark se cierren cuando no estén en uso.

Para asegurarse de que se cierra la instancia de Spark, finalice todas las sesiones (cuadernos) conectadas. El grupo se cierra cuando se alcanza el tiempo de inactividad especificado en el grupo de Apache Spark. También puede decidir finalizar la sesión en la barra de estado en la parte inferior del cuaderno.

Pasos siguientes

En este inicio rápido, ha aprendido a crear un grupo de Apache Spark sin servidor y a ejecutar una consulta básica de SQL de Spark.