Tworzenie asystent głosowych bez kodu w Azure Percept Studio

Ważne

Wycofanie zestawu DK platformy Azure Percept:

Aktualizacja 22 lutego 2023 r. : Aktualizacja oprogramowania układowego dla składników akcesoriów percept DK Vision i Audio (znana również jako Vision and Audio SOM) jest teraz dostępna w tym miejscu i umożliwi składnikom akcesoriów dalsze działanie poza datą wycofania.

Publiczna wersja zapoznawcza platformy Azure Percept będzie ewoluować w celu obsługi nowych platform urządzeń brzegowych i środowisk deweloperskich. W ramach tej ewolucji zestaw Azure Percept DK i akcesoria audio oraz skojarzone z nią usługi platformy Azure dla zestawu DK percept zostaną wycofane 30 marca 2023 r.

Od 30 marca 2023 r. zestaw Azure Percept DK i akcesoria audio nie będą już obsługiwane przez żadne usługi platformy Azure, w tym Azure Percept Studio, aktualizacje systemu operacyjnego, aktualizacje kontenerów, wyświetlanie strumienia internetowego i integrację z Custom Vision. Firma Microsoft nie będzie już zapewniać pomocy technicznej dla klientów i wszelkich powiązanych usług pomocniczych. Aby uzyskać więcej informacji, odwiedź wpis w blogu Powiadomienie o wycofaniu.

W tym samouczku utworzysz asystent głosową z szablonu do użycia z zestawem DK platformy Azure Percept i Azure Percept Audio. Pokaz asystent głosowy działa w Azure Percept Studio i zawiera wybór obiektów wirtualnych sterowanych głosem. Aby kontrolować obiekt, powiedz słowo kluczowe, czyli wyraz lub krótką frazę, która budzi urządzenie, a następnie polecenie. Każdy szablon odpowiada na zestaw określonych poleceń.

Ten przewodnik przeprowadzi Cię przez proces konfigurowania urządzeń, tworzenia asystent głosowych i niezbędnych zasobów usług Speech Services, testowania asystent głosowego, konfigurowania słowa kluczowego i tworzenia niestandardowych słów kluczowych.

Wymagania wstępne

- Azure Percept DK (devkit)

- Azure Percept Audio

- Głośnik lub słuchawki, które mogą łączyć się z gniazdo audio 3,5 mm (opcjonalnie)

- Subskrypcja platformy Azure

- Środowisko konfiguracji zestawu DK platformy Azure Percept: połączono zestaw deweloperski z siecią Wi-Fi, utworzono IoT Hub i połączono zestaw deweloperski z IoT Hub

- konfiguracja Azure Percept Audio

Tworzenie asystent głosowej przy użyciu dostępnego szablonu

Przejdź do Azure Percept Studio.

Otwórz kartę Pokazy & samouczków .

Kliknij pozycję Wypróbuj szablony asystent głosowych w obszarze Samouczki i pokazy usługi Mowa. Spowoduje to otwarcie okna po prawej stronie ekranu.

Wykonaj następujące czynności w oknie:

W menu rozwijanym IoT Hub wybierz centrum IoT Hub, z którym jest połączony zestaw deweloperski.

W menu rozwijanym Urządzenie wybierz zestaw deweloperski.

Wybierz jeden z dostępnych szablonów asystent głosowych.

Kliknij pole wyboru Zgadzam się na warunki & dla tego projektu .

Kliknij pozycję Utwórz.

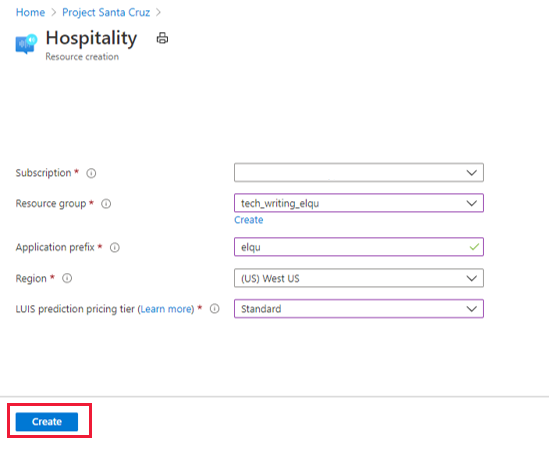

Po kliknięciu pozycji Utwórz portal otworzy kolejne okno, aby utworzyć zasób motywu mowy. Wykonaj następujące czynności w oknie:

Wybierz swoją subskrypcję platformy Azure w polu Subskrypcja .

Wybierz preferowaną grupę zasobów z menu rozwijanego Grupa zasobów . Jeśli chcesz utworzyć nową grupę zasobów do użycia z asystent głosem, kliknij przycisk Utwórz w menu rozwijanym i postępuj zgodnie z monitami.

W polu Prefiks aplikacji wprowadź nazwę. Będzie to prefiks projektu i niestandardowa nazwa polecenia.

W obszarze Region wybierz region, w którym mają zostać wdrożone zasoby.

W obszarze Warstwa cenowa przewidywania usługi LUIS wybierz pozycję Standardowa (warstwa bezpłatna nie obsługuje żądań mowy).

Kliknij przycisk Utwórz. Zasoby aplikacji asystent głosowej zostaną wdrożone w ramach subskrypcji.

Ostrzeżenie

Nie zamykaj okna, dopóki portal nie zakończy wdrażania zasobu. Zamknięcie okna przedwcześnie może spowodować nieoczekiwane zachowanie asystent głosowej. Po wdrożeniu zasobu zostanie wyświetlony pokaz.

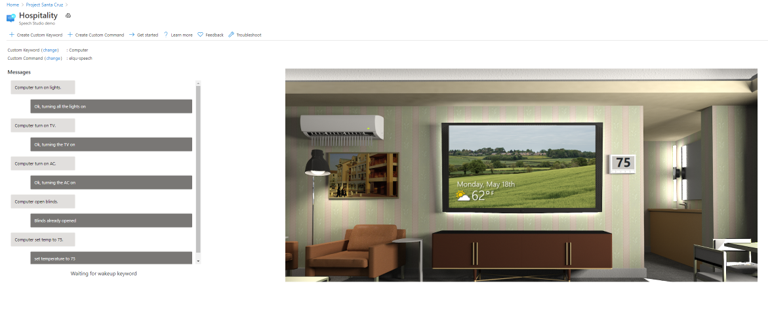

Testowanie asystent głosowej

Aby wchodzić w interakcję z asystent głosem, powiedz słowo kluczowe, po którym następuje polecenie. Gdy ear SoM rozpoznaje słowo kluczowe, urządzenie emituje chime (który można usłyszeć, jeśli głośnik lub słuchawki są podłączone), a dioda LED będzie migać niebiesko. Diody LED przełączą się na niebieski wyścig podczas przetwarzania polecenia. Odpowiedź asystent głosowa na polecenie zostanie wydrukowana w tekście w oknie pokazu i emitowana audibly za pośrednictwem głośnika/słuchawek. Domyślne słowo kluczowe (wymienione obok niestandardowego słowa kluczowego) jest ustawione na "Komputer", a każdy szablon ma zestaw zgodnych poleceń, które umożliwiają interakcję z obiektami wirtualnymi w oknie pokazu. Jeśli na przykład używasz gościnności lub pokazu opieki zdrowotnej, powiedz "Komputer, włącz telewizor", aby włączyć wirtualny telewizor.

Polecenia pokazu hotelarstwa i opieki zdrowotnej

Zarówno pokazy opieki zdrowotnej, jak i gościnności mają wirtualne telewizory, światła, żaluzje i termostaty, z którymi można korzystać. Obsługiwane są następujące polecenia (i dodatkowe odmiany):

- "Włącz/wyłącz światła".

- "Włącz/wyłącz telewizor".

- "Włącz/wyłącz ac".

- "Otwórz/zamknij rolety".

- "Ustaw temperaturę na X stopni"." (X jest żądaną temperaturą, np. 75).)

Polecenia pokazu motoryzacyjnego

Pokaz samochodowy ma cieplejsze, rozmrażacze i termostat wirtualny, z którym można korzystać. Obsługiwane są następujące polecenia (i dodatkowe odmiany):

- "Włącz/wyłącz rozrost".

- "Włącz/wyłącz cieplejsze siedzenie".

- "Ustaw temperaturę na X stopni"." (X jest żądaną temperaturą, np. 75).)

- "Zwiększ/zmniejsz temperaturę o Y stopnie".

Polecenia pokazu spisu

Pokaz spisu zawiera wybór wirtualnych niebieskich, żółtych i zielonych pól do interakcji z aplikacją wirtualnego spisu. Obsługiwane są następujące polecenia (i dodatkowe odmiany):

- "Dodaj/usuń pola X". (X to liczba pól, np. 4).)

- "Order/ship X box".

- "Ile pudełek jest w magazynie?"

- "Zlicz pola Y". (Y jest kolorem pól, np. żółtym).

- "Wyślij wszystko w magazynie"."

Konfigurowanie słowa kluczowego

Możesz dostosować słowo kluczowe dla aplikacji asystent głosowej.

Kliknij przycisk zmień obok pozycji Niestandardowe słowo kluczowe w oknie pokazu.

Wybierz jedno z dostępnych słów kluczowych. Możesz wybrać spośród wybranych przykładowych słów kluczowych i dowolnych utworzonych słów kluczowych niestandardowych.

Kliknij pozycję Zapisz.

Tworzenie niestandardowego słowa kluczowego

Możesz utworzyć własne słowo kluczowe dla aplikacji głosowej. Trenowanie niestandardowego słowa kluczowego może zakończyć się w ciągu zaledwie kilku minut.

Kliknij pozycję + Utwórz niestandardowe słowo kluczowe w górnej części okna pokazu.

Wprowadź żądane słowo kluczowe, które może być pojedynczym słowem lub krótką frazą.

Wybierz zasób usługi Mowa (znajduje się on obok pozycji Polecenie niestandardowe w oknie pokazu i zawiera prefiks aplikacji).

Kliknij pozycję Zapisz.

Tworzenie polecenia niestandardowego

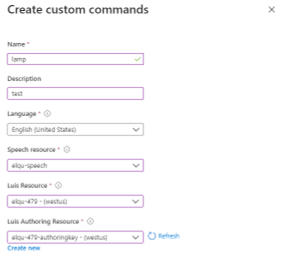

Portal udostępnia również funkcje tworzenia poleceń niestandardowych z istniejącymi zasobami mowy. "Polecenie niestandardowe" odnosi się do samej aplikacji asystent głosowej, a nie określonego polecenia w istniejącej aplikacji. Tworząc polecenie niestandardowe, tworzysz nowy projekt mowy, który należy jeszcze bardziej rozwinąć w usłudze Speech Studio.

Aby utworzyć nowe polecenie niestandardowe z poziomu okna demonstracyjnego, kliknij pozycję + Utwórz polecenie niestandardowe w górnej części strony i wykonaj następujące czynności:

Wprowadź nazwę polecenia niestandardowego.

Wprowadź opis projektu (opcjonalnie).

Wybierz preferowany język.

Wybierz zasób mowy.

Wybierz zasób usługi LUIS.

Wybierz zasób tworzenia usługi LUIS lub utwórz nowy.

Kliknij pozycję Utwórz.

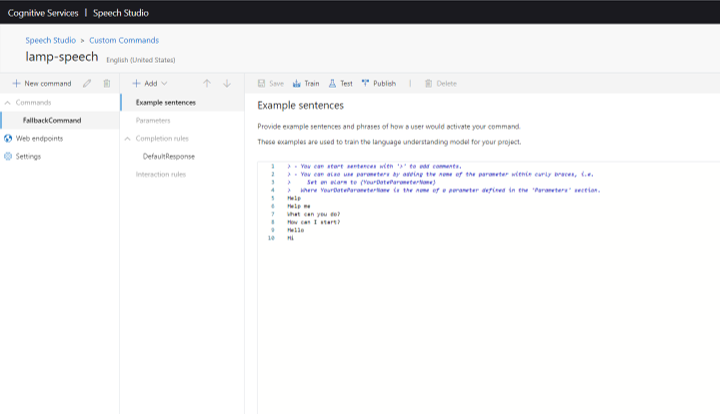

Po utworzeniu polecenia niestandardowego musisz przejść do usługi Speech Studio w celu dalszego programowania. Jeśli otworzysz program Speech Studio i nie widzisz niestandardowego polecenia, wykonaj następujące kroki:

Na panelu menu po lewej stronie w Azure Percept Studio kliknij pozycję Mowa w obszarze Projekty sztucznej inteligencji.

Wybierz kartę Polecenia .

Wybierz niestandardowe polecenie, które chcesz utworzyć. Spowoduje to otwarcie projektu w programie Speech Studio.

Aby uzyskać więcej informacji na temat tworzenia poleceń niestandardowych, zobacz dokumentację usługi Mowa.

Rozwiązywanie problemów

Utworzono asystent głosową, ale nie odpowiada na polecenia

Sprawdź światła LED na tablicy Interposer:

- Trzy niebieskie światła wskazują, że głos asystent jest gotowy i czeka na słowo kluczowe.

- Jeśli środkowa dioda LED (L02) jest biała, zestaw deweloperski zakończył inicjowanie i musi być skonfigurowany za pomocą słowa kluczowego.

- Jeśli środkowa dioda LED (L02) miga na biały, audio SoM jeszcze nie zakończył inicjowania. Inicjowanie może potrwać kilka minut.

Aby uzyskać więcej informacji na temat wskaźników LED, zobacz artykuł LED.

Asystent głosowe nie odpowiada na niestandardowe słowo kluczowe utworzone w usłudze Speech Studio

Może się to zdarzyć, jeśli moduł mowy jest nieaktualny. Wykonaj następujące kroki, aby zaktualizować moduł mowy do najnowszej wersji:

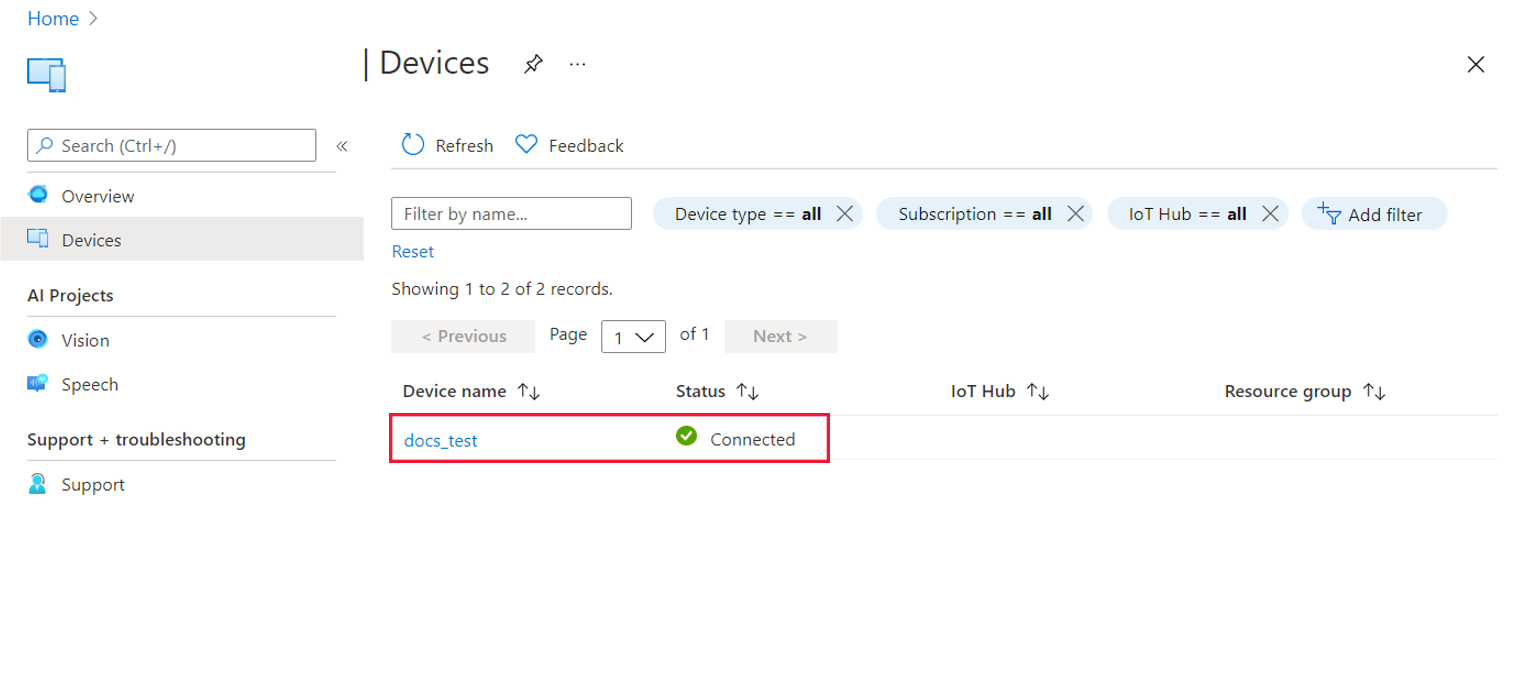

Kliknij pozycję Urządzenia w panelu menu po lewej stronie strony głównej Azure Percept Studio.

Znajdź i wybierz urządzenie.

W oknie urządzenia wybierz kartę Mowa .

Sprawdź wersję modułu mowy. Jeśli aktualizacja jest dostępna, obok numeru wersji zostanie wyświetlony przycisk Aktualizuj .

Kliknij przycisk Aktualizuj , aby wdrożyć aktualizację modułu mowy. Proces aktualizacji zazwyczaj trwa od 2 do 3 minut.

Czyszczenie zasobów

Po zakończeniu pracy z aplikacją asystent głosowej wykonaj następujące kroki, aby wyczyścić zasoby mowy wdrożone w tym samouczku:

W Azure Portal wybierz pozycję Grupy zasobów z panelu menu po lewej stronie lub wpisz ją na pasku wyszukiwania.

Wybierz swoją grupę zasobów.

Wybierz wszystkie sześć zasobów zawierających prefiks aplikacji i kliknij ikonę Usuń w górnym panelu menu.

Aby potwierdzić usunięcie, wpisz tak w polu potwierdzenia, sprawdź, czy wybrano odpowiednie zasoby, a następnie kliknij przycisk Usuń.

Ostrzeżenie

Spowoduje to usunięcie wszystkich niestandardowych słów kluczowych utworzonych przy użyciu usuniętych zasobów mowy, a pokaz asystent głosowy nie będzie już działać.

Następne kroki

Teraz, po utworzeniu rozwiązania mowy bez kodu, spróbuj utworzyć rozwiązanie do przetwarzania obrazów bez kodu dla zestawu DK platformy Azure Percept.