Copiare dati dal server HDFS usando Azure Data Factory o Synapse Analytics

SI APPLICA A: Azure Data Factory

Azure Data Factory  Azure Synapse Analytics

Azure Synapse Analytics

Suggerimento

Provare Data Factory in Microsoft Fabric, una soluzione di analisi completa per le aziende. Microsoft Fabric copre tutti gli elementi, dallo spostamento dei dati all'analisi scientifica dei dati, all'analisi in tempo reale, alla business intelligence e alla creazione di report. Scopri come avviare gratuitamente una nuova versione di valutazione .

Questo articolo illustra come copiare dati dal server Hadoop Distributed File System (HDFS). Per altre informazioni, vedere gli articoli introduttivi per Azure Data Factory e Synapse Analytics.

Funzionalità supportate

Questo connettore HDFS è supportato per le funzionalità seguenti:

| Funzionalità supportate | IR |

|---|---|

| attività Copy (source/-) | ① ② |

| Attività Lookup | ① ② |

| Attività Delete | ① ② |

(1) Runtime di integrazione di Azure (2) Runtime di integrazione self-hosted

In particolare, il connettore HDFS supporta:

- Copia di file tramite Windows (Kerberos) o l'autenticazione anonima .

- Copia di file usando il protocollo webhdfs o il supporto predefinito di DistCp .

- La copia di file così come è o tramite l'analisi o la generazione di file con i formati di file e i codec di compressione supportati.

Prerequisiti

Se l'archivio dati si trova all'interno di una rete locale, una rete virtuale di Azure o un cloud privato virtuale di Amazon, è necessario configurare un runtime di integrazione self-hosted per connettersi.

Se l'archivio dati è un servizio dati cloud gestito, è possibile usare Azure Integration Runtime. Se l'accesso è limitato agli indirizzi IP approvati nelle regole del firewall, è possibile aggiungere indirizzi IP del runtime di integrazione di Azure all'elenco elementi consentiti.

È anche possibile usare la funzionalità di runtime di integrazione della rete virtuale gestita in Azure Data Factory per accedere alla rete locale senza installare e configurare un runtime di integrazione self-hosted.

Per altre informazioni sui meccanismi di sicurezza di rete e sulle opzioni supportate da Data Factory, vedere strategie di accesso ai dati.

Nota

Assicurarsi che il runtime di integrazione possa accedere a tutti i [server dei nodi dei nomi]:[porta del nodo nome] e [server nodo dati]:[porta del nodo dati] del cluster Hadoop. Il valore predefinito [porta nodo nome] è 50070 e il valore predefinito [porta del nodo dati] è 50075.

Attività iniziali

Per eseguire l'attività di copia con una pipeline, è possibile usare uno degli strumenti o SDK seguenti:

- Strumento Copia dati

- Il portale di Azure

- .NET SDK

- The Python SDK

- Azure PowerShell

- The REST API

- Modello di Azure Resource Manager

Creare un servizio collegato a HDFS usando l'interfaccia utente

Usare la procedura seguente per creare un servizio collegato a HDFS nell'interfaccia utente di portale di Azure.

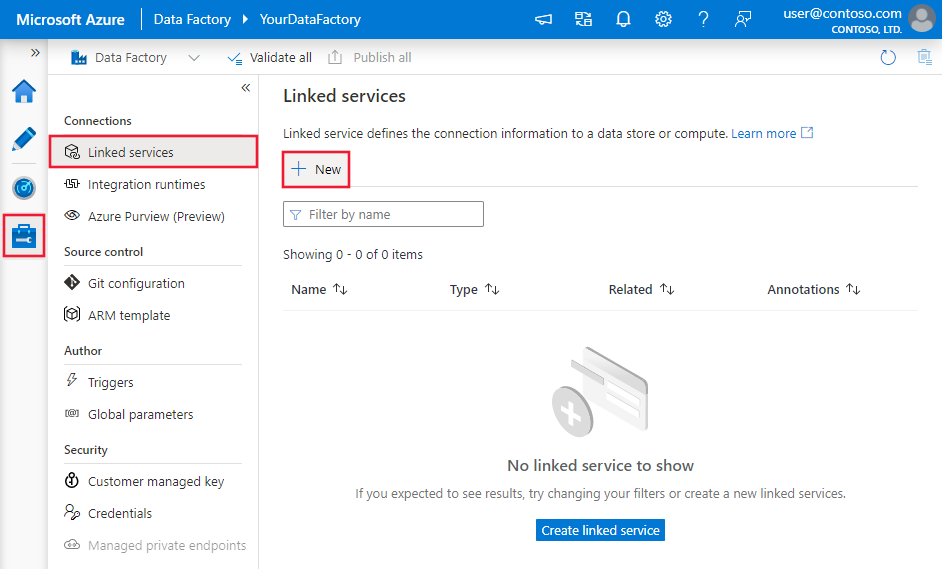

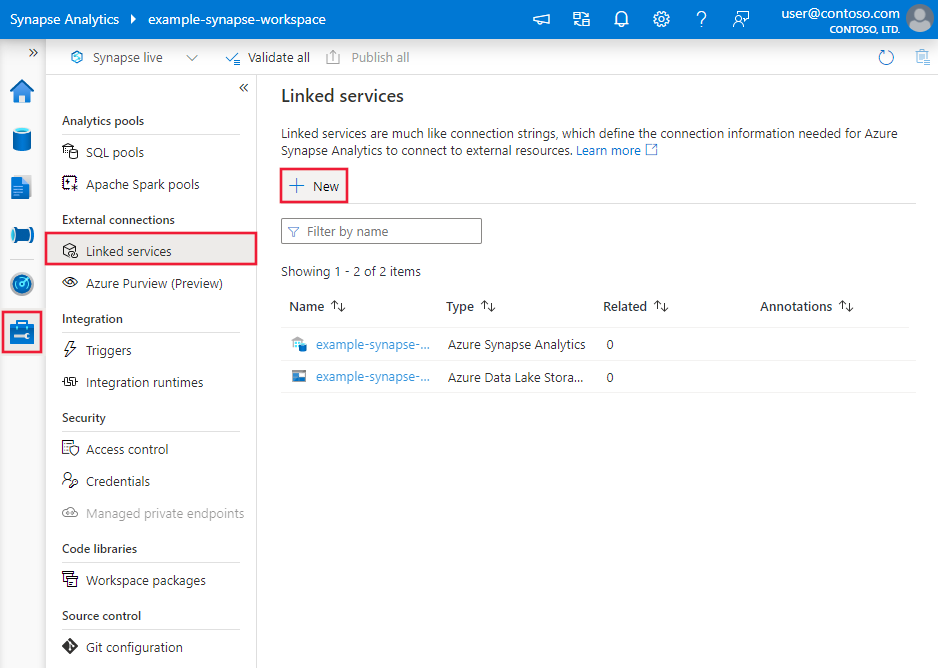

Passare alla scheda Gestisci nell'area di lavoro di Azure Data Factory o Synapse e selezionare Servizi collegati, quindi fare clic su Nuovo:

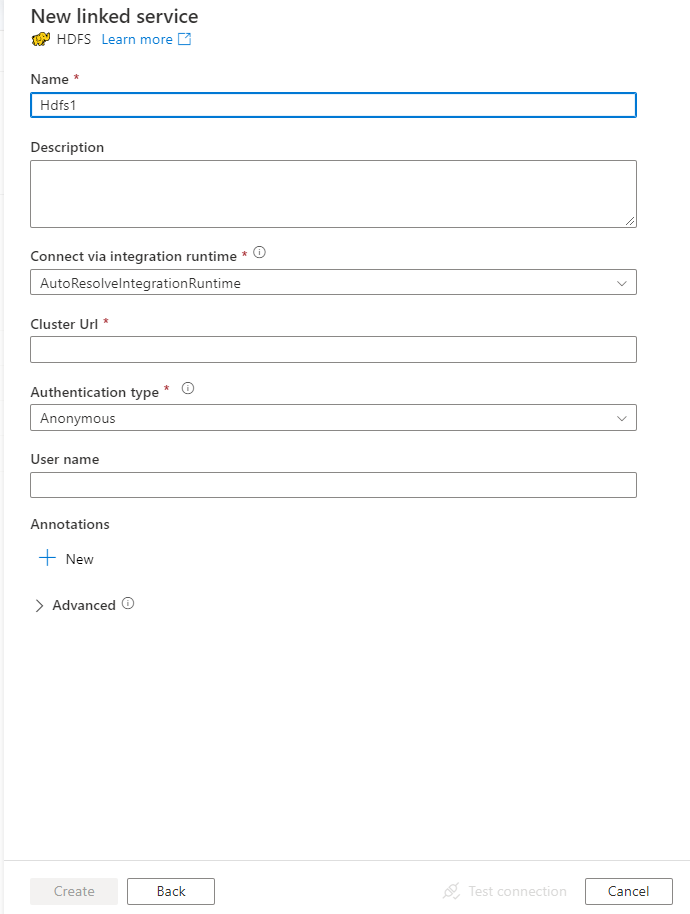

Cercare HDFS e selezionare il connettore HDFS.

Configurare i dettagli del servizio, testare la connessione e creare il nuovo servizio collegato.

Dettagli di configurazione di Connessione or

Le sezioni seguenti riportano informazioni dettagliate sulle proprietà che vengono usate per definire entità di Data Factory specifiche per HDFS.

Proprietà del servizio collegato

Per il servizio collegato HDFS sono supportate le proprietà seguenti:

| Proprietà | Descrizione | Obbligatorio |

|---|---|---|

| type | La proprietà type deve essere impostata su Hdfs. | Sì |

| URL. | URL di HDFS | Sì |

| authenticationType | I valori consentiti sono Anonymous o Windows. Per configurare l'ambiente locale, vedere la sezione Usare l'autenticazione Kerberos per il connettore HDFS. |

Sì |

| userName | Nome utente per autenticazione di Windows. Per l'autenticazione Kerberos, specificare username@domain.com>.<>< | Sì (per autenticazione di Windows) |

| password | Password per autenticazione di Windows. Contrassegnare questo campo come SecureString per archiviarlo in modo sicuro o fare riferimento a un segreto archiviato in un insieme di credenziali delle chiavi di Azure. | Sì (per l'autenticazione di Windows) |

| connectVia | Runtime di integrazione da usare per la connessione all'archivio dati. Per altre informazioni, vedere la sezione Prerequisiti . Se il runtime di integrazione non è specificato, il servizio usa il runtime di integrazione di Azure predefinito. | No |

Esempio: uso dell'autenticazione anonima

{

"name": "HDFSLinkedService",

"properties": {

"type": "Hdfs",

"typeProperties": {

"url" : "http://<machine>:50070/webhdfs/v1/",

"authenticationType": "Anonymous",

"userName": "hadoop"

},

"connectVia": {

"referenceName": "<name of Integration Runtime>",

"type": "IntegrationRuntimeReference"

}

}

}

Esempio: uso dell'autenticazione di Windows

{

"name": "HDFSLinkedService",

"properties": {

"type": "Hdfs",

"typeProperties": {

"url" : "http://<machine>:50070/webhdfs/v1/",

"authenticationType": "Windows",

"userName": "<username>@<domain>.com (for Kerberos auth)",

"password": {

"type": "SecureString",

"value": "<password>"

}

},

"connectVia": {

"referenceName": "<name of Integration Runtime>",

"type": "IntegrationRuntimeReference"

}

}

}

Proprietà del set di dati

Per un elenco completo delle sezioni e delle proprietà disponibili per la definizione di set di dati, vedere l'articolo Set di dati.

Azure Data Factory supporta i formati di file seguenti. Per impostazioni basate sui formati, fare riferimento ai singoli articoli.

- Formato Avro

- Formato binario

- Formato testo delimitato

- Formato Excel

- Formato JSON

- Formato ORC

- Formato Parquet

- Formato XML

Le proprietà seguenti sono supportate per HDFS nelle location impostazioni nel set di dati basato sul formato:

| Proprietà | Descrizione | Obbligatorio |

|---|---|---|

| type | La proprietà location type in nel set di dati deve essere impostata su HdfsLocation. |

Sì |

| folderPath | Percorso della cartella. Se si vuole usare un carattere jolly per filtrare la cartella, ignorare questa impostazione e specificare il percorso nelle impostazioni dell'origine attività. | No |

| fileName | Nome del file nel percorso di cartella specificato. Se si vuole usare un carattere jolly per filtrare i file, ignorare questa impostazione e specificare il nome del file nelle impostazioni dell'origine attività. | No |

Esempio:

{

"name": "DelimitedTextDataset",

"properties": {

"type": "DelimitedText",

"linkedServiceName": {

"referenceName": "<HDFS linked service name>",

"type": "LinkedServiceReference"

},

"schema": [ < physical schema, optional, auto retrieved during authoring > ],

"typeProperties": {

"location": {

"type": "HdfsLocation",

"folderPath": "root/folder/subfolder"

},

"columnDelimiter": ",",

"quoteChar": "\"",

"firstRowAsHeader": true,

"compressionCodec": "gzip"

}

}

}

Proprietà dell'attività di copia

Per un elenco completo di sezioni e proprietà disponibili per la definizione delle attività, vedere Pipeline e attività. In questa sezione viene fornito un elenco di proprietà supportate dall'origine HDFS.

HDFS come origine

Azure Data Factory supporta i formati di file seguenti. Per impostazioni basate sui formati, fare riferimento ai singoli articoli.

- Formato Avro

- Formato binario

- Formato testo delimitato

- Formato Excel

- Formato JSON

- Formato ORC

- Formato Parquet

- Formato XML

Le proprietà seguenti sono supportate per HDFS nelle storeSettings impostazioni nell'origine copia basata sul formato:

| Proprietà | Descrizione | Obbligatorio |

|---|---|---|

| type | La proprietà type in storeSettings deve essere impostata su HdfsRead Impostazioni. |

Sì |

| Individuare i file da copiare | ||

| OPZIONE 1: percorso statico |

Copiare dalla cartella o dal percorso del file specificato nel set di dati. Se si vogliono copiare tutti i file da una cartella, specificare anche wildcardFileName come *. |

|

| OPZIONE 2: carattere jolly - wildcardFolderPath |

Percorso della cartella con caratteri jolly per filtrare le cartelle di origine. I caratteri jolly consentiti sono: * (corrispondenza di zero o più caratteri) e ? (corrispondenza di zero caratteri o di un carattere singolo). Usare ^ per eseguire l'escape se il nome effettivo della cartella ha un carattere jolly o questo carattere di escape all'interno. Per altri esempi, vedere Esempi di filtro di file e cartelle. |

No |

| OPZIONE 2: carattere jolly - wildcardFileName |

Nome file con caratteri jolly nella cartella specificataPath/wildcardFolderPath per filtrare i file di origine. I caratteri jolly consentiti sono: * (corrisponde a zero o più caratteri) e ? (corrisponde a zero o carattere singolo); usare per eseguire ^ l'escape se il nome file effettivo ha un carattere jolly o questo carattere di escape all'interno. Per altri esempi, vedere Esempi di filtro di file e cartelle. |

Sì |

| OPZIONE 3: un elenco di file - fileListPath |

Indica di copiare un set di file specificato. Puntare a un file di testo che include un elenco di file da copiare (un file per riga, con il percorso relativo del percorso configurato nel set di dati). Quando si usa questa opzione, non specificare il nome file nel set di dati. Per altri esempi, vedere Esempi di elenco di file. |

No |

| Impostazioni aggiuntive | ||

| recursive | Indica se i dati vengono letti in modo ricorsivo dalle cartelle secondarie o solo dalla cartella specificata. Se recursive è impostato su true e il sink è un archivio basato su file, una cartella o una sottocartella vuota non viene copiata o creata nel sink. I valori consentiti sono true (predefinito) e false. Questa proprietà non è applicabile quando si configura fileListPath. |

No |

| deleteFilesAfterCompletion | Indica se i file binari verranno eliminati dall'archivio di origine dopo il corretto spostamento nell'archivio di destinazione. L'eliminazione del file è per file, quindi quando l'attività di copia ha esito negativo, si noterà che alcuni file sono già stati copiati nella destinazione ed eliminati dall'origine, mentre altri rimangono nell'archivio di origine. Questa proprietà è valida solo nello scenario di copia dei file binari. Valore predefinito: false. |

No |

| modifiedDatetimeStart | I file vengono filtrati in base all'attributo Ultima modifica. I file vengono selezionati se l'ora dell'ultima modifica è maggiore o uguale a modifiedDatetimeStart e minore di modifiedDatetimeEnd. L'ora viene applicata al fuso orario UTC nel formato 2018-12-01T05:00:00Z. Le proprietà possono essere NULL, il che significa che al set di dati non viene applicato alcun filtro dell'attributo di file. Quando modifiedDatetimeStart ha un valore datetime ma modifiedDatetimeEnd è NULL, significa che vengono selezionati i file il cui ultimo attributo modificato è maggiore o uguale al valore datetime. Quando modifiedDatetimeEnd ha un valore datetime ma modifiedDatetimeStart è NULL, significa che vengono selezionati i file il cui ultimo attributo modificato è minore del valore datetime.Questa proprietà non è applicabile quando si configura fileListPath. |

No |

| modifiedDatetimeEnd | Come sopra. | |

| enablePartitionDiscovery | Per i file partizionati, specificare se analizzare le partizioni dal percorso del file e aggiungerle come colonne di origine aggiuntive. I valori consentiti sono false (impostazione predefinita) e true. |

No |

| partitionRootPath | Quando l'individuazione delle partizioni è abilitata, specificare il percorso radice assoluto per leggere le cartelle partizionate come colonne di dati. Se non è specificato, per impostazione predefinita, - Quando si usa il percorso del file nel set di dati o nell'elenco di file nell'origine, il percorso radice della partizione è il percorso configurato nel set di dati. - Quando si usa il filtro delle cartelle con caratteri jolly, il percorso radice della partizione è il sottopercorso prima del primo carattere jolly. Si supponga, ad esempio, di configurare il percorso nel set di dati come "root/folder/year=2020/month=08/day=27": - Se si specifica il percorso radice della partizione come "root/folder/year=2020", l'attività di copia genererà altre due colonne month e day con il valore "08" e "27" rispettivamente, oltre alle colonne all'interno dei file.- Se il percorso radice della partizione non è specificato, non verrà generata alcuna colonna aggiuntiva. |

No |

| maxConcurrentConnections | Limite massimo di connessioni simultanee stabilite all'archivio dati durante l'esecuzione dell'attività. Specificare un valore solo quando si desidera limitare le connessioni simultanee. | No |

| Impostazioni diStCp | ||

| distcpSettings | Gruppo di proprietà da usare quando si usa HDFS DistCp. | No |

| resourceManagerEndpoint | Endpoint YARN (ancora un altro negoziatore di risorse) | Sì, se si usa DistCp |

| tempScriptPath | Percorso della cartella usato per archiviare lo script di comando temp DistCp. Il file di script viene generato e verrà rimosso al termine del processo di copia. | Sì, se si usa DistCp |

| distcpOptions | Opzioni aggiuntive per il comando DistCp. | No |

Esempio:

"activities":[

{

"name": "CopyFromHDFS",

"type": "Copy",

"inputs": [

{

"referenceName": "<Delimited text input dataset name>",

"type": "DatasetReference"

}

],

"outputs": [

{

"referenceName": "<output dataset name>",

"type": "DatasetReference"

}

],

"typeProperties": {

"source": {

"type": "DelimitedTextSource",

"formatSettings":{

"type": "DelimitedTextReadSettings",

"skipLineCount": 10

},

"storeSettings":{

"type": "HdfsReadSettings",

"recursive": true,

"distcpSettings": {

"resourceManagerEndpoint": "resourcemanagerendpoint:8088",

"tempScriptPath": "/usr/hadoop/tempscript",

"distcpOptions": "-m 100"

}

}

},

"sink": {

"type": "<sink type>"

}

}

}

]

Esempi di filtro file e cartelle

Questa sezione descrive il comportamento risultante se si usa un filtro con caratteri jolly con il percorso della cartella e il nome del file.

| folderPath | fileName | recursive | Struttura delle cartelle di origine e risultato del filtro (i file in grassetto sono stati recuperati) |

|---|---|---|---|

Folder* |

(vuoto, usare valore predefinito) | false | CartellaA File1.csv File2.json Sottocartella1 File3.csv File4.json File5.csv AltraCartellaB File6.csv |

Folder* |

(vuoto, usare valore predefinito) | vero | CartellaA File1.csv File2.json Sottocartella1 File3.csv File4.json File5.csv AltraCartellaB File6.csv |

Folder* |

*.csv |

false | CartellaA File1.csv File2.json Sottocartella1 File3.csv File4.json File5.csv AltraCartellaB File6.csv |

Folder* |

*.csv |

vero | CartellaA File1.csv File2.json Sottocartella1 File3.csv File4.json File5.csv AltraCartellaB File6.csv |

Esempi di elenco di file

In questa sezione viene descritto il comportamento risultante dall'uso di un percorso dell'elenco di file nell'origine attività Copy. Si presuppone che sia presente la struttura di cartelle di origine seguente e si voglia copiare i file in grassetto:

| Esempio di struttura di origine | Contenuto in FileListToCopy.txt | Impostazione |

|---|---|---|

| root CartellaA File1.csv File2.json Sottocartella1 File3.csv File4.json File5.csv Metadati UFX FileListToCopy.txt |

File1.csv Sottocartella1/File3.csv Sottocartella1/File5.csv |

Nel set di dati: - Percorso cartella: root/FolderANell'origine attività Copy: - Percorso elenco file: root/Metadata/FileListToCopy.txt Il percorso dell'elenco di file punta a un file di testo nello stesso archivio dati che include un elenco di file da copiare (un file per riga, con il percorso relativo al percorso configurato nel set di dati). |

Usare DistCp per copiare dati da HDFS

DistCp è uno strumento da riga di comando nativo hadoop per eseguire una copia distribuita in un cluster Hadoop. Quando si esegue un comando in DistCp, elenca innanzitutto tutti i file da copiare e quindi crea diversi processi di mapping nel cluster Hadoop. Ogni processo di mapping esegue una copia binaria dall'origine al sink.

Il attività Copy supporta l'uso di DistCp per copiare i file così come si trova nell'archivio BLOB di Azure (inclusa la copia a fasi) o in un archivio Azure Data Lake. In questo caso, DistCp può sfruttare la potenza del cluster anziché l'esecuzione nel runtime di integrazione self-hosted. L'uso di DistCp offre una migliore velocità effettiva di copia, soprattutto se il cluster è molto potente. In base alla configurazione, il attività Copy costruisce automaticamente un comando DistCp, lo invia al cluster Hadoop e monitora lo stato della copia.

Prerequisiti

Per usare DistCp per copiare i file così come da HDFS ad Archiviazione BLOB di Azure (inclusa la copia di staging) o azure data lake Store, assicurarsi che il cluster Hadoop soddisfi i requisiti seguenti:

I servizi MapReduce e YARN sono abilitati.

YARN versione 2.5 o successiva.

Il server HDFS è integrato con l'archivio dati di destinazione: Archiviazione BLOB di Azure o Azure Data Lake Store (ADLS Gen1):

- Il FileSystem di BLOB di Azure è supportato in modo nativo a partire da Hadoop 2.7. È necessario specificare solo il percorso JAR nella configurazione dell'ambiente Hadoop.

- Il FileSystem di Azure Data Lake Store è disponibile come pacchetto a partire da Hadoop 3.0.0-alpha1. Se la versione del cluster Hadoop è precedente a quella versione, è necessario importare manualmente i pacchetti JAR correlati ad Azure Data Lake Store (azure-datalake-store.jar) nel cluster da qui e specificare il percorso del file JAR nella configurazione dell'ambiente Hadoop.

Preparare una cartella temporanea in HDFS. Questa cartella temporanea viene usata per archiviare uno script della shell DistCp, quindi occupa spazio a livello di KB.

Assicurarsi che l'account utente fornito nel servizio collegato HDFS abbia l'autorizzazione per:

- Inviare un'applicazione in YARN.

- Creare una sottocartella e file di lettura/scrittura nella cartella temporanea.

Configurazioni

Per le configurazioni e gli esempi correlati a DistCp, passare alla sezione HDFS come origine .

Usare l'autenticazione Kerberos per il connettore HDFS

Sono disponibili due opzioni per configurare l'ambiente locale per l'uso dell'autenticazione Kerberos per il connettore HDFS. È possibile scegliere quello più adatto alla propria situazione.

- Opzione 1: Aggiungere un computer di runtime di integrazione self-hosted nell'area di autenticazione Kerberos

- Opzione 2: Abilitare il trust reciproco tra il dominio Windows e l'area di autenticazione Kerberos

Per entrambe le opzioni, assicurarsi di attivare webhdfs per il cluster Hadoop:

Creare l'entità http e la scheda chiave per webhdfs.

Importante

L'entità Kerberos HTTP deve iniziare con "HTTP/" in base alla specifica HTTP SPNEGO Kerberos. Altre informazioni sono disponibili qui.

Kadmin> addprinc -randkey HTTP/<namenode hostname>@<REALM.COM> Kadmin> ktadd -k /etc/security/keytab/spnego.service.keytab HTTP/<namenode hostname>@<REALM.COM>Opzioni di configurazione di HDFS: aggiungere le tre proprietà seguenti in

hdfs-site.xml.<property> <name>dfs.webhdfs.enabled</name> <value>true</value> </property> <property> <name>dfs.web.authentication.kerberos.principal</name> <value>HTTP/_HOST@<REALM.COM></value> </property> <property> <name>dfs.web.authentication.kerberos.keytab</name> <value>/etc/security/keytab/spnego.service.keytab</value> </property>

Opzione 1: Aggiungere un computer di runtime di integrazione self-hosted nell'area di autenticazione Kerberos

Requisiti

- Il computer del runtime di integrazione self-hosted deve essere aggiunto all'area di autenticazione Kerberos e non può aggiungere alcun dominio Windows.

Modalità di configurazione

Nel server KDC:

Creare un'entità di sicurezza e specificare la password.

Importante

Il nome utente non deve contenere il nome host.

Kadmin> addprinc <username>@<REALM.COM>

Nel computer del runtime di integrazione self-hosted:

Eseguire l'utilità Ksetup per configurare l'area di autenticazione e il server Centro distribuzione chiavi (KDC) Kerberos.

Il computer deve essere configurato come membro di un gruppo di lavoro, perché un'area di autenticazione Kerberos è diversa da un dominio di Windows. È possibile ottenere questa configurazione impostando l'area di autenticazione Kerberos e aggiungendo un server KDC eseguendo i comandi seguenti. Sostituire REALM.COM con il nome dell'area di autenticazione.

C:> Ksetup /setdomain REALM.COM C:> Ksetup /addkdc REALM.COM <your_kdc_server_address>Dopo aver eseguito questi comandi, riavviare il computer.

Verificare la configurazione con il

Ksetupcomando . L'output dovrebbe essere simile al seguente:C:> Ksetup default realm = REALM.COM (external) REALM.com: kdc = <your_kdc_server_address>

Nell'area di lavoro di Data Factory o Synapse:

- Configurare il connettore HDFS usando autenticazione di Windows insieme al nome e alla password dell'entità Kerberos per connettersi all'origine dati HDFS. Per informazioni dettagliate sulla configurazione, vedere la sezione proprietà del servizio collegato HDFS.

Opzione 2: Abilitare il trust reciproco tra il dominio Windows e l'area di autenticazione Kerberos

Requisiti

- Il computer del runtime di integrazione self-hosted deve aggiungere un dominio Windows.

- È necessaria l'autorizzazione per aggiornare le impostazioni del controller di dominio.

Modalità di configurazione

Nota

Sostituire REALM.COM e AD.COM nell'esercitazione seguente con il proprio nome dell'area di autenticazione e il controller di dominio.

Nel server KDC:

Modificare la configurazione KDC nel file krb5.conf per consentire al KDC di considerare attendibile il dominio di Windows facendo riferimento al modello di configurazione seguente. Per impostazione predefinita, la configurazione si trova in /etc/krb5.conf.

[logging] default = FILE:/var/log/krb5libs.log kdc = FILE:/var/log/krb5kdc.log admin_server = FILE:/var/log/kadmind.log [libdefaults] default_realm = REALM.COM dns_lookup_realm = false dns_lookup_kdc = false ticket_lifetime = 24h renew_lifetime = 7d forwardable = true [realms] REALM.COM = { kdc = node.REALM.COM admin_server = node.REALM.COM } AD.COM = { kdc = windc.ad.com admin_server = windc.ad.com } [domain_realm] .REALM.COM = REALM.COM REALM.COM = REALM.COM .ad.com = AD.COM ad.com = AD.COM [capaths] AD.COM = { REALM.COM = . }Dopo aver configurato il file, riavviare il servizio KDC.

Preparare un'entità denominata krbtgt/REALM.COM@AD.COM nel server KDC con il comando seguente:

Kadmin> addprinc krbtgt/REALM.COM@AD.COMNel file di configurazione del servizio HDFS hadoop.security.auth_to_local aggiungere

RULE:[1:$1@$0](.*\@AD.COM)s/\@.*//.

Nel controller di dominio:

Eseguire i comandi seguenti

Ksetupper aggiungere una voce dell'area di autenticazione:C:> Ksetup /addkdc REALM.COM <your_kdc_server_address> C:> ksetup /addhosttorealmmap HDFS-service-FQDN REALM.COMStabilire il trust dal dominio Windows all'area di autenticazione Kerberos. [password] è la password per l'entità krbtgt/REALM.COM@AD.COM.

C:> netdom trust REALM.COM /Domain: AD.COM /add /realm /password:[password]Selezionare l'algoritmo di crittografia usato in Kerberos.

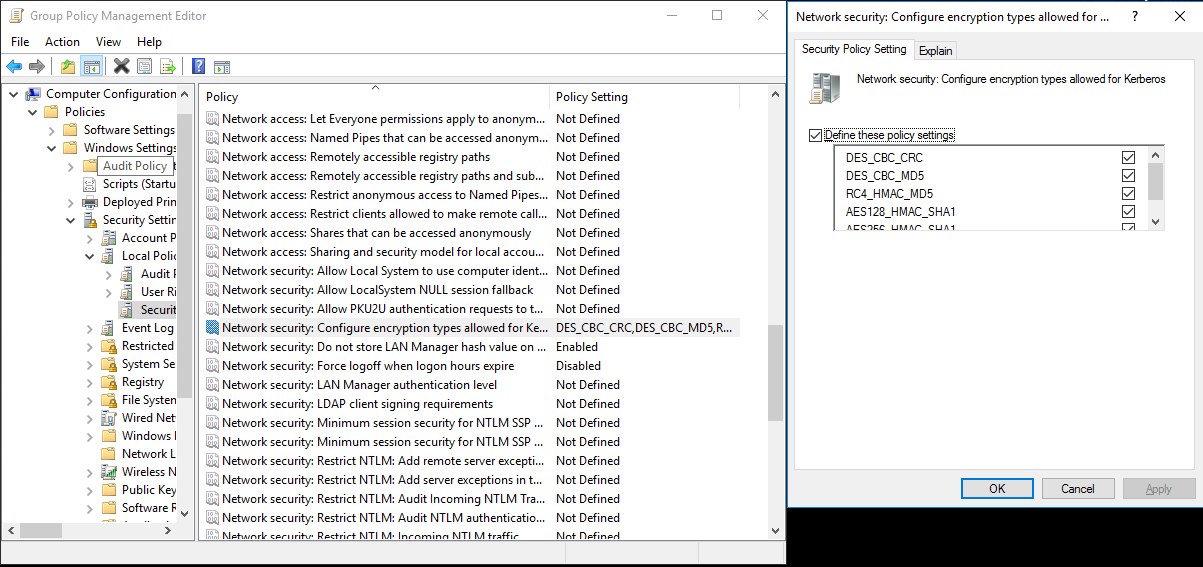

a. Selezionare Server Manager>Group Policy Management>Domain>Policy Objects Default o Active Domain Policy (Criteri>di gruppo predefiniti) o Active Domain Policy (Criteri di dominio attivi) e quindi selezionare Modifica.

b. Nel riquadro Editor Gestione Criteri di gruppo selezionare Criteri>di configurazione>computer Windows Impostazioni> Sicurezza Impostazioni> Opzioni di sicurezza criteri>locali e quindi configurare sicurezza di rete: Configurare i tipi di crittografia consentiti per Kerberos.

c. Selezionare l'algoritmo di crittografia da usare quando ci si connette al server KDC. È possibile selezionare tutte le opzioni.

d. Usare il

Ksetupcomando per specificare l'algoritmo di crittografia da usare nell'area di autenticazione specificata.C:> ksetup /SetEncTypeAttr REALM.COM DES-CBC-CRC DES-CBC-MD5 RC4-HMAC-MD5 AES128-CTS-HMAC-SHA1-96 AES256-CTS-HMAC-SHA1-96Creare il mapping tra l'account di dominio e l'entità Kerberos, in modo da poter usare l'entità Kerberos nel dominio di Windows.

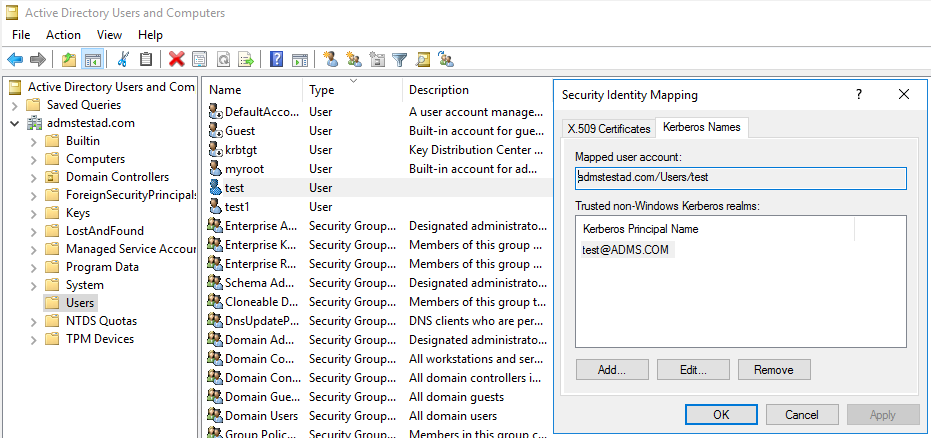

a. Selezionare strumenti Amministrazione istrativi> Utenti e computer di Active Directory.

b. Configurare le funzionalità avanzate selezionando Visualizza>Funzionalità avanzate.

c. Nel riquadro Funzionalità avanzate fare clic con il pulsante destro del mouse sull'account a cui si desidera creare mapping e, nel riquadro Mapping dei nomi, selezionare la scheda Nomi Kerberos.

d. Aggiungere un'entità di sicurezza dall'area di autenticazione.

Nel computer del runtime di integrazione self-hosted:

Eseguire i comandi seguenti

Ksetupper aggiungere una voce dell'area di autenticazione.C:> Ksetup /addkdc REALM.COM <your_kdc_server_address> C:> ksetup /addhosttorealmmap HDFS-service-FQDN REALM.COM

Nell'area di lavoro di Data Factory o Synapse:

- Configurare il connettore HDFS usando autenticazione di Windows insieme all'account di dominio o all'entità Kerberos per connettersi all'origine dati HDFS. Per informazioni dettagliate sulla configurazione, vedere la sezione proprietà del servizio collegato HDFS.

Proprietà dell'attività Lookup

Per informazioni sulle proprietà dell'attività di ricerca, vedere Attività di ricerca.

Proprietà dell'attività Delete

Per informazioni sulle proprietà dell'attività Delete, vedere Delete activity .For information about Delete activity properties, see Delete activity.

Modalità legacy

Nota

I modelli seguenti sono ancora supportati così come per la compatibilità con le versioni precedenti. È consigliabile usare il nuovo modello descritto in precedenza, perché l'interfaccia utente di creazione è passata alla generazione del nuovo modello.

Modello di set di dati legacy

| Proprietà | Descrizione | Obbligatorio |

|---|---|---|

| type | La proprietà type del set di dati deve essere impostata su FileShare | Sì |

| folderPath | Percorso della cartella. È supportato un filtro con caratteri jolly. I caratteri jolly consentiti sono * (corrisponde a zero o più caratteri) e ? (corrisponde a zero o un singolo carattere). Usare per eseguire ^ l'escape se il nome file effettivo ha un carattere jolly o questo carattere di escape all'interno. Esempi: cartellaradice/sottocartella/. Vedere altri esempi in Esempi di filtro file e cartelle. |

Sì |

| fileName | Nome o filtro con caratteri jolly per i file in "folderPath" specificato. Se non si specifica alcun valore per questa proprietà, il set di dati punta a tutti i file nella cartella. Per il filtro, i caratteri jolly consentiti sono * (corrisponde a zero o più caratteri) e ? (corrisponde a zero o a un singolo carattere).- Esempio 1: "fileName": "*.csv"- Esempio 2: "fileName": "???20180427.txt"Usare ^ per eseguire l'escape se il nome effettivo della cartella ha un carattere jolly o questo carattere di escape all'interno. |

No |

| modifiedDatetimeStart | I file vengono filtrati in base all'attributo Ultima modifica. I file vengono selezionati se l'ora dell'ultima modifica è maggiore o uguale a modifiedDatetimeStart e minore di modifiedDatetimeEnd. L'ora viene applicata al fuso orario UTC nel formato 2018-12-01T05:00:00Z. Tenere presente che le prestazioni complessive dello spostamento dei dati saranno influenzate dall'abilitazione di questa impostazione quando si vuole applicare un filtro di file a un numero elevato di file. Le proprietà possono essere NULL, il che significa che al set di dati non viene applicato alcun filtro dell'attributo di file. Quando modifiedDatetimeStart ha un valore datetime ma modifiedDatetimeEnd è NULL, significa che vengono selezionati i file il cui ultimo attributo modificato è maggiore o uguale al valore datetime. Quando modifiedDatetimeEnd ha un valore datetime ma modifiedDatetimeStart è NULL, significa che vengono selezionati i file il cui ultimo attributo modificato è minore del valore datetime. |

No |

| modifiedDatetimeEnd | I file vengono filtrati in base all'attributo Ultima modifica. I file vengono selezionati se l'ora dell'ultima modifica è maggiore o uguale a modifiedDatetimeStart e minore di modifiedDatetimeEnd. L'ora viene applicata al fuso orario UTC nel formato 2018-12-01T05:00:00Z. Tenere presente che le prestazioni complessive dello spostamento dei dati saranno influenzate dall'abilitazione di questa impostazione quando si vuole applicare un filtro di file a un numero elevato di file. Le proprietà possono essere NULL, il che significa che al set di dati non viene applicato alcun filtro dell'attributo di file. Quando modifiedDatetimeStart ha un valore datetime ma modifiedDatetimeEnd è NULL, significa che vengono selezionati i file il cui ultimo attributo modificato è maggiore o uguale al valore datetime. Quando modifiedDatetimeEnd ha un valore datetime ma modifiedDatetimeStart è NULL, significa che vengono selezionati i file il cui ultimo attributo modificato è minore del valore datetime. |

No |

| format | Per copiare i file così come sono tra archivi basati su file (copia binaria), è possibile ignorare la sezione del formato nelle definizioni dei set di dati di input e di output. Se si vuole analizzare file con un formato specifico, sono supportati i tipi di formato seguenti: TextFormat, JsonFormat, AvroFormat, OrcFormat e ParquetFormat. Impostare la proprietà type nell'area format su uno di questi valori. Per altre informazioni, vedere le sezioni Formato testo, Formato JSON, Formato AVRO, Formato OCR e Formato Parquet. |

No (solo per uno scenario di copia binaria) |

| compressione | Specificare il tipo e il livello di compressione dei dati. Per altre informazioni, vedere l'articolo sui formati di file supportati e i codec di compressione. I tipi supportati sono: Gzip, Deflate, Bzip2 e ZipDeflate. I livelli supportati sono Ottimale e Più veloce. |

No |

Suggerimento

Per copiare tutti i file in una cartella, specificare solo folderPath.

Per copiare un singolo file con un nome specificato, specificare folderPath con la parte della cartella e fileName con il nome file.

Per copiare un subset di file in una cartella, specificare folderPath con il percorso della cartella e fileName con il filtro con caratteri jolly.

Esempio:

{

"name": "HDFSDataset",

"properties": {

"type": "FileShare",

"linkedServiceName":{

"referenceName": "<HDFS linked service name>",

"type": "LinkedServiceReference"

},

"typeProperties": {

"folderPath": "folder/subfolder/",

"fileName": "*",

"modifiedDatetimeStart": "2018-12-01T05:00:00Z",

"modifiedDatetimeEnd": "2018-12-01T06:00:00Z",

"format": {

"type": "TextFormat",

"columnDelimiter": ",",

"rowDelimiter": "\n"

},

"compression": {

"type": "GZip",

"level": "Optimal"

}

}

}

}

Modello di origine legacy attività Copy

| Proprietà | Descrizione | Obbligatorio |

|---|---|---|

| type | La proprietà type dell'origine attività Copy deve essere impostata su HdfsSource. | Sì |

| recursive | Indica se i dati vengono letti in modo ricorsivo dalle cartelle secondarie o solo dalla cartella specificata. Quando recursive è impostato su true e il sink è un archivio basato su file, una cartella o una sottocartella vuota non verrà copiata o creata nel sink. I valori consentiti sono true (predefinito) e false. |

No |

| distcpSettings | Gruppo di proprietà quando si usa HDFS DistCp. | No |

| resourceManagerEndpoint | Endpoint di YARN Resource Manager | Sì, se si usa DistCp |

| tempScriptPath | Percorso della cartella usato per archiviare lo script di comando temp DistCp. Il file di script viene generato e verrà rimosso al termine del processo di copia. | Sì, se si usa DistCp |

| distcpOptions | Sono disponibili opzioni aggiuntive per il comando DistCp. | No |

| maxConcurrentConnections | Limite massimo di connessioni simultanee stabilite all'archivio dati durante l'esecuzione dell'attività. Specificare un valore solo quando si desidera limitare le connessioni simultanee. | No |

Esempio: origine HDFS in attività Copy tramite DistCp

"source": {

"type": "HdfsSource",

"distcpSettings": {

"resourceManagerEndpoint": "resourcemanagerendpoint:8088",

"tempScriptPath": "/usr/hadoop/tempscript",

"distcpOptions": "-m 100"

}

}

Contenuto correlato

Per un elenco di archivi dati supportati come origini e sink dal attività Copy, vedere archivi dati supportati.